AI Pixels : la fin du résultat comme preuve technique

L'analyse publiée sur AI Pixels (datagubbe.se) compare la génération d'images actuelle à la culture "copyist" des années 90, où les artistes décalquaient manuellement des œuvres fantasy pour simuler d

Le Pitch

L'analyse publiée sur AI Pixels (datagubbe.se) compare la génération d'images actuelle à la culture "copyist" des années 90, où les artistes décalquaient manuellement des œuvres fantasy pour simuler du talent. Dans le contexte actuel de 2026, cette réflexion souligne la panique de la demoscene face à des modèles capables de saturer les compétitions de productions indiscernables du travail humain.

Sous le capot

Depuis la sortie de Claude 4.5 Opus en novembre 2025 et de GPT-5 en août dernier, la capacité de génération "pixel-perfect" est devenue la norme (Internal Industry Benchmarks 2026). Ces modèles maîtrisent désormais les contraintes de palettes et de dithering au point qu'aucune analyse de l'image finale ne permet de détecter l'utilisation d'une IA.

Pour contrer cette opacité, la Revision 2026, qui se tient du 3 au 6 avril, impose une règle stricte : la fourniture de 10 étapes de travail (working stages) pour toute entrée dans la catégorie "Oldskool Graphics" (source: Revision-Party.net Rules 2026). L'objectif est de recréer artificiellement la preuve du craft manuel qui a disparu avec l'inférence instantanée.

Le débat se déplace sur le terrain légal avec le recyclage de l'éthique "No Copy!/?", autrefois utilisée contre le traçage manuel et aujourd'hui invoquée contre l'entraînement des modèles sur les volumes "Masters of Pixel Art" (HN Thread). On observe une friction croissante entre les archivistes du rétro-computing et les laboratoires d'IA qui exploitent ces datasets pour affiner leur précision sur les basses résolutions.

Plusieurs zones d'ombre subsistent dans ce bras de fer technique :

- On ignore quels outils de détection le jury de la Revision compte utiliser pour valider la plausibilité des 10 étapes fournies.

- La position officielle des auteurs de "Masters of Pixel Art" sur la restauration de vieux assets par IA reste inconnue (Dossier UsedBy).

- La capacité des modèles à simuler eux-mêmes des "étapes de travail" cohérentes n'est pas encore documentée.

L'avis de Ruben

Le pixel art n'est plus un benchmark de compétence technique, c'est devenu un test d'effort documenté. Si vous produisez du pixel art pour la prod, GPT-5 fait le job mieux et plus vite que n'importe quel junior, point final. Mais si vous visez la demoscene, l'IA est devenue un pass vaccinal : sans un historique de commit ou des captures de WIP crédibles, votre travail sera considéré comme un scam par défaut. Le résultat ne vaut plus rien sans la preuve de la douleur.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

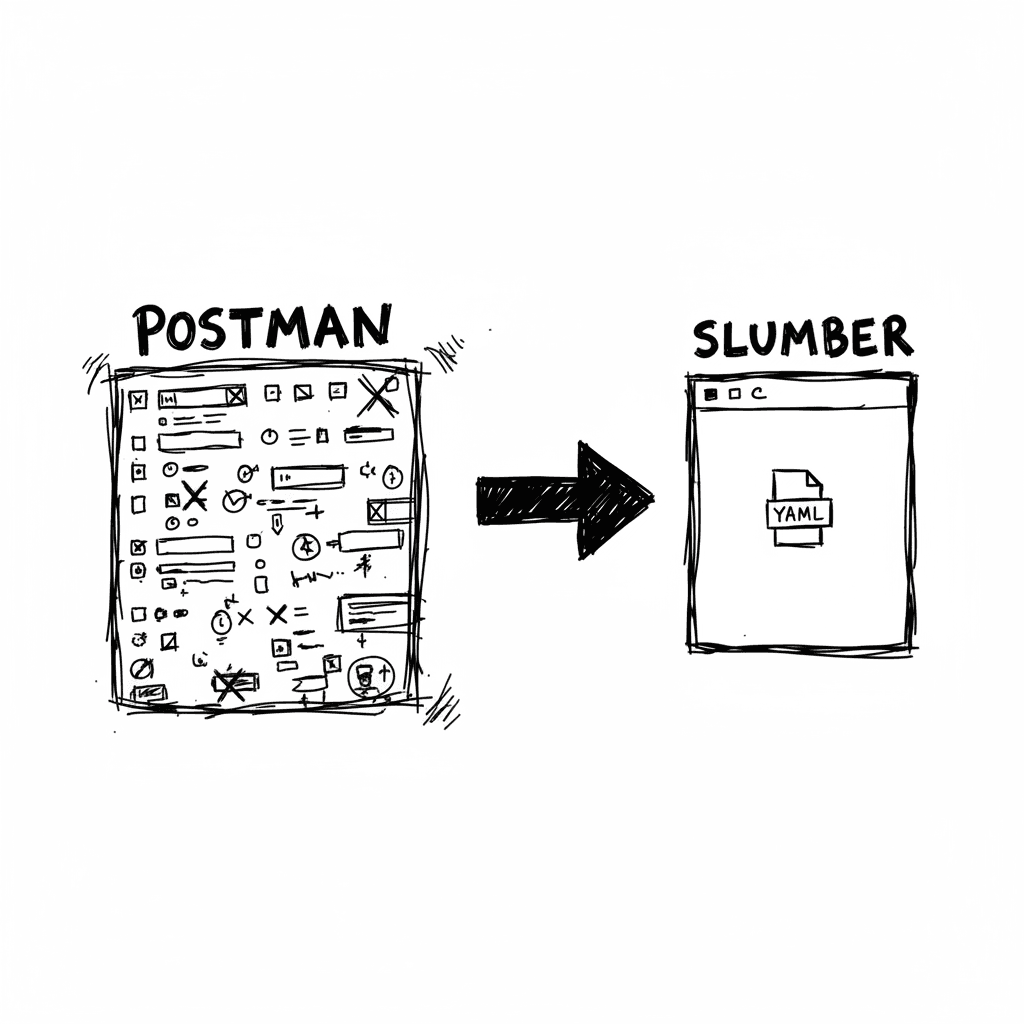

Slumber 5.3 : l'alternative TUI en Rust pour le debugging API

Slumber est un client HTTP basé sur le terminal qui privilégie la configuration au clic-bouton. Développé en Rust, il propose une approche "un-enshittified" face à des usines à gaz comme Postman en st

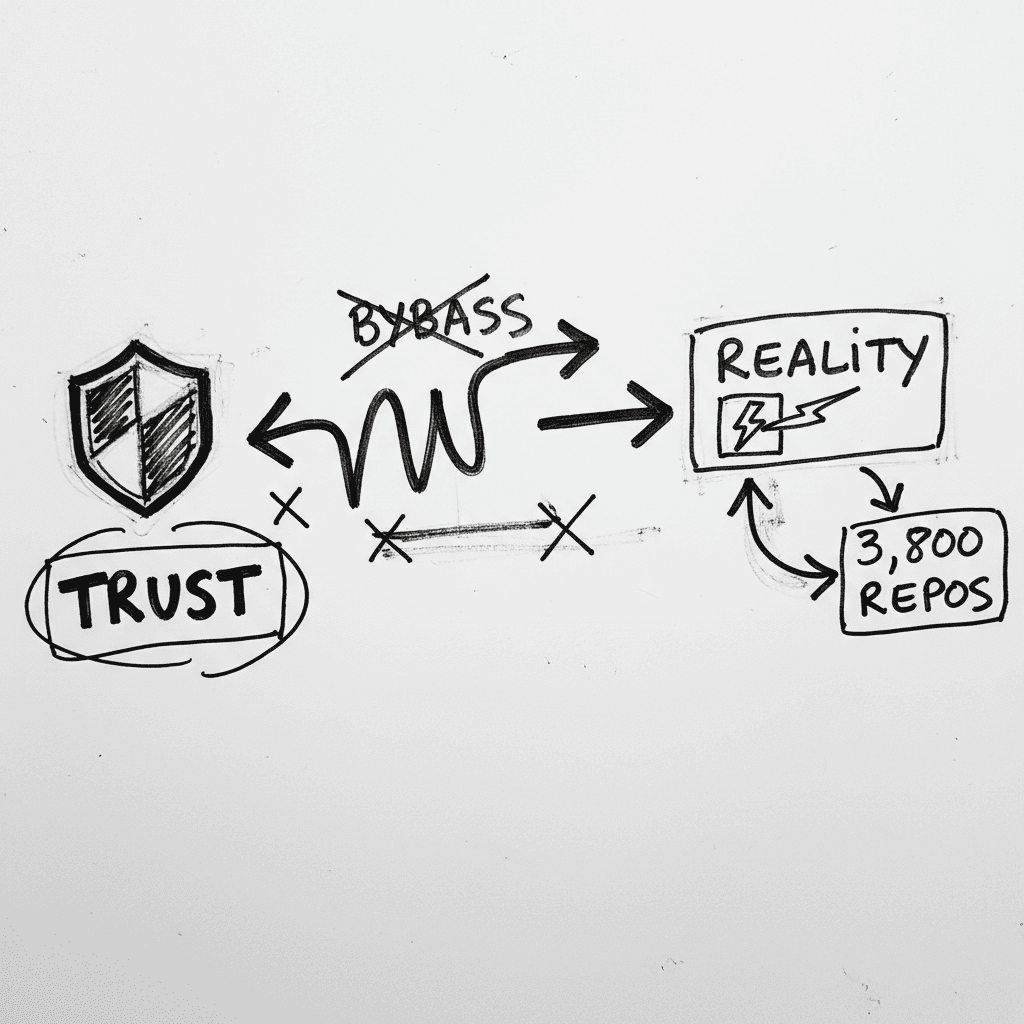

Violation de 3 800 dépôts GitHub via l'extension Nx Console

L'attaque subie par GitHub le 20 mai 2026 marque l'échec critique du modèle de sécurité de VS Code. Une mise à jour empoisonnée de l'extension Nx Console a permis à TeamPCP d'exfiltrer des milliers de

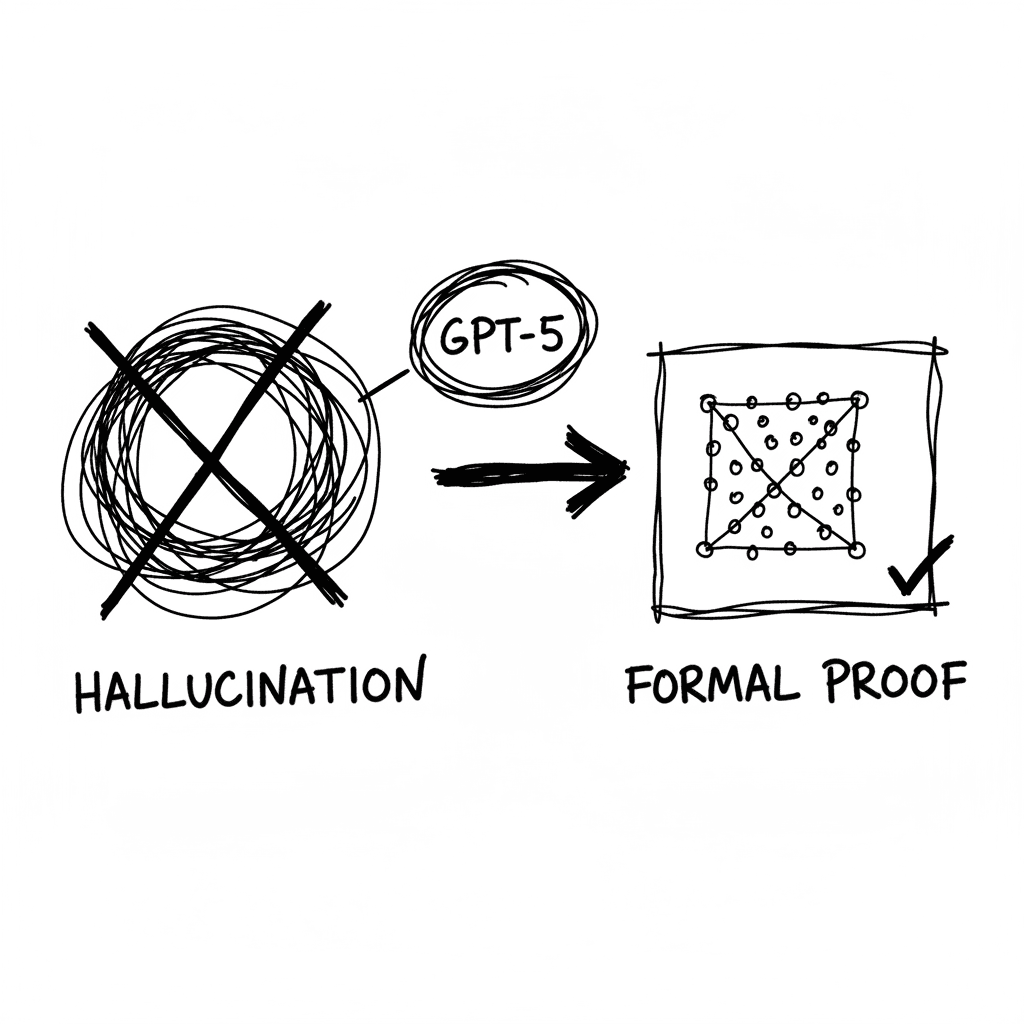

GPT-5 et la conjecture d'Erdős : validation formelle d'une découverte autonome

OpenAI vient de publier une preuve autonome réfutant la conjecture d'Erdős sur les distances unitaires planes, un problème ouvert depuis 80 ans. Contrairement aux hallucinations de recherche documenta

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.