Análisis técnico de OpenAI GPT-5.4 Thinking & Pro

OpenAI ha desplegado GPT-5.4, una actualización que unifica las líneas Codex y GPT en un único modelo con capacidades nativas de uso de computadora (fuente: 9to5Mac). La herramienta introduce el modo

El Pitch

OpenAI ha desplegado GPT-5.4, una actualización que unifica las líneas Codex y GPT en un único modelo con capacidades nativas de uso de computadora (fuente: 9to5Mac). La herramienta introduce el modo "Extreme Reasoning" y expande la ventana de contexto hasta los 1.05M de tokens para competir directamente con la infraestructura de procesamiento de documentos largos de Gemini 3 (fuente: Investing.com).

Bajo el capó

El modelo destaca por su rendimiento en automatización, alcanzando un 75.0% en el benchmark OSWorld-Verified, lo que supera la línea base humana del 72.4% en ejecución de tareas dentro de un sistema operativo (fuente: Tom's Guide). En términos de costes, la API se posiciona de forma agresiva a $2.50 por millón de tokens de entrada, lo que supone un ahorro del 50% frente a Claude 4.5 Opus (fuente: OpenRouter).

No obstante, el rendimiento en producción presenta fricciones importantes. El "Fast mode" puede inflar los costes operativos hasta 8 veces, y usuarios en entornos de desarrollo reportan que el modelo consume un 33% de los créditos mensuales en pocos minutos tras lanzar prompts de razonamiento complejo (fuente: HN Comment #2). Además, persisten problemas de degradación de memoria; el modelo muestra síntomas de "olvido" de instrucciones recientes y alucinaciones sobre su capacidad para acceder a URLs (fuente: HN Comment #3/5).

A nivel de latencia, el modo de razonamiento extremo requiere esperas de más de dos minutos por respuesta, invalidando su uso para aplicaciones que requieran feedback instantáneo (fuente: HN Comment #2). Aún no sabemos cómo rinde este modo frente a los agentes de código de Claude 4.5 ni existe transparencia sobre los multiplicadores de precio exactos para clientes Enterprise (Dossier UsedBy).

La opinión de Diego

GPT-5.4 es una herramienta técnica solvente para tareas de sistema operativo, pero su gestión del contexto sigue por detrás de lo que ofrece el ecosistema de Google en 2026. La reducción de alucinaciones del 33% es un avance real, pero la inestabilidad de costes del "Fast mode" lo convierte en un riesgo financiero para startups sin supervisión estricta de tokens. Mi consejo: utilízalo exclusivamente para pipelines asíncronos donde el tiempo de respuesta no sea crítico y mantén tus workflows de arquitectura de software en Claude 4.5 Opus hasta que OpenAI resuelva la amnesia de su ventana de contexto.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

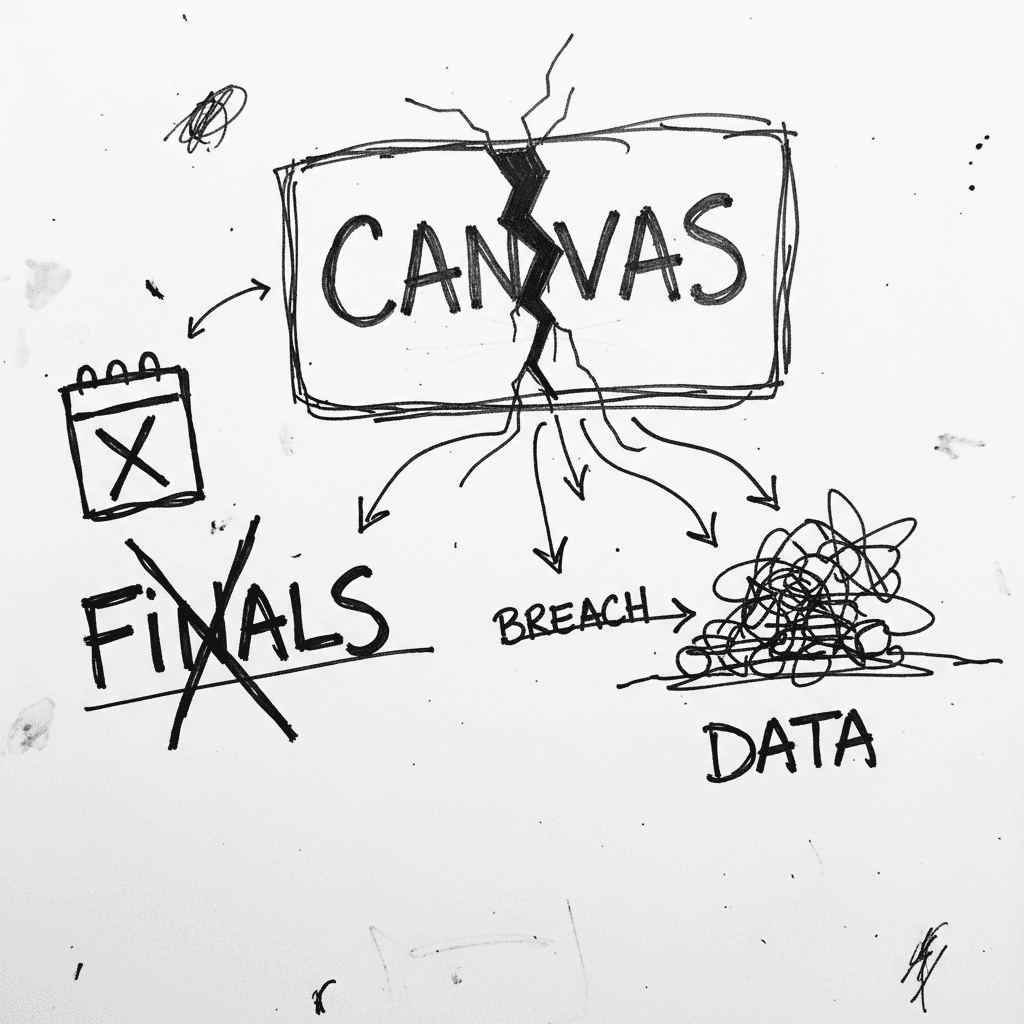

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.