Les assistants IA coding sont-ils vraiment utiles? Le débat fait rage

IEEE Spectrum pose la question qui fâche: les assistants IA de code se dégradent-ils? Entre assemblage de blocs et vraie création, analyse du débat.

Le Pitch

Les assistants IA de coding, la promesse d'un gain de productivité massif, d'un code propre et d'un développeur heureux. Mais est-ce vraiment le cas ? Ou assistons-nous à une lente dégradation de leur utilité, les voyant passer du statut de "super-aide" à celui de simple "générateur de boilerplate" ?

Sous le capot

Le débat fait rage. L'article d'IEEE Spectrum, "AI coding assistants are getting worse?", a mis le feu aux poudres, avec un torrent de plaintes sur Hacker News. Les devs se disent frustrés : suggestions de code erronées, hallucination de fonctions inexistantes, incapacité à comprendre le contexte profond du projet... L'euphorie initiale semble s'être dissipée.

Un article plus récent, "Claude is good at assembling blocks, but still falls apart at creating them", pointe du doigt une limitation fondamentale des LLMs : ils excellent dans l'assemblage de fragments de code existants, dans la reproduction de patterns qu'ils ont vus mille fois, mais peinent à réellement *créer* quelque chose de neuf, d'innovant, qui demande une compréhension plus profonde des enjeux et des contraintes.

Pourquoi cette possible dégradation ? Plusieurs hypothèses sont avancées :

- Surentraînement sur du code médiocre : Les LLMs sont entraînés sur des quantités massives de code, dont une bonne partie est loin d'être exemplaire. Difficile d'en sortir de bons modèles si la matière première est de mauvaise qualité.

- Complexité croissante des projets : Les assistants IA peuvent gérer des tâches simples, mais se noient face à la complexité d'une architecture sophistiquée, d'une base de code conséquente. Ils manquent souvent de la vision d'ensemble nécessaire.

- Dépendance excessive : Le risque est que les devs, trop confiants, ne vérifient plus le code généré par l'IA, introduisant des bugs et des vulnérabilités sans s'en rendre compte. L'assistant IA devient un boulet.

La différence entre "assembler" et "créer" est cruciale. Un assistant IA peut vous générer rapidement une fonction pour trier un tableau, mais il aura du mal à comprendre et à implémenter une logique métier complexe et spécifique à votre application. C'est comme demander à un robot de monter un meuble IKEA (il se débrouille) et lui demander de concevoir un meuble ergonomique sur mesure (là, c'est le drame).

L'avis de Ruben

Soyons clairs : je ne crois pas à la disparition des assistants IA de coding. Ce sont des outils puissants, qui peuvent indéniablement accélérer certaines tâches, automatiser le boilerplate, et nous éviter des erreurs de frappe. Mais il faut les utiliser avec discernement.

Personnellement, j'utilise parfois Copilot pour générer des tests unitaires ou pour écrire des commentaires. C'est pratique, ça me fait gagner du temps. Mais je ne lui confie jamais des tâches critiques. Je vérifie toujours son code, je le remets en question. Je ne me suis jamais dit : "Ah, super, l'IA a tout fait, je peux aller prendre un café".

Le problème n'est pas tant dans l'outil lui-même que dans la façon dont on l'utilise. Il faut éviter de devenir dépendant, de perdre son esprit critique, de laisser l'IA penser à notre place. Les assistants IA de coding sont des outils, pas des remplaçants. L'avenir, c'est la collaboration intelligente, pas la délégation aveugle.

Il est possible qu'on observe un "plateau" dans leur progression, voire une légère régression si on ne fait pas attention. Mais je reste optimiste. Avec des données d'entraînement de meilleure qualité, des modèles plus sophistiqués, et une utilisation plus responsable, les assistants IA de coding ont encore un bel avenir devant eux. À condition de ne pas leur laisser les clés du royaume.

---

Codez propre,

Ruben.

Ruben Isaac est le Lead AI Tech Watcher de UsedBy.ai. À 29 ans, il traque les nouveautés tech avec un oeil de développeur. Sceptique par défaut, il ne fait confiance qu'au code et aux benchmarks.

Voir tous les articles de cet auteurArticles connexes

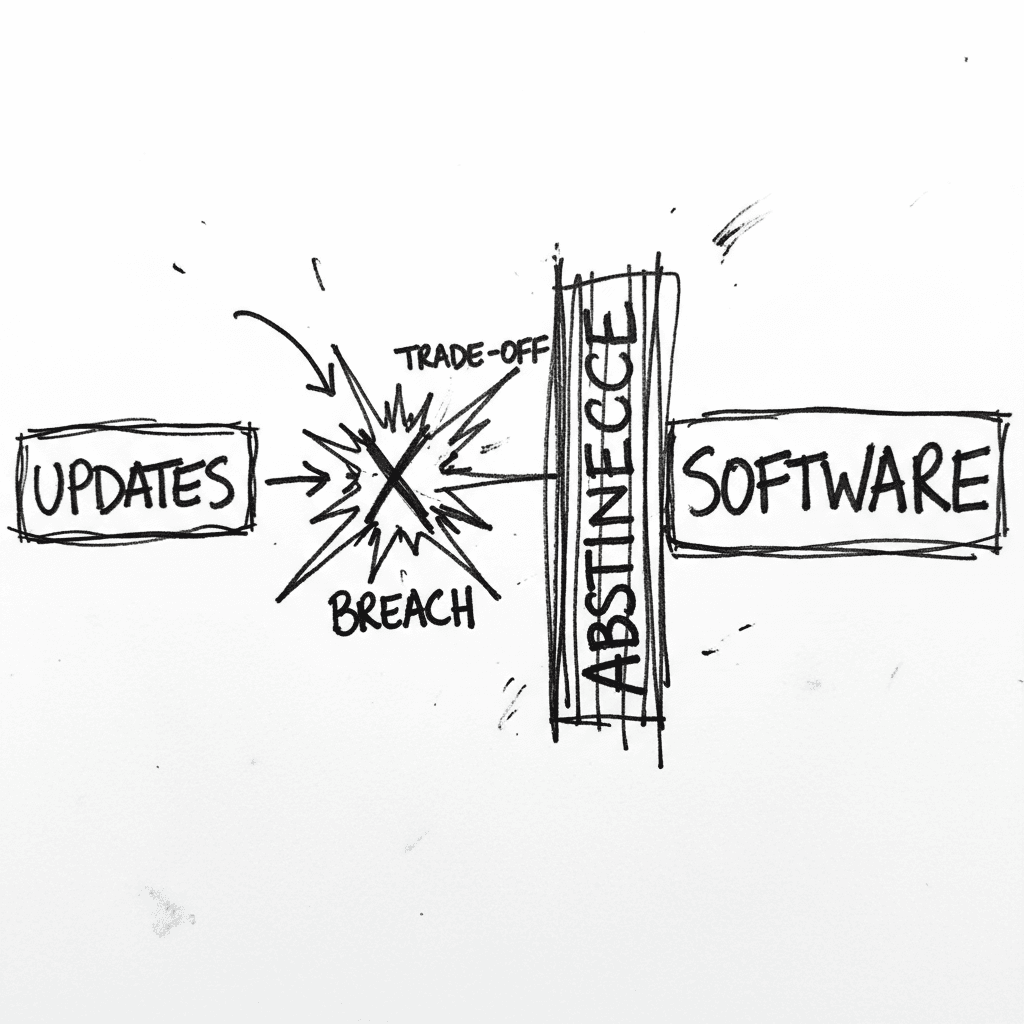

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

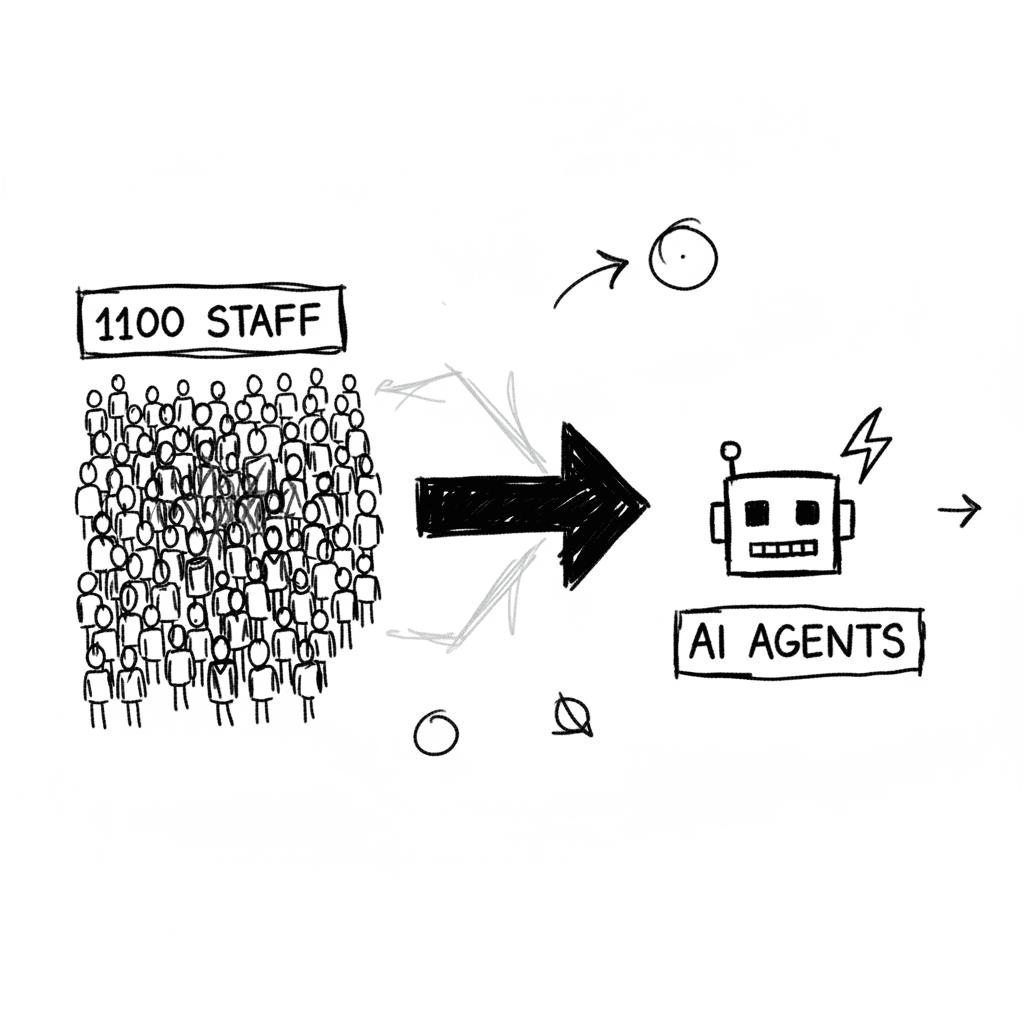

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

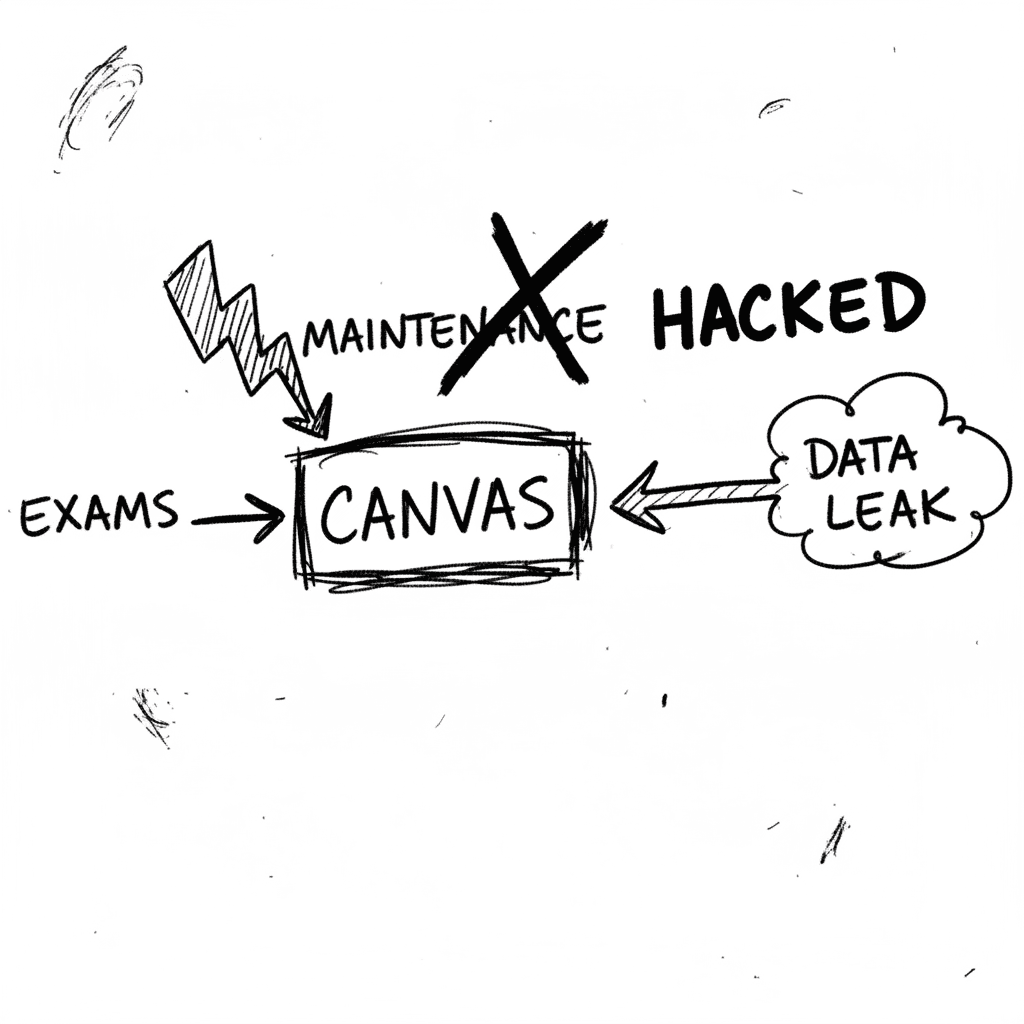

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.