Claude Opus 4.6: ventana de 1M de tokens y equipos de agentes nativos

Anthropic ha lanzado Claude Opus 4.6 introduciendo una ventana de contexto de 1M de tokens y la capacidad experimental "Agent Teams" en su CLI, Claude Code. El sistema busca automatizar flujos complet

El Pitch

Anthropic ha lanzado Claude Opus 4.6 introduciendo una ventana de contexto de 1M de tokens y la capacidad experimental "Agent Teams" en su CLI, Claude Code. El sistema busca automatizar flujos completos de ingeniería de software mediante la colaboración de múltiples agentes integrados (fuente: anthropic.com).

Bajo el capó

La capacidad de recuperación de datos (retrieval) en contextos masivos es sólida, logrando recordar 49 de 50 elementos específicos en pruebas de 733K tokens (fuente: Hacker News). En términos de razonamiento profesional, el modelo supera a GPT-5.2 por 144 puntos Elo en el benchmark GDPval-AA, posicionándose como una opción robusta para tareas de conocimiento económico (fuente: Anthropic System Card).

Sin embargo, el despliegue técnico presenta fricciones importantes. Los usuarios han reportado "instruction drift" (deriva de instrucciones), donde el modelo ignora revisiones o correcciones a planes complejos para ceñirse a los borradores iniciales (fuente: HN). Además, la versión 2.1.32 de Claude Code presenta errores de conexión con Chrome en entornos Windows, lo que complica su adopción inmediata en ciertos setups de desarrollo (fuente: Reddit).

El coste operativo es otro factor crítico para cualquier CTO. El precio escala de los $5/$25 estándar a $10/$37.50 por millón de tokens cuando el contexto supera los 200k, lo que puede agotar límites diarios de uso en apenas un par de consultas intensivas (fuente: Trending Topics). Ver ficha de Claude, que ya cuenta con 247 empresas usuarias como Notion y DuckDuckGo.

Actualmente, no disponemos de información pública sobre el coste específico de la función "Agent Teams" fuera de los planes API/Max, ni existen verificaciones independientes de los resultados de GDPval-AA más allá de los datos internos de Anthropic (fuente: Dossier UsedBy). Aunque Opus 4.6 lideró brevemente el Terminal-Bench 2.0 con un 65.4%, fue superado minutos después por GPT-5.3 Codex (fuente: OfficeChai).

La opinión de Diego

No lo metas en producción todavía. Aunque el millón de tokens suena bien en el papel, el "instruction drift" es un problema real que te hará perder más tiempo corrigiendo al modelo que escribiendo código. Es una herramienta excelente para side-projects donde quieras experimentar con la colaboración multi-agente usando CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS=1, pero la volatilidad de los benchmarks y el precio prohibitivo del contexto largo lo hacen poco práctico para el día a día de un equipo de ingeniería. Si buscas eficiencia de costes, quédate en contextos cortos o espera a que estabilicen la persistencia de las instrucciones en tareas largas.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

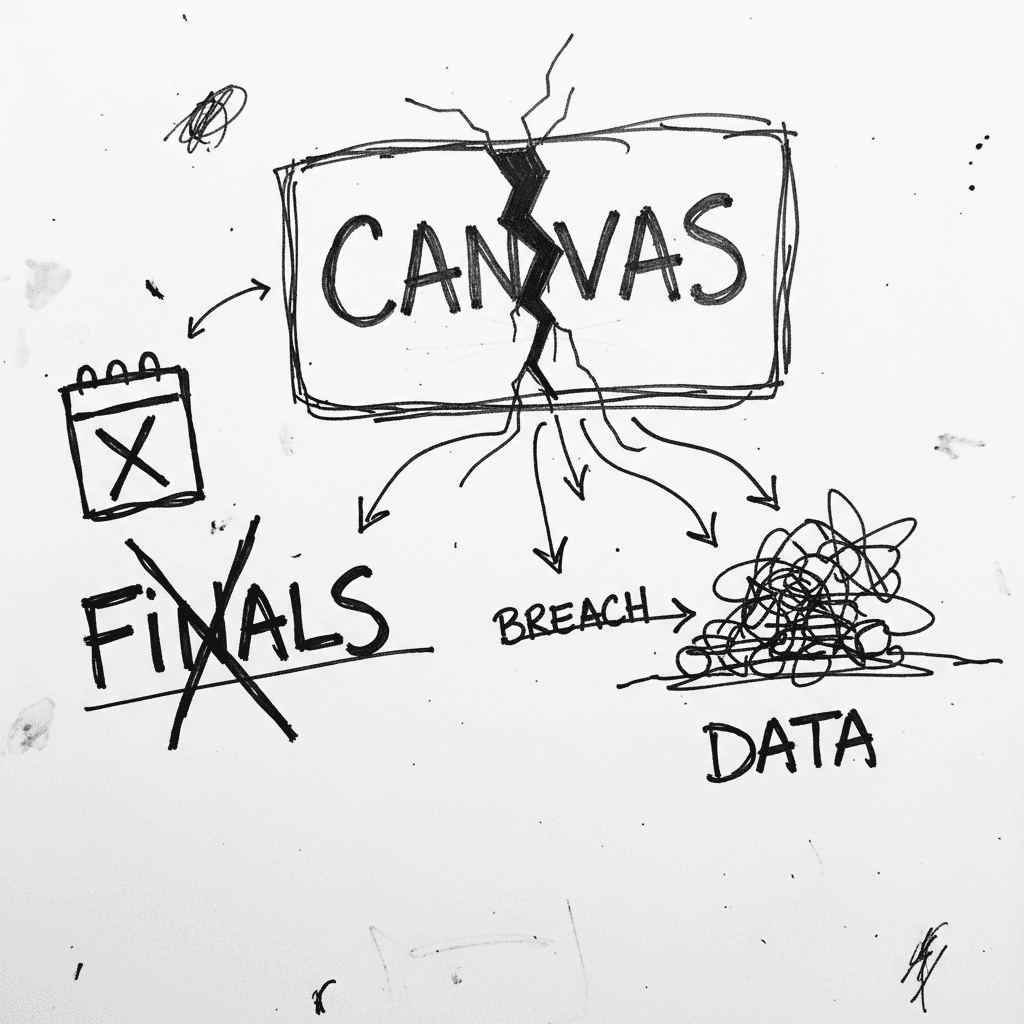

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.