GPT-5.3-Codex-Spark : 1 000 tokens par seconde au prix de la précision

OpenAI et Cerebras lancent un modèle optimisé pour le "conversational coding" en temps réel. L'idée est de privilégier l'interactivité et les modifications d'UI instantanées plutôt que l'autonomie sur

Le Pitch

OpenAI et Cerebras lancent un modèle optimisé pour le "conversational coding" en temps réel. L'idée est de privilégier l'interactivité et les modifications d'UI instantanées plutôt que l'autonomie sur de longues tâches de fond (source: OpenAI). On parle d'une latence quasi inexistante pour des itérations de code fluides, mais avec un coût non négligeable sur la qualité du raisonnement.

Sous le capot

La performance brute repose sur une intégration hardware spécifique : le Cerebras Wafer Scale Engine 3 (WSE-3). Cette puce de 4 trillions de transistors et 900 000 cœurs IA permet de dépasser les 1 000 tokens par seconde (source: The Register). En pratique, le modèle termine les tâches du SWE-Bench Pro en 2 ou 3 minutes, là où le modèle GPT-5.3 standard nécessite plus de 15 minutes (source: The Decoder).

Cependant, cette accélération se paie au benchmark. Sur Terminal-Bench 2.0, le score s'effondre à 58,4 % de précision contre 77,3 % pour le modèle de base (source: OpenAI Technical Blog). On observe un feeling "petit modèle" qui nécessite un prompt engineering très directif pour respecter des règles d'agent complexes.

Le modèle affiche une context window de 128k tokens, mais la gestion de la mémoire est loin d'être optimale. Les retours font état d'une efficacité de contexte médiocre et de compactions fréquentes dans les workflows agentiques (source: HN / Simon Willison). Le modèle est jugé "moins précautionneux" avec les informations situées en milieu de contexte, imposant des resets fréquents de la session de chat.

Certaines zones d'ombre persistent sur l'architecture exacte. OpenAI n'a pas communiqué le nombre de paramètres ni précisé s'il s'agit d'un Mixture of Experts (MoE) ou d'une distillation dense (source: Dossier UsedBy). Le tarif long terme de l'API reste aussi inconnu, le modèle étant actuellement verrouillé derrière l'abonnement "Pro" à 200 $ par mois (source: ZDNet).

L'avis de Ruben

Spark est un outil de prototypage, pas de production. Sa vitesse est utile pour générer des composants React ou du CSS à la volée, mais sa chute de score sur Terminal-Bench est un signal d'alarme pour tout ce qui touche à la logique métier complexe. Si vous l'utilisez pour du debugging système, vous allez passer plus de temps à corriger ses hallucinations de syntaxe qu'à coder. C'est un excellent compagnon pour du side-project rapide, mais je garde GPT-5.3-Codex (base) ou Claude 4.5 Opus pour mes commits critiques.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

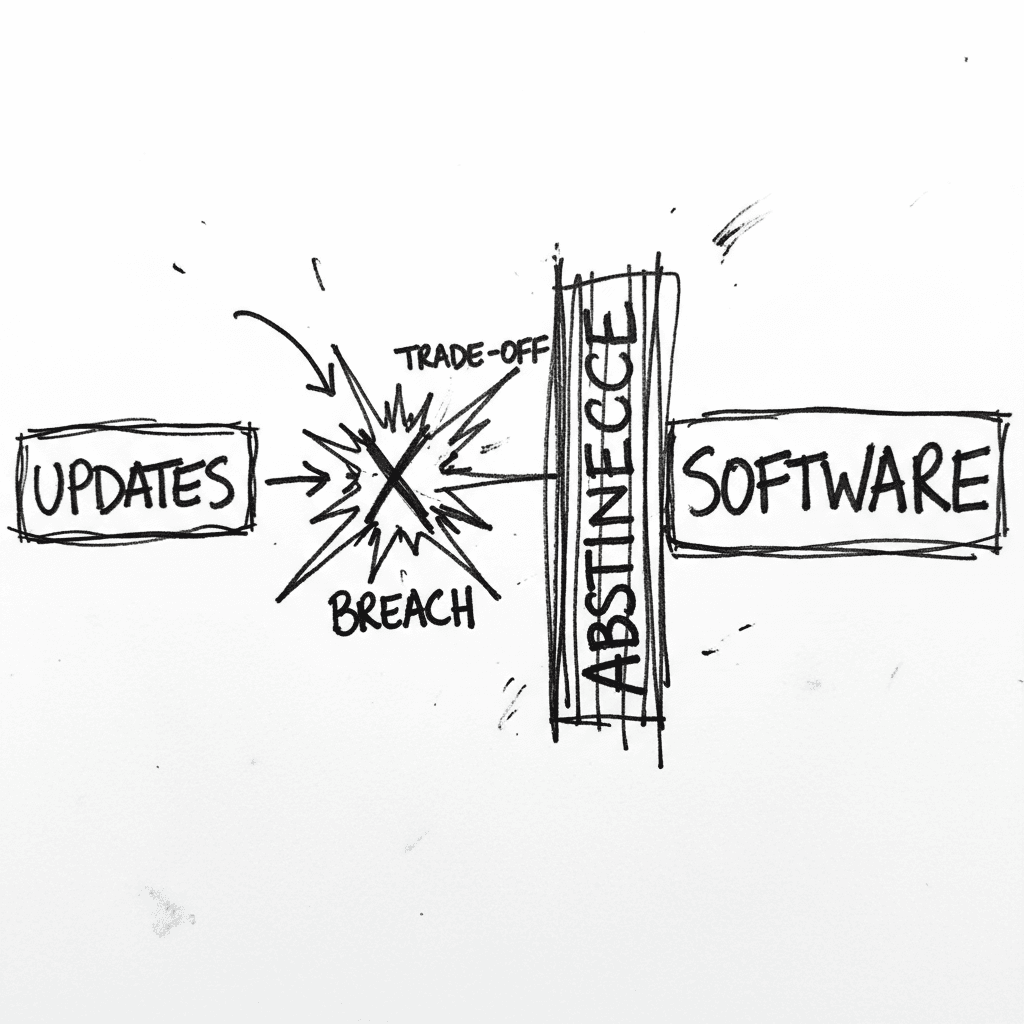

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

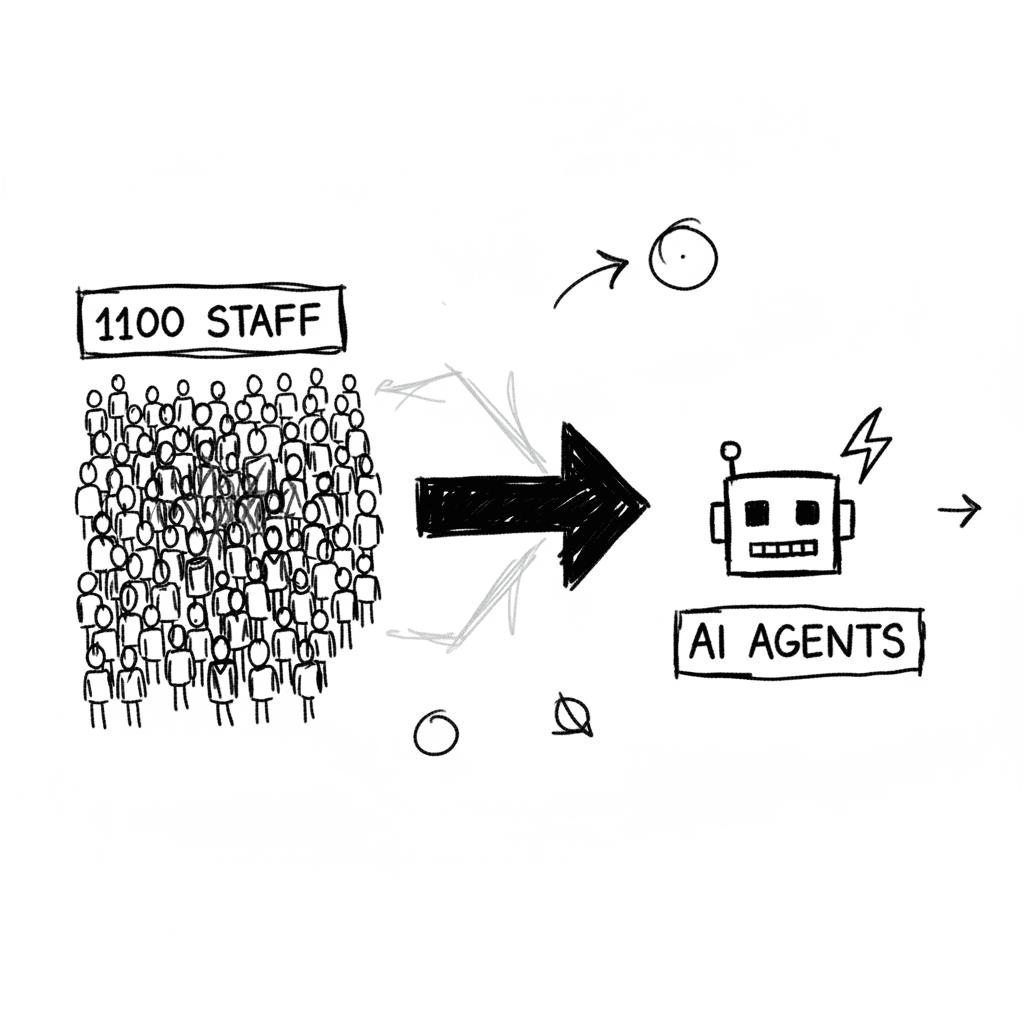

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

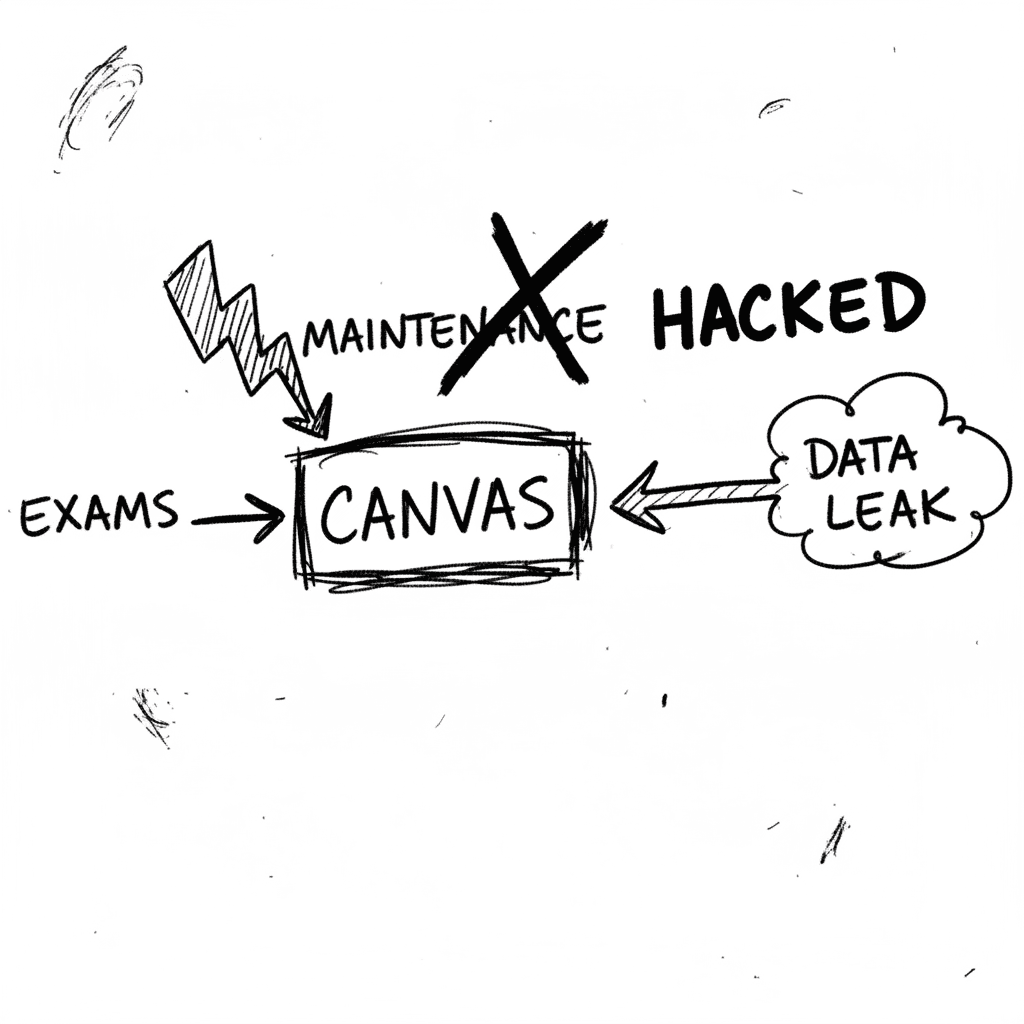

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.