GPT-5.3-Codex-Spark: mil tokens por segundo sobre hardware de Cerebras

OpenAI ha lanzado una versión destilada de su arquitectura GPT-5 optimizada exclusivamente para latencia mínima y velocidad de escritura extrema. El interés en Hacker News ha explotado debido a su int

El Pitch

OpenAI ha lanzado una versión destilada de su arquitectura GPT-5 optimizada exclusivamente para latencia mínima y velocidad de escritura extrema. El interés en Hacker News ha explotado debido a su integración nativa con el hardware WSE-3 de Cerebras, dejando de lado el silicio de NVIDIA por primera vez (fuente: HN).

Bajo el capó

El modelo entrega más de 1.000 tokens por segundo, una velocidad que lo sitúa 15 veces por encima del GPT-5.3 estándar (OpenAI Blog, Feb 12, 2026). Utiliza una conexión WebSocket persistente que reduce la latencia de ida y vuelta en un 80%, eliminando el retraso perceptible en sesiones de pair programming (MarkTechPost).

Lo que funciona:

- Velocidad de inferencia inigualable gracias a una alianza de 10.000 millones de dólares con Cerebras (SiliconANGLE).

- Integración fluida en flujos de trabajo de terminal y editores que requieren feedback en tiempo real.

- Rendimiento optimizado para tareas de boilerplate y funciones unitarias simples.

Lo que falla:

- El razonamiento profundo es mediocre: solo alcanzó un 58,4% en Terminal-Bench 2.0 frente al 77,3% del modelo insignia GPT-5.3 (The Decoder).

- Presenta dificultades críticas al gestionar cambios arquitectónicos que afectan a múltiples archivos simultáneamente (HN Comment 3).

- No alcanza la calificación de "Alta" en los protocolos de seguridad del Marco de Preparación de OpenAI (ZDNet).

- Es extremadamente sensible al prompt; si no usas instrucciones minimalistas, la calidad de la salida se degrada rápidamente (Simon Willison's Weblog).

Lo que aún no sabemos:

- Aún no conocemos los precios finales de la API, ya que actualmente está limitado al nivel de suscripción Pro de 200 dólares mensuales.

- Esa info sobre las fechas de disponibilidad global para usuarios generales de ChatGPT no es pública todavía.

La opinión de Diego

Olvídate de usar GPT-5.3-Codex-Spark para diseñar la arquitectura de tu plataforma. Su caída de rendimiento en benchmarks complejos comparado con Claude 4.5 Opus es demasiado grande como para confiarle decisiones estructurales. Es una herramienta de fuerza bruta: ideal para picar código repetitivo a la velocidad del pensamiento en side-projects, pero peligrosa en producción si no supervisas cada línea. Quédate con el modelo GPT-5.3 completo si el razonamiento importa más que la prisa.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

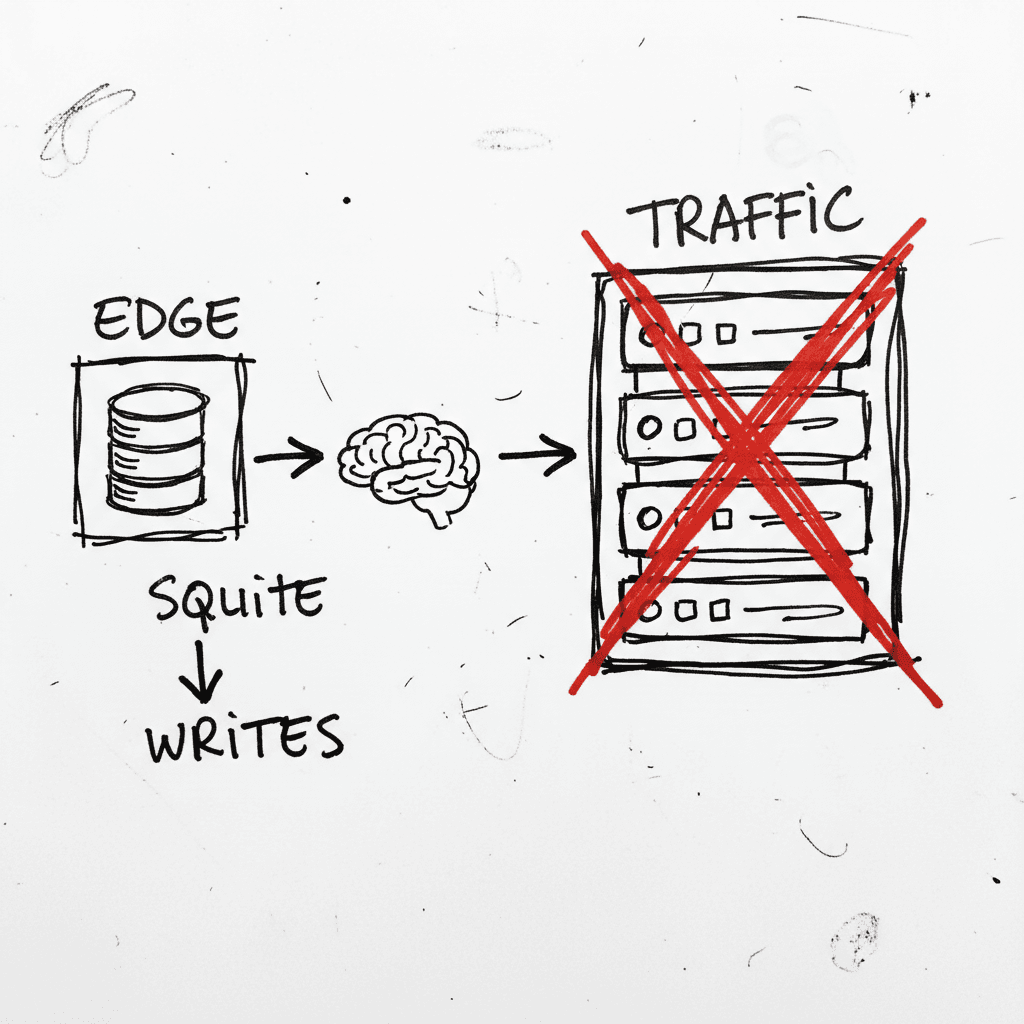

SQLite: El estándar de la Library of Congress para la persistencia en el edge

SQLite ha dejado de ser considerado una base de datos "de juguete" para convertirse en el estándar de facto en despliegues local-first y arquitecturas edge en 2026. Su reconocimiento por parte de la L

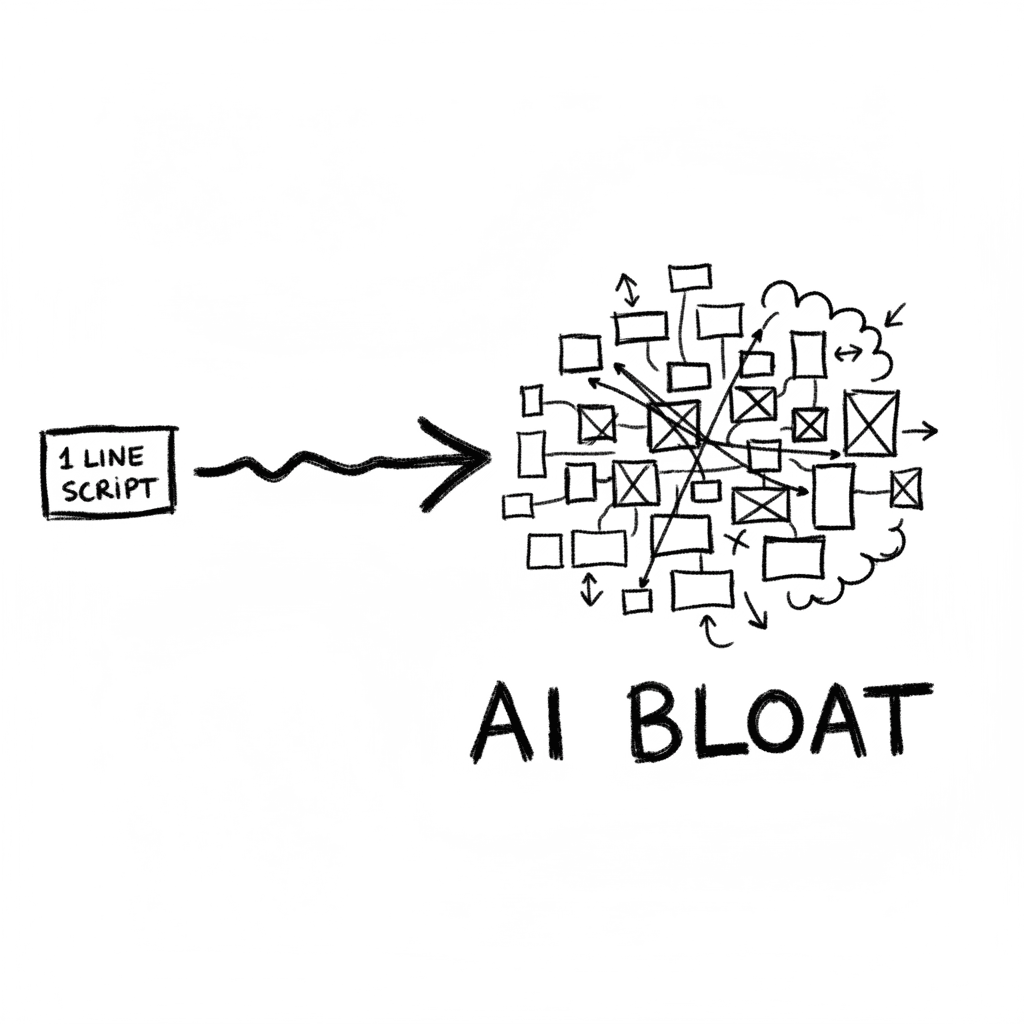

La paradoja de la productividad y la elongación de artefactos por IA

Claude 4.5 Opus y GPT-5 han permitido que perfiles junior generen entregables que, a primera vista, parecen obra de un senior con años de experiencia. La comunidad en Hacker News está analizando cómo

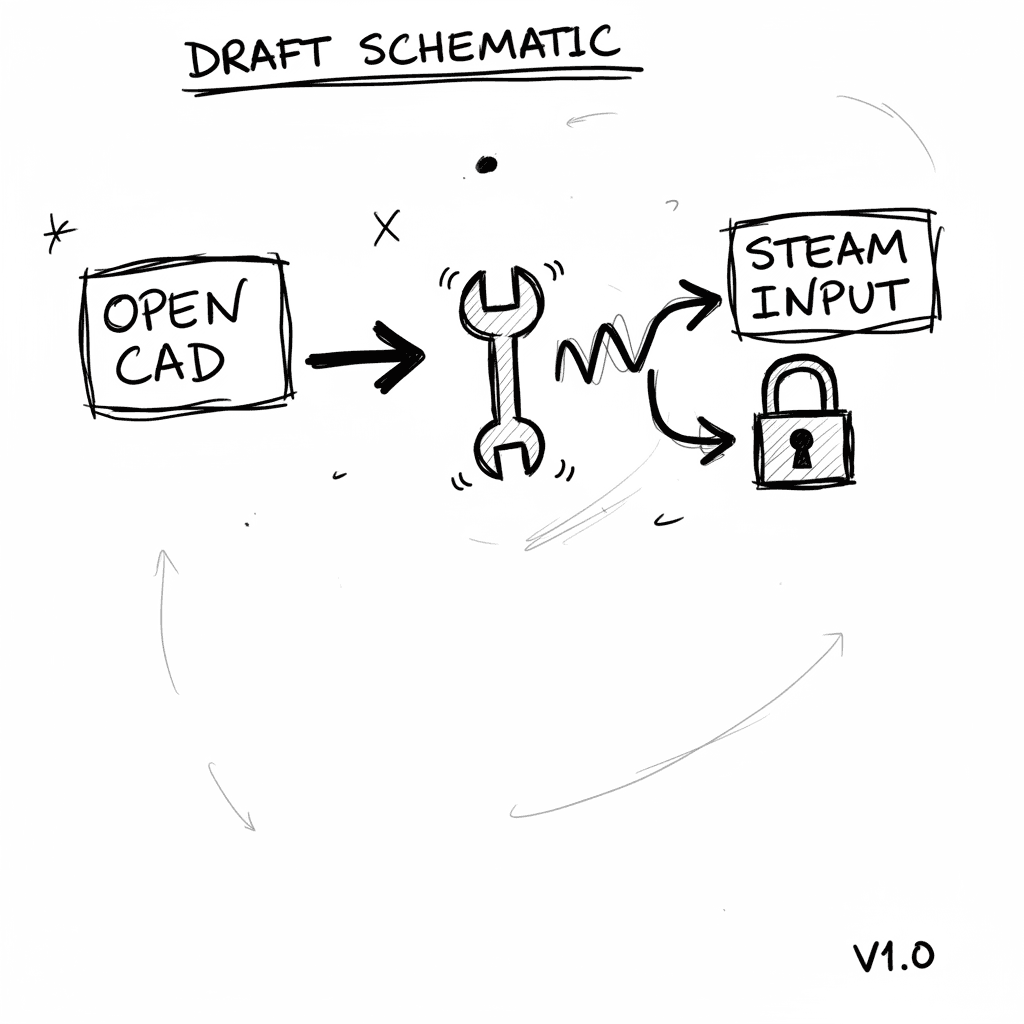

Steam Controller 2026 y Steam Controller Puck: CAD abierto y sticks TMR

Valve ha trasladado la tecnología de sticks TMR y los trackpads duales de la Steam Deck a un mando independiente que busca estandarizar el input de alta precisión. La gran noticia para la comunidad de

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.