L'obésité technique des médias : l'audit de Shubham expose le bloatware des sites de presse

News Audit dissèque la dérive technique des sites d'information modernes. L'analyse démontre qu'une simple page du New York Times peut déclencher 422 requêtes réseau et transférer 49 MB de données. Ce

Le Pitch

News Audit dissèque la dérive technique des sites d'information modernes. L'analyse démontre qu'une simple page du New York Times peut déclencher 422 requêtes réseau et transférer 49 MB de données. Ce rapport confirme ce que tout développeur soupçonnait : la stack média est devenue un agrégat de scripts marketing hors de contrôle.

Sous le capot

Le chiffre central de 49 MB pour une page de texte est absurde, mais techniquement explicable. L'audit souligne que cette charge n'est pas une défaillance de l'ingénierie backend, mais une conséquence de l'injection massive de scripts via Google Tag Manager (GTM). Ce "point d'entrée unique" permet aux équipes marketing de bypasser les cycles de déploiement pour ajouter des trackers tiers.

Côté infrastructure, l'auteur a confirmé que Cloudflare a absorbé 19,24 GB de bande passante lors du pic de viralité de l'article avec un cache hit ratio de 98,5 % (source: HN). Le problème ne réside donc pas dans la scalabilité des serveurs, mais dans l'exécution client-side. Certains cas limites montrent même des pointes à 750 MB par page à cause du pré-chargement automatique de vidéos (HN).

L'historique technique montre que cette situation est structurelle. Des projets d'optimisation de performance, notamment chez The New Yorker, ont été abandonnés au profit de Google AMP, accumulant une dette technique massive (source: ancien dev NYer sur HN). Aujourd'hui, les utilisateurs aguerris ripostent en bloquant le JS ou en utilisant des solutions DNS-level comme Pi-hole (HN Comment).

On ne sait pas encore comment les prochains LLM-agents, comme GPT-5 ou Claude 4.5 Opus (anticipés pour l'horizon 2026), gèrent cet overhead de 49 MB lors du scraping de news en temps réel. Le coût d'inférence lié au nettoyage de ce bruit pour extraire le texte utile reste une zone d'ombre technique pour les développeurs d'outils de monitoring IA.

L'avis de Ruben

C'est une faute professionnelle collective déguisée en nécessité business. Si vous développez une application qui consomme des flux de presse, ne vous fatiguez pas à optimiser votre parsing : passez par des instances de lecture headless ou des extracteurs de texte pur. Attendre que 422 requêtes se terminent pour extraire trois paragraphes est une perte de temps et de ressources. Le web média est devenu un champ de mines de scripts ; protégez vos agents et vos budgets d'inférence en restant loin du rendu DOM standard.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

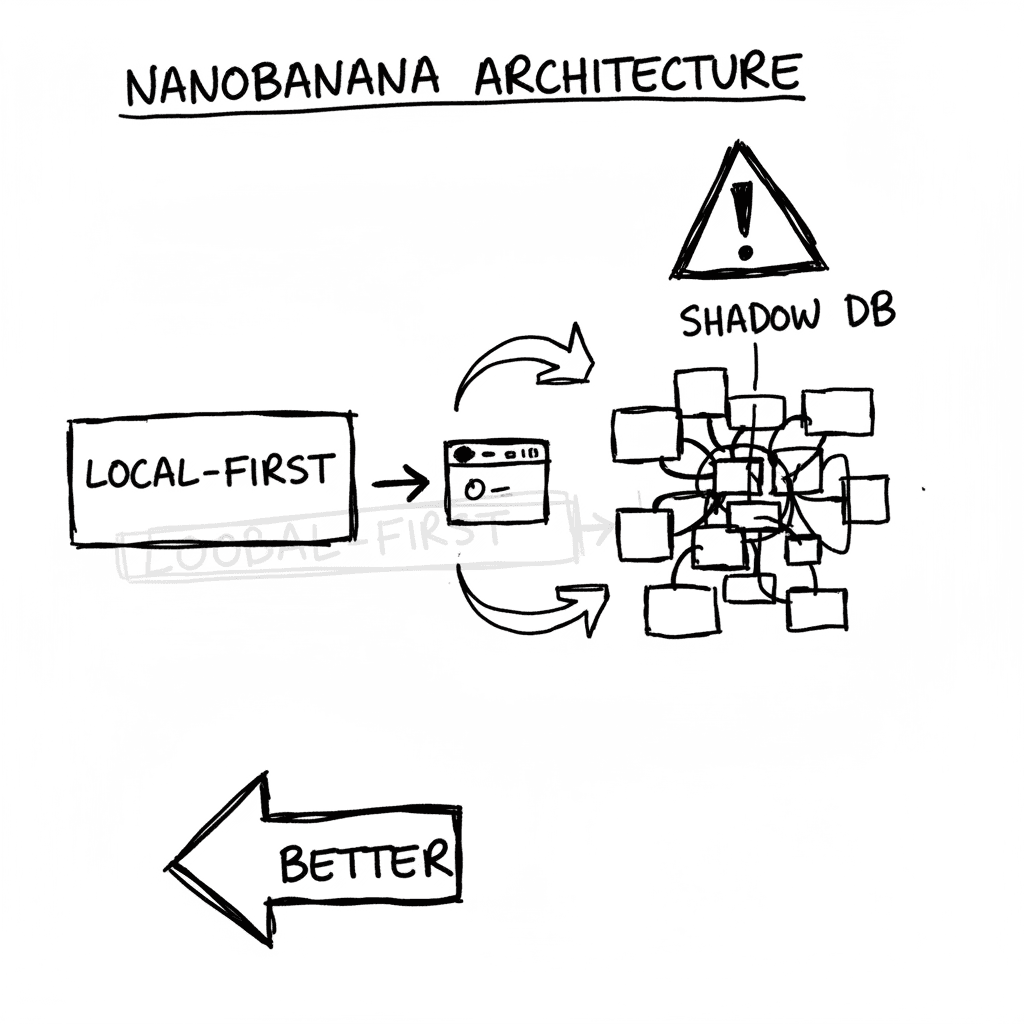

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

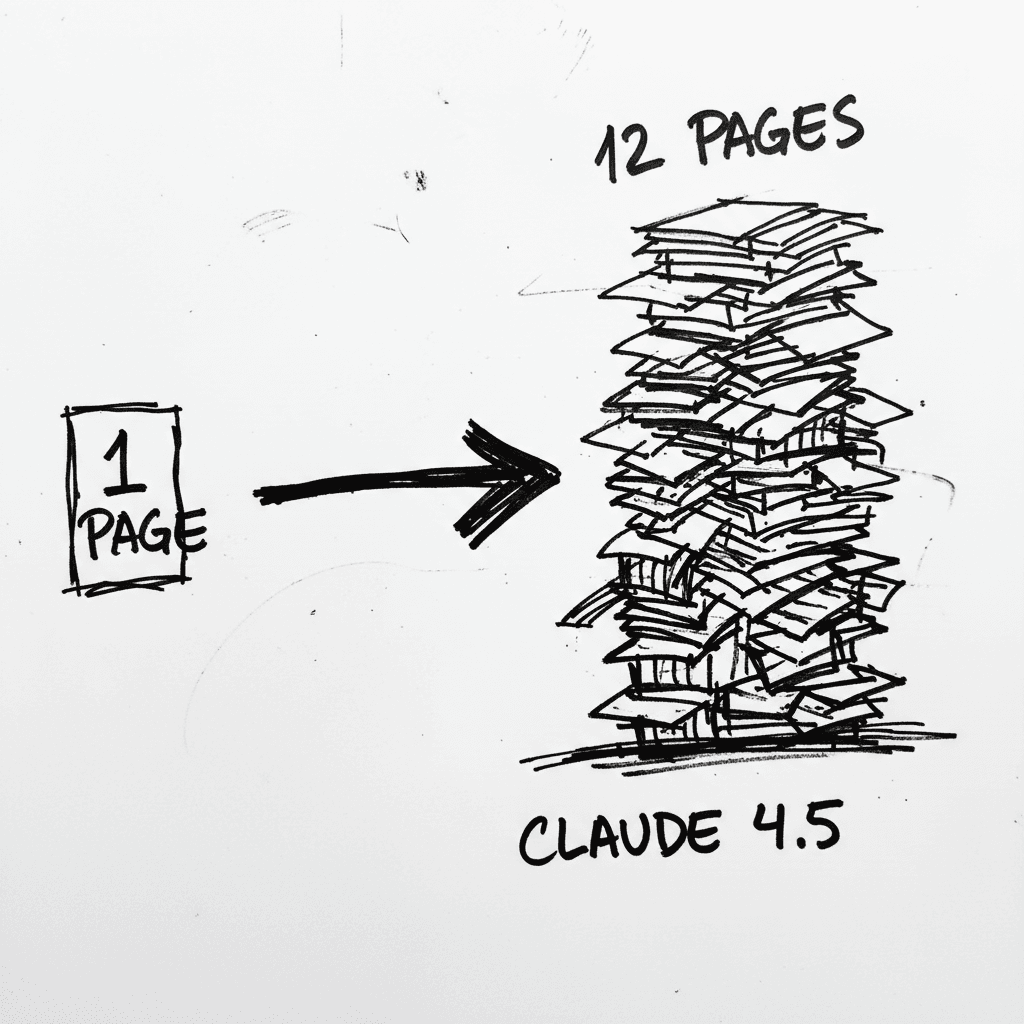

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

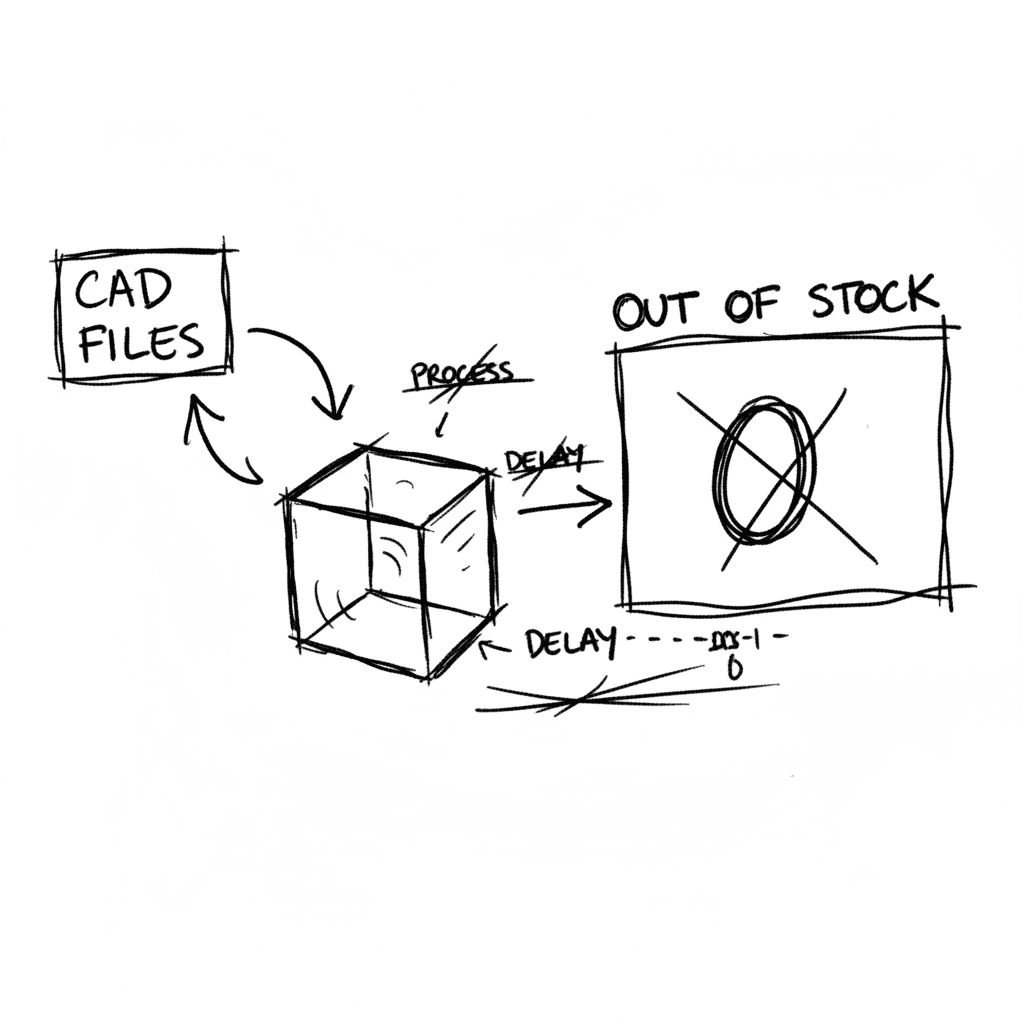

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.