L'opérateur EML et l'unification symbolique des fonctions élémentaires

Andrzej Odrzywołek (Université Jagellonne) propose de réduire l'intégralité des fonctions scientifiques à un unique opérateur binaire : $eml(x,y) = \exp(x) - \ln(y)$. En combinant cet opérateur à la c

Le Pitch

Andrzej Odrzywołek (Université Jagellonne) propose de réduire l'intégralité des fonctions scientifiques à un unique opérateur binaire : $eml(x,y) = \exp(x) - \ln(y)$. En combinant cet opérateur à la constante 1, il devient théoriquement possible de générer toutes les fonctions élémentaires et constantes fondamentales (arXiv:2603.21852v2). Ce minimalisme attire l'attention car il transforme la régression symbolique en une simple optimisation d'arbres binaires uniformes.

Sous le capot

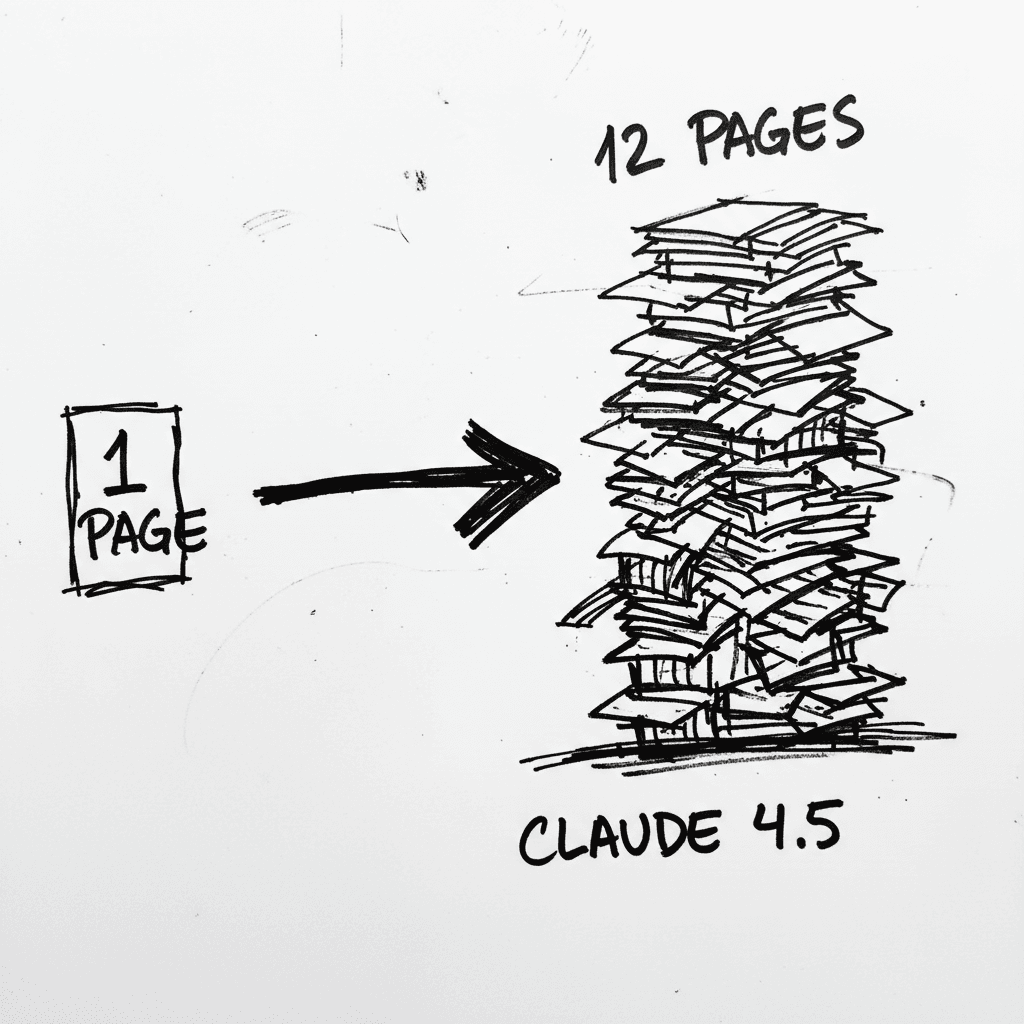

L'unification repose sur une structure d'arbre où chaque nœud est identique, facilitant l'usage d'optimiseurs comme Adam pour la recherche de fonctions par gradient (source: arXiv Abstract). Cette homogénéité structurelle sert désormais de benchmark de raisonnement pour les modèles frontier de 2026. GPT-5 et Gemini 2.5 réussissent les tests de composition, tandis que Claude 4.5 Opus nécessite une assistance au prompting pour ne pas s'enfermer dans des définitions circulaires (source: HN Thread).

La mise en œuvre pratique révèle des limites structurelles majeures. La dérivation des nombres négatifs dans le papier semble reposer sur des identités valides uniquement comme limites, ce qui pose problème pour le calcul standard (source: HN Comment). L'expression de fonctions basiques subit une inflation exponentielle : une simple multiplication exige un arbre de profondeur 8 comportant plus de 41 feuilles.

Le coût computationnel est un autre frein sérieux. Maintenir l'universalité de l'opérateur impose de travailler dans le domaine complexe $\mathbb{C}$ en utilisant la branche principale. À ce jour, aucune donnée d'efficacité hardware n'a été publiée pour comparer l'EML aux opérations flottantes CPU/GPU classiques (source: Dossier UsedBy). On ne sait pas encore si un compilateur optimisé sera rendu public, le code source mentionné dans l'étude restant introuvable sur GitHub.

L'avis de Ruben

L'opérateur EML est une curiosité académique utile pour tester la logique formelle de vos agents, mais c'est une impasse pour la production. L'inflation de la profondeur des arbres rend le coût d'inférence prohibitif par rapport aux primitives standards. C'est un excellent sujet de recherche pour ceux qui travaillent sur l'interprétabilité des architectures neuronales, mais pour du calcul scientifique appliqué, passez votre chemin. Le rapport coût-performance est catastrophique.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

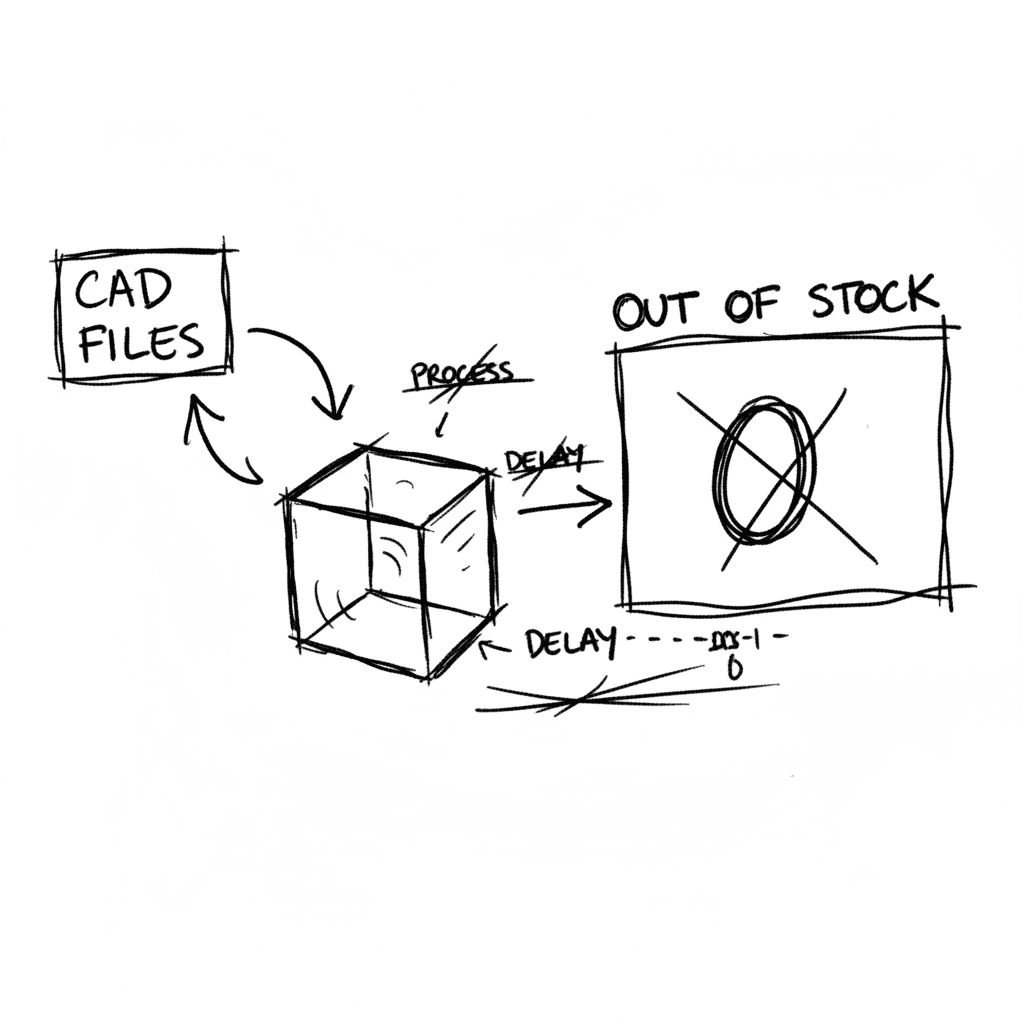

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.