Mistral Forge : l'infrastructure d'entraînement propriétaire face au chaos de la nomenclature Devstral

Mistral Forge est une plateforme d'infrastructure lancée le 17 mars 2026, conçue pour permettre aux entreprises de s'affranchir du simple mode "consommation" de LLM. L'outil propose de gérer tout le c

Le Pitch

Mistral Forge est une plateforme d'infrastructure lancée le 17 mars 2026, conçue pour permettre aux entreprises de s'affranchir du simple mode "consommation" de LLM. L'outil propose de gérer tout le cycle de vie d'un modèle, du pré-entraînement initial au Reinforcement Learning, pour créer des systèmes "domain-aware" sur infrastructure privée (Mistral Blog, March 2026). La promesse est simple : posséder son IA plutôt que de la louer à prix d'or à OpenAI ou Anthropic.

Sous le capot

L'architecture de Forge supporte nativement les modèles denses et Mixture-of-Experts (MoE), incluant le récent Mistral Small 4 de 119B paramètres (6B actifs) (Silicon Republic, March 2026). La plateforme intègre des pipelines de post-training avancés comme le SFT, le DPO et l'ODPO, déjà validés en production par des acteurs comme ASML, Ericsson et l'Agence Spatiale Européenne (GIGAZINE, March 2026). Pour pallier le manque de savoir-faire interne des clients, Mistral déploie des Forward-Deployed Engineers (FDE) spécialisés dans la curation de datasets (TrendingTopics.eu, March 2026).

Le premier point de friction technique réside dans l'utilisation du terme "pré-entraînement" pour des jeux de données corporate. Une partie de la communauté souligne avec raison qu'une base de données interne, même massive, justifie rarement un pré-entraînement "from scratch" face à un SFT intensif bien calibré (source: HN). Il s'agit ici d'un arbitrage coût-performance qui reste à démontrer pour les structures n'ayant pas la volumétrie de l'ESA.

La gestion des versions devient également un cauchemar pour les équipes DevOps. La nomenclature actuelle mélange les tags "Devstral" et "Codestral" avec des versions opaques comme "devstral-2512" ou "devstral-medium-2507" (source: HN). Identifier le flagship Devstral 2 dans ce catalogue est inutilement complexe, d'autant que son nombre exact de paramètres n'est toujours pas public, les rapports oscillant entre 24B et 123B.

Enfin, l'argument financier est à double tranchant. Si l'inference sur Forge est agressive à 0,40 $/M de tokens — soit environ sept fois moins cher que Claude 4.5 Opus à 3 $/M — le ticket d'entrée hardware est colossal (VentureBeat, March 2026). Pour les entreprises ne bénéficiant pas de partenariats privilégiés avec Nvidia, le coût du compute pour un entraînement complet reste prohibitif par rapport à l'usage d'un modèle SOTA comme GPT-5 ou Gemini 2.5.

L'avis de Ruben

Mistral Forge est un excellent outil pour les 1 % d'entreprises qui possèdent réellement des données propriétaires uniques et les clusters GPU pour les transformer. Pour les autres, c'est un piège à complexité. Si vous n'avez pas d'ingénieurs capables de valider une politique de Reinforcement Learning en interne, Forge restera une usine à gaz coûteuse. On l'utilise en prod uniquement pour des besoins de souveraineté absolue, sinon on se contente de l'API Devstral pour le code.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

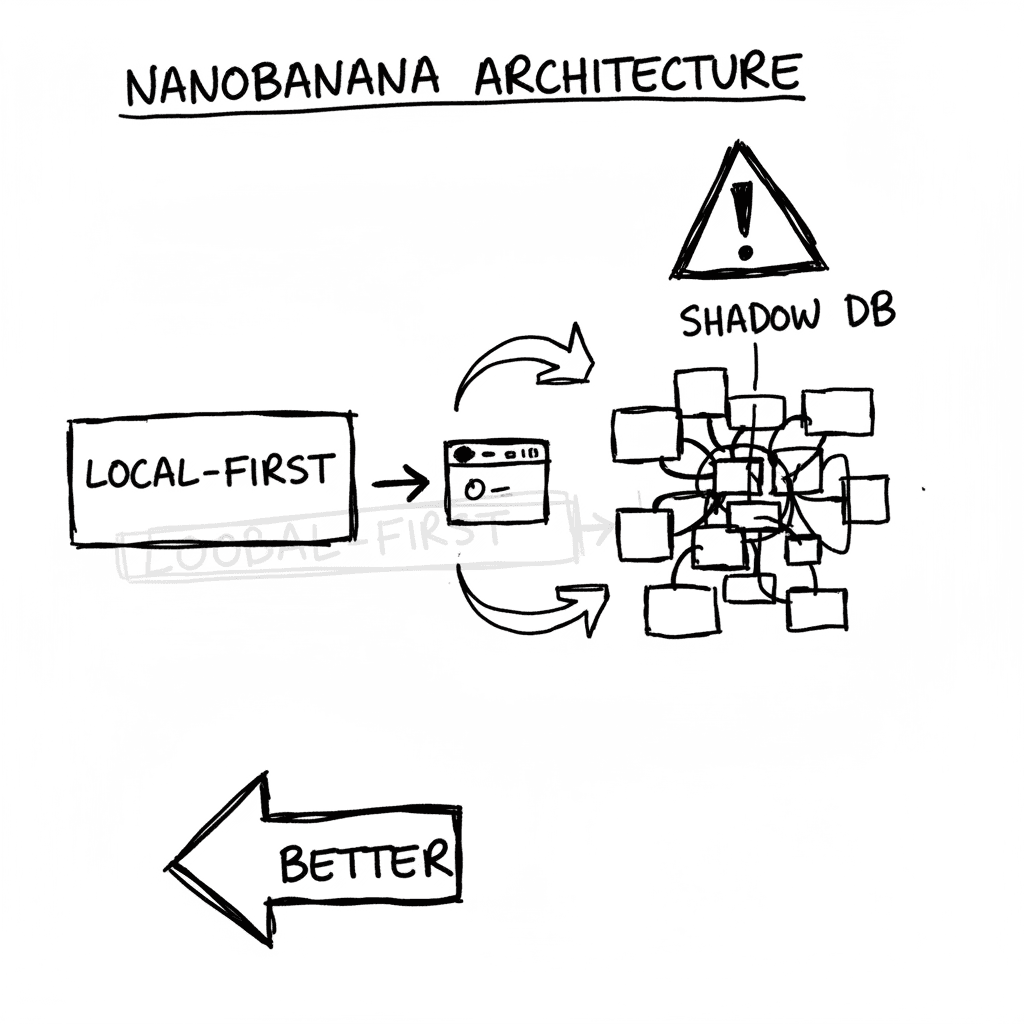

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

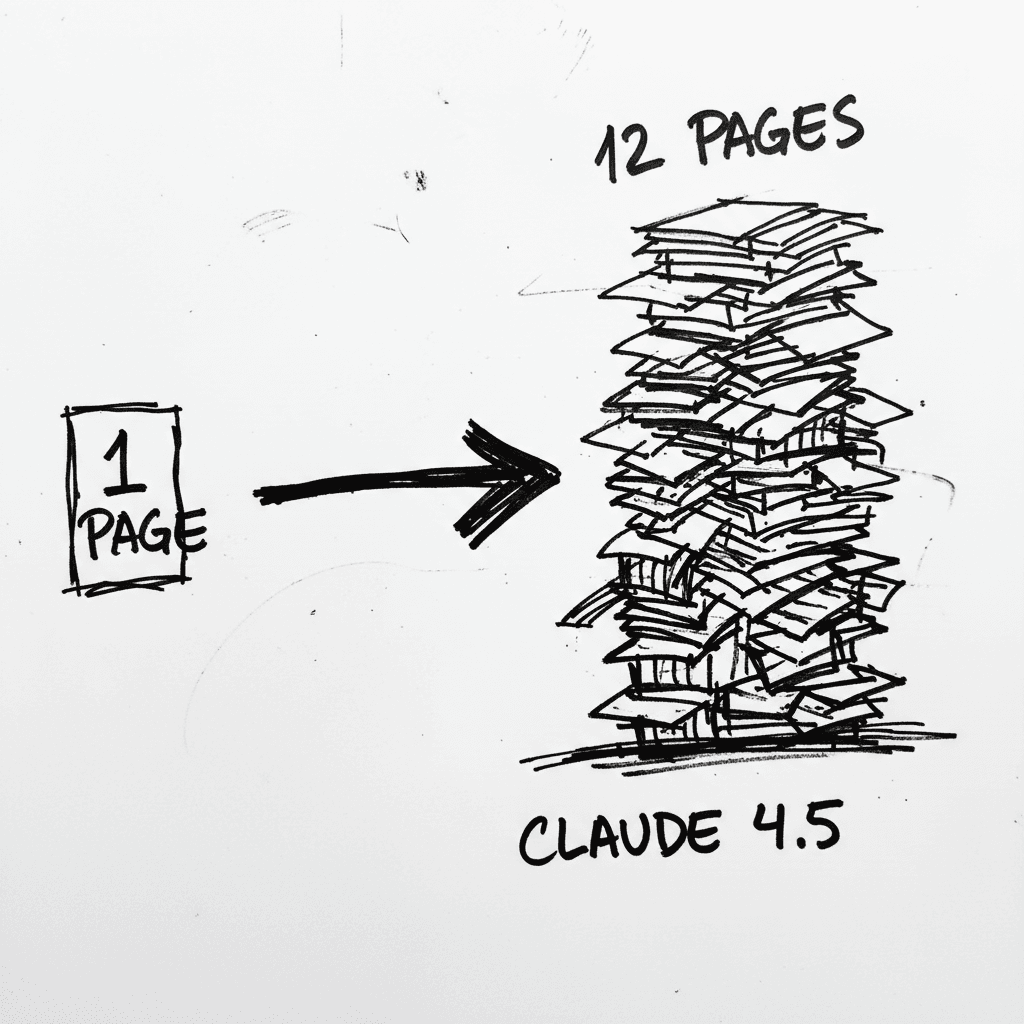

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

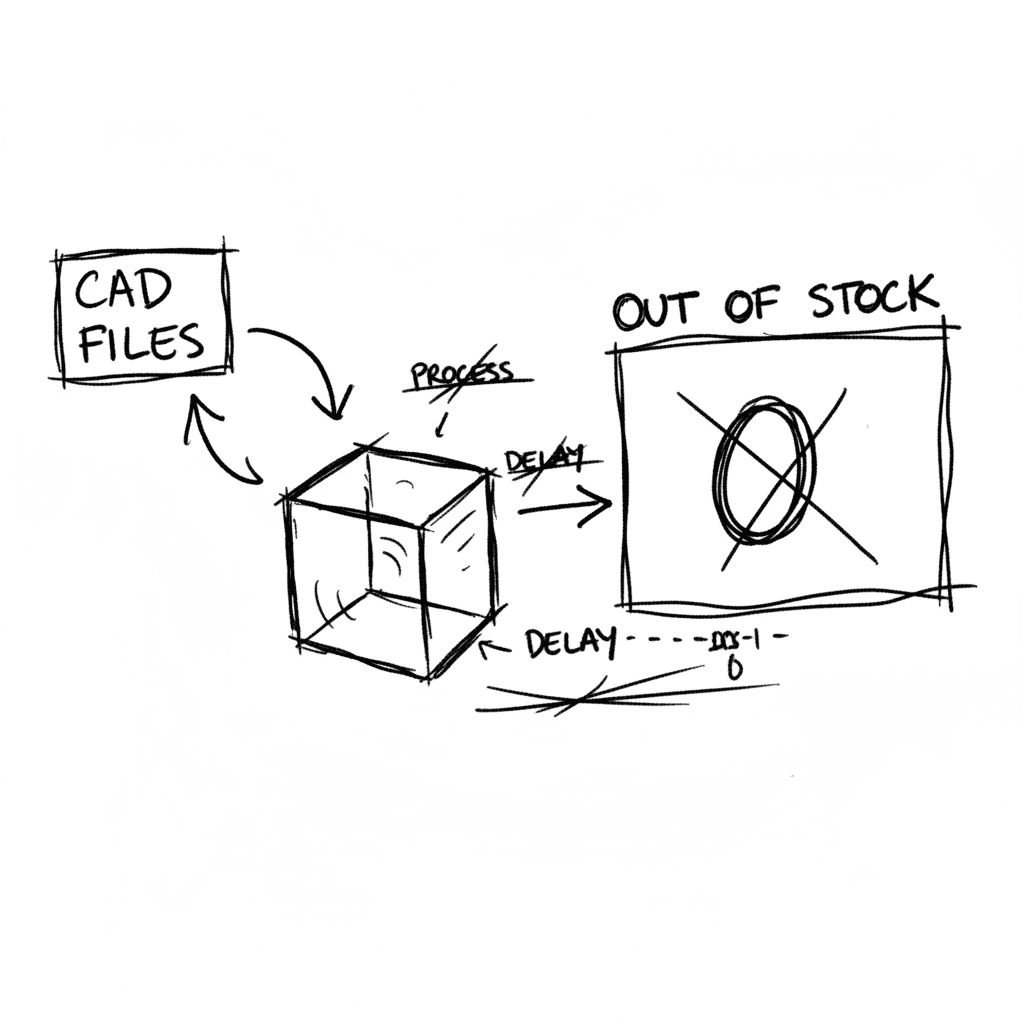

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.