OpenClaw : framework d'agent local et risques critiques d'exécution de code

OpenClaw est un framework d'agent IA open-source, créé par Peter Steinberger, conçu pour fonctionner en autonomie constante via une architecture de démon appelée "Heartbeat" (source: Petronella Tech).

Le Pitch

OpenClaw est un framework d'agent IA open-source, créé par Peter Steinberger, conçu pour fonctionner en autonomie constante via une architecture de démon appelée "Heartbeat" (source: Petronella Tech). Contrairement aux LLM réactifs classiques, cet outil agit de manière proactive sur 20 canaux de messagerie pour exécuter des tâches en arrière-plan 24h/24 (source: OpenClaw).

Sous le capot

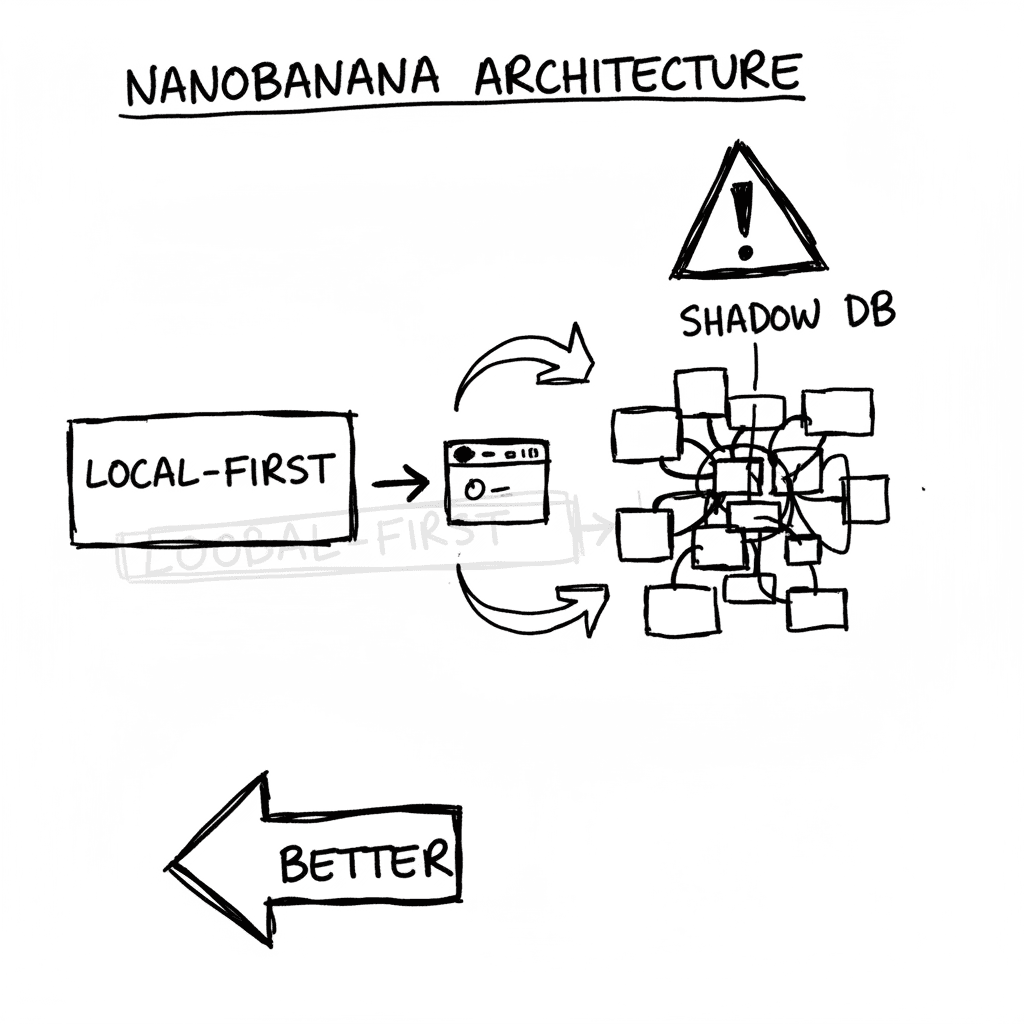

Le projet, renommé OpenClaw en janvier 2026, cumule plus de 250 000 stars sur GitHub mais souffre d'une architecture de sécurité datée, qualifiée de "Telnet-era" (source: LinuxJournal). Sa dépendance critique, LiteLLM (v1.82.7/8), a été compromise par le groupe TeamPCP le 24 mars 2026 pour exfiltrer des clés SSH et des credentials cloud (source: Snyk / Alibaba Cloud).

L'isolation des processus est quasi inexistante, le framework s'appuyant sur des system prompts pour restreindre les actions de l'agent au lieu d'utiliser des permissions au niveau du kernel (source: FlyingPenguin). Cette faille permet des injections de prompts indirectes via des emails ou des pages web, capables d'injecter des instructions malveillantes dans le fichier HEARTBEAT.md pour prendre le contrôle du root (source: HiddenLayer).

La consommation de jetons sur les modèles de fondation explose rapidement à cause des boucles de vérification incessantes du démon. Les utilisateurs rapportent des factures API atteignant 300 dollars par mois pour des déploiements standards, l'effet multiplicateur des agents déclenchant jusqu'à 6 appels cachés par message utilisateur (source: CometAPI / GlobalGPT / DockClaw).

On ne sait pas encore quelles sont les modalités de partage de données depuis que Peter Steinberger a rejoint OpenAI début 2026 (source: LinuxJournal). De plus, aucune feuille de route officielle n'a été publiée pour corriger la vulnérabilité de la supply chain Python au-delà du simple épinglage des versions de dépendances (source: Dossier de vérité).

L'avis de Ruben

OpenClaw est un suicide sécuritaire pour n'importe quelle infrastructure sérieuse. Faire confiance à un agent qui gère ses permissions par "prompts" en 2026 revient à laisser les clés de votre serveur sous le paillasson en espérant que le voleur soit poli. Entre la compromission majeure de LiteLLM et l'absence de benchmarks comparatifs face à la couche de gouvernance NemoClaw de NVIDIA, ce framework doit rester cantonné à des environnements de test isolés du réseau.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

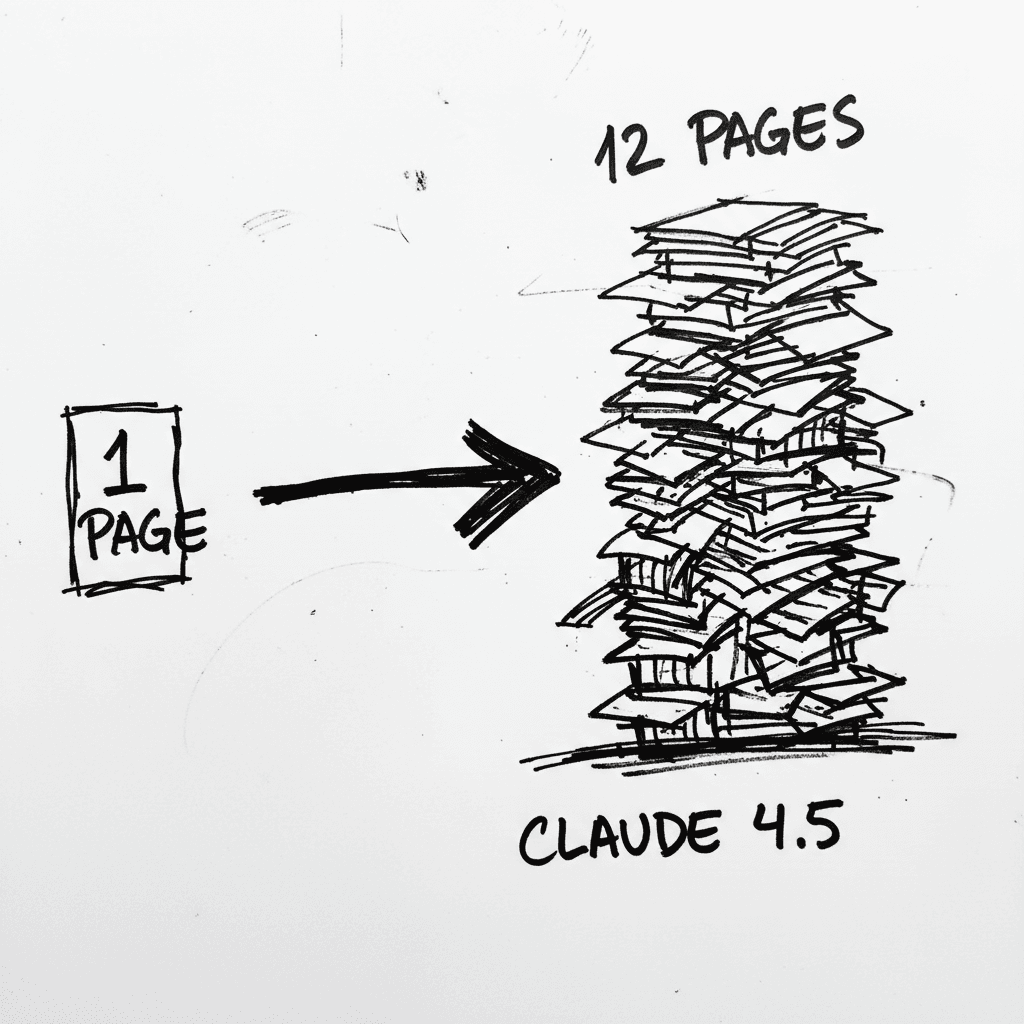

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

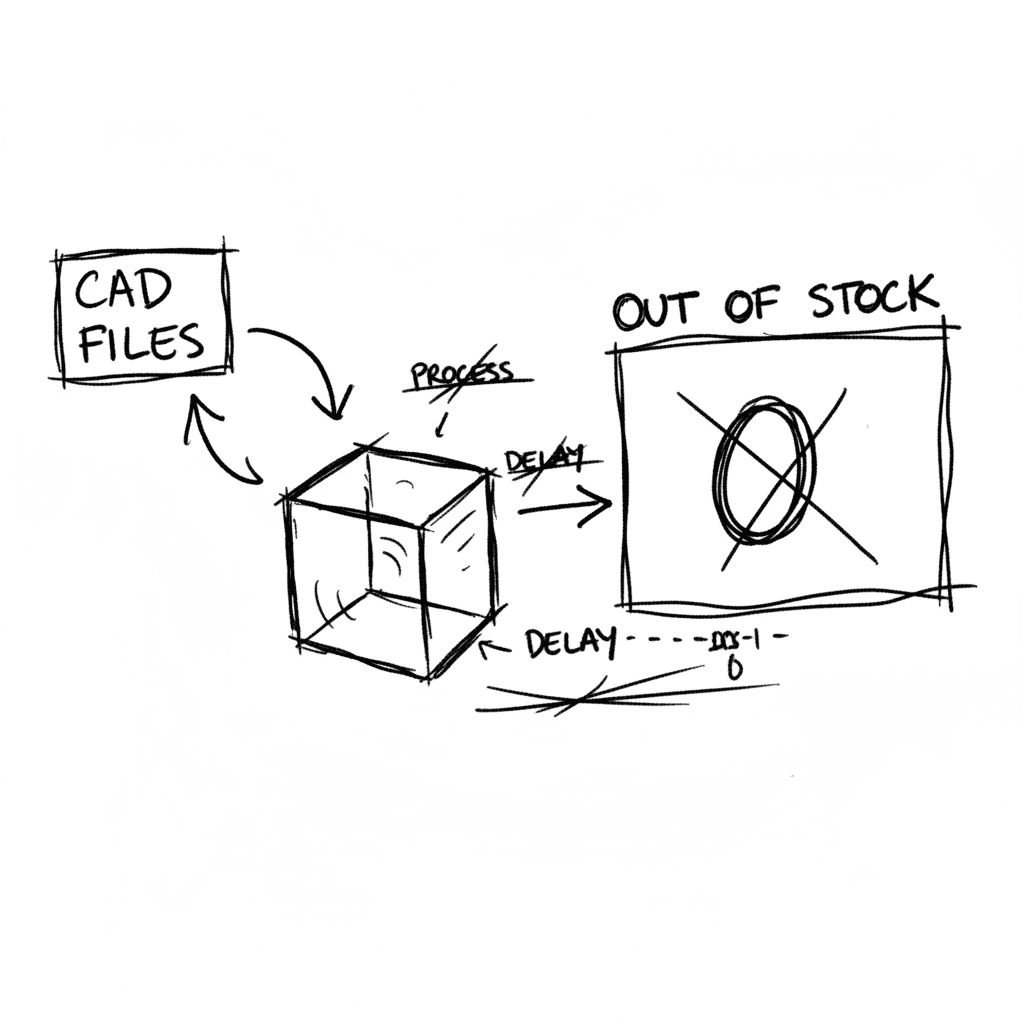

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.