Percepta AI : L'exécution de code C au sein des poids du transformer

Percepta AI prétend transformer l'architecture transformer en machine virtuelle capable d'exécuter du code C arbitraire directement dans les poids du modèle. L'objectif est de supprimer l'appel d'outi

Le Pitch

Percepta AI prétend transformer l'architecture transformer en machine virtuelle capable d'exécuter du code C arbitraire directement dans les poids du modèle. L'objectif est de supprimer l'appel d'outils Python externes pour atteindre une vitesse d'inférence dépassant les 30 000 tokens par seconde sur un simple CPU (source: Percepta.ai Blog).

Sous le capot

L'implémentation technique repose sur une restriction des têtes de lookup à une dimension 2, ce qui permet des opérations de récupération et de mise à jour en temps logarithmique (source: Percepta.ai Blog, March 2026). Cette architecture Transformer-VM vise à résoudre les problèmes de latence d'inférence que l'on observe encore sur les architectures classiques comme Claude 4 Sonnet lors de tâches de calcul intensives.

Les fondateurs, Hirsh et Radha Jain, ex-ingénieurs seniors chez Palantir, ont documenté l'exécution réussie de l'algorithme hongrois et de grilles de Sudoku complexes au sein de leur structure (source: Percepta.ai Blog). Malgré des partenariats stratégiques avec Anthropic et AWS pour le déploiement en entreprise (source: HLTH.com), le projet est freiné par un obstacle de taille.

Palantir a lancé une poursuite judiciaire fédérale contre les fondateurs, alléguant le vol de secrets industriels liés à leur code source (source: Reuters/Investing.com). Cette situation juridique instable refroidit une partie de la communauté sur Hacker News, qui craint que la technologie ne soit jamais librement accessible.

On ne sait pas encore si Transformer-VM sera distribué en open-source ou s'il restera une boîte noire propriétaire. De plus, aucune comparaison directe de performance n'a été publiée face aux traces de raisonnement internes de GPT-5 ou aux capacités de tool-use de Claude 4.5 Opus.

Certains développeurs sur Reddit et HN pointent également un risque de "vaporware" où l'architecture excellerait uniquement sur des traces symboliques spécifiques (source: HN Comments). Les détails techniques sur l'optimisation dite "convex hull", mentionnée dans les discussions préliminaires, demeurent pour l'instant confidentiels.

L'avis de Ruben

On ne touche pas à Percepta AI en production tant que le procès avec Palantir n'est pas réglé. L'approche technique de l'exécution C "in-weight" est brillante pour réduire la latence, mais le risque juridique est trop élevé pour une stack d'entreprise en 2026. Entre la menace d'une injonction et l'absence de benchmarks indépendants face aux ténors comme Claude 4.5 Opus, c'est un projet à surveiller de loin mais à ne surtout pas intégrer dans vos pipelines critiques pour le moment.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

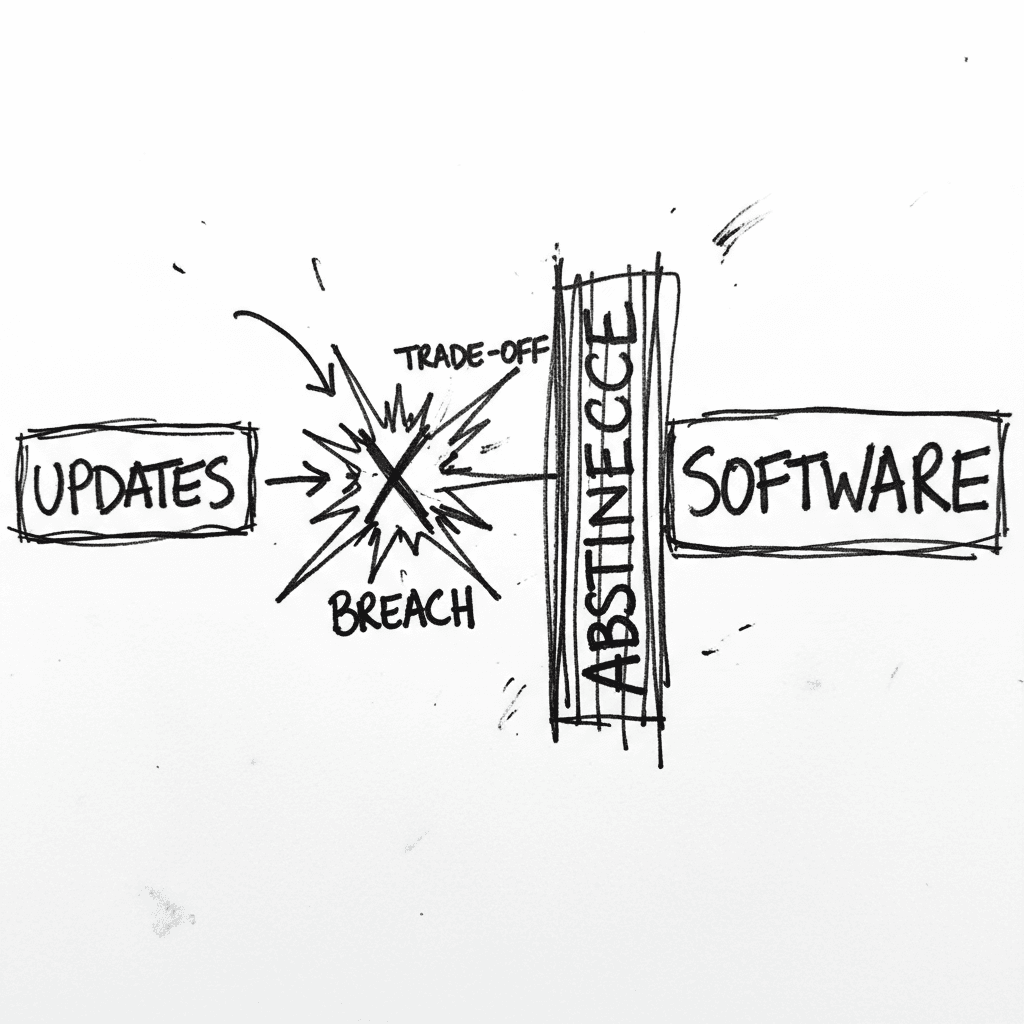

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

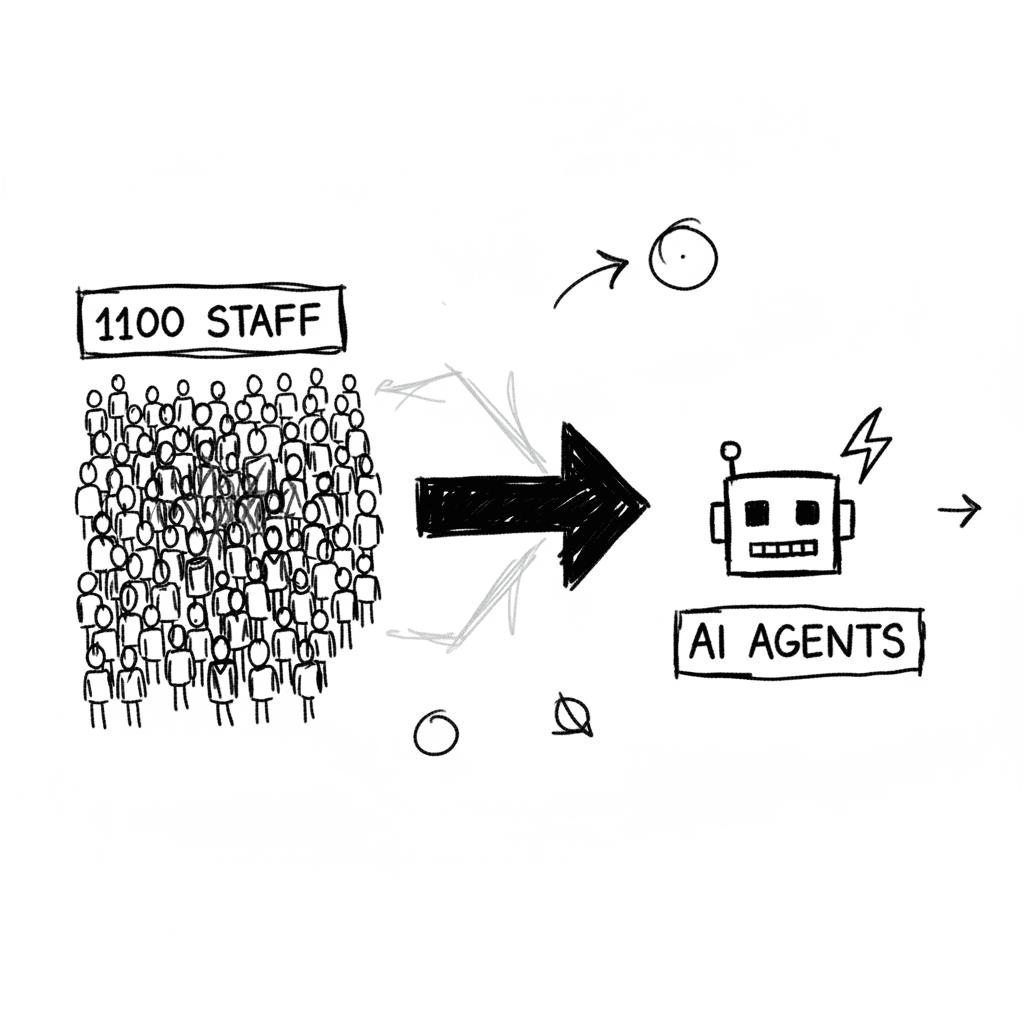

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

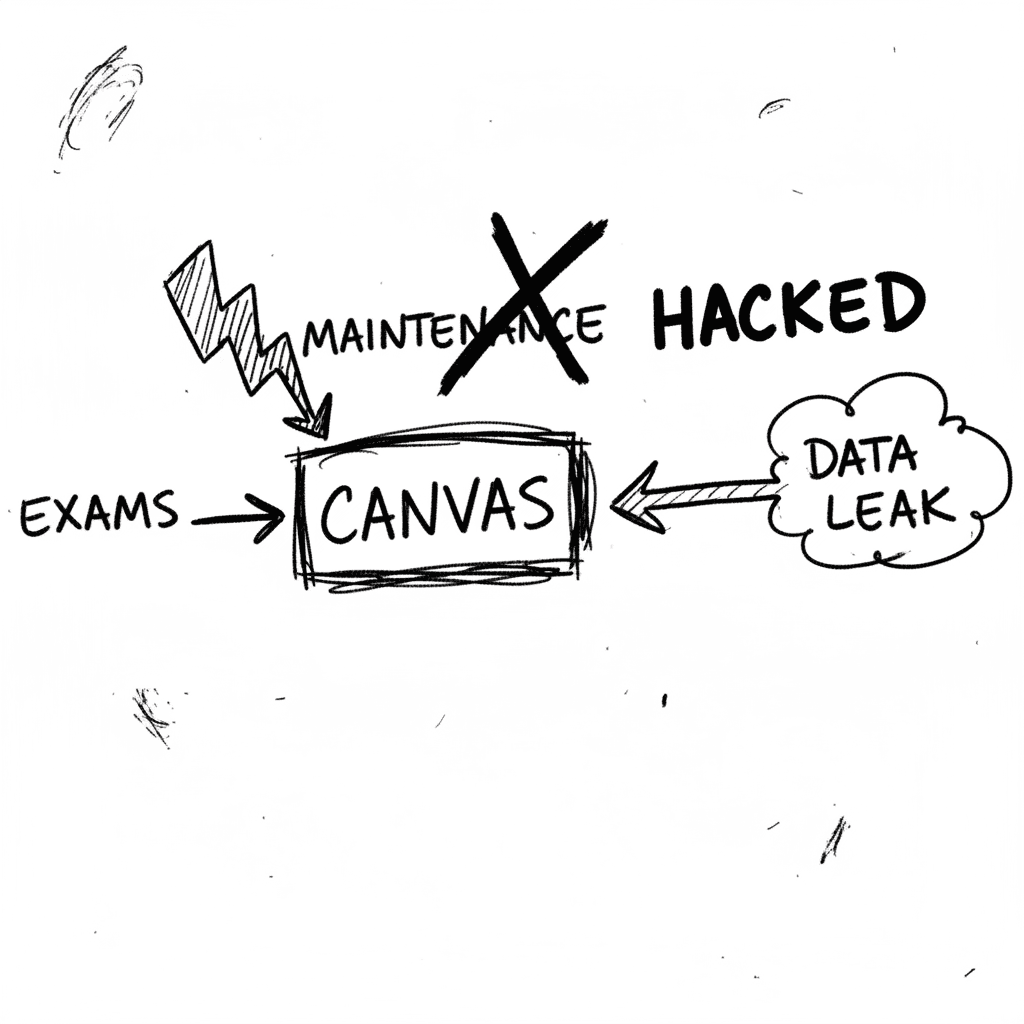

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.