Redox OS : Interdiction totale des contributions générées par LLM

Redox OS vient de mettre à jour sa politique de contribution pour bannir explicitement les issues et Pull Requests générées par IA (GitLab). Cette décision marque un tournant pour les systèmes de haut

Le Pitch

Redox OS vient de mettre à jour sa politique de contribution pour bannir explicitement les issues et Pull Requests générées par IA (GitLab). Cette décision marque un tournant pour les systèmes de haute assurance qui saturent sous le volume de "AI slop" produit par GPT-5 et Claude 4.5 Opus. L'objectif est de restaurer une barrière à l'entrée basée sur l'effort réel pour protéger les mainteneurs du burnout.

Sous le capot

Le 9 mars 2026, le dépôt officiel de Redox OS a modifié son fichier CONTRIBUTING.md pour instaurer une politique "No-LLM" stricte (GitLab, Redox OS Repo). Le projet exige désormais un certificat d'origine garantissant qu'aucune description ou ligne de code ne provient d'un modèle de langage.

Cette mesure n'est pas isolée mais confirme une fracture nette dans l'écosystème system programming. La Zig Software Foundation a déjà migré ses dépôts vers Codeberg fin 2025 pour fuir l'intégration agressive de l'IA sur GitHub (Techzine Global, Dec 2025). Mitchell Hashimoto a suivi une ligne similaire avec Ghostty en janvier 2026 pour rétablir une "pression inverse basée sur l'effort" (Dev Genius, Feb 2026).

Le coût de la revue humaine devient insoutenable face à l'asymétrie de production de l'IA. Daniel Stenberg a révélé que 95 % des rapports de sécurité générés par IA sur cURL en 2025 étaient des hallucinations pures (Shartech Blog, Feb 2026). Pour un microkernel comme Redox, où la sûreté mémoire et la précision sont critiques, le risque d'introduire des vulnérabilités subtiles mais prévisibles via du code généré est jugé trop élevé (OSSRA Report 2026).

Le problème majeur reste l'application de cette règle. Si bannir du contenu mal tagué est simple, détecter des soumissions "sous-marines" provenant de Claude 4.5 Opus est techniquement impossible sans outils de détection dédiés, dont l'existence même reste à prouver chez Redox (Dossier UsedBy). Le risque collatéral est une contraction de la base de contributeurs, certains développeurs légitimes utilisant l'IA pour le boilerplate ou la documentation.

L'avis de Ruben

C'est une décision brutale mais indispensable pour la survie du développement système sérieux. Laisser GPT-5 ou Gemini 2.5 polluer les backlogs de projets aussi pointus que Redox, c'est accepter que le bruit noie définitivement le signal. On ne construit pas un microkernel en Rust avec des "vibe-checks" et du code statistique. Si vous n'êtes pas capables d'écrire votre propre description de PR, vous n'avez rien à faire dans le kernel space. C'est une mesure d'hygiène technique que je conseille d'adopter pour tout projet où la dette technique n'est pas une option.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

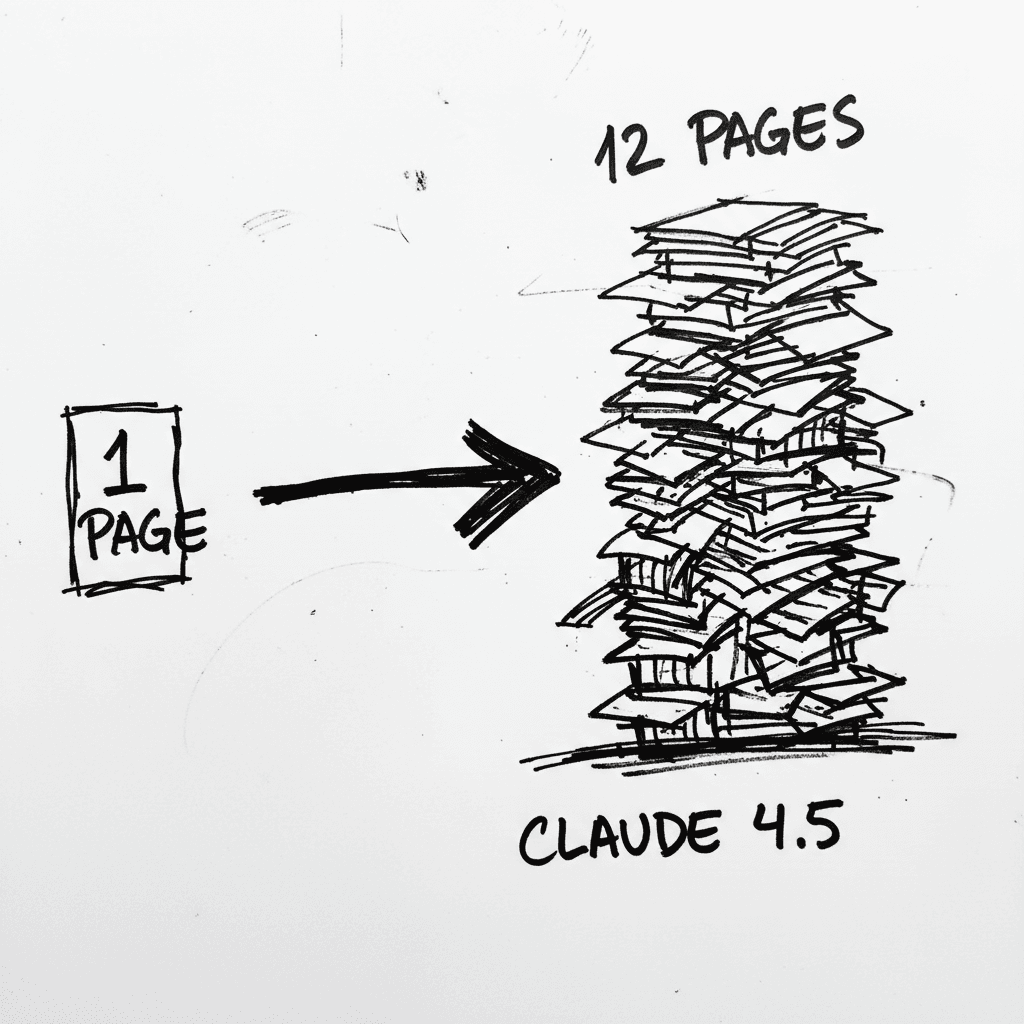

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

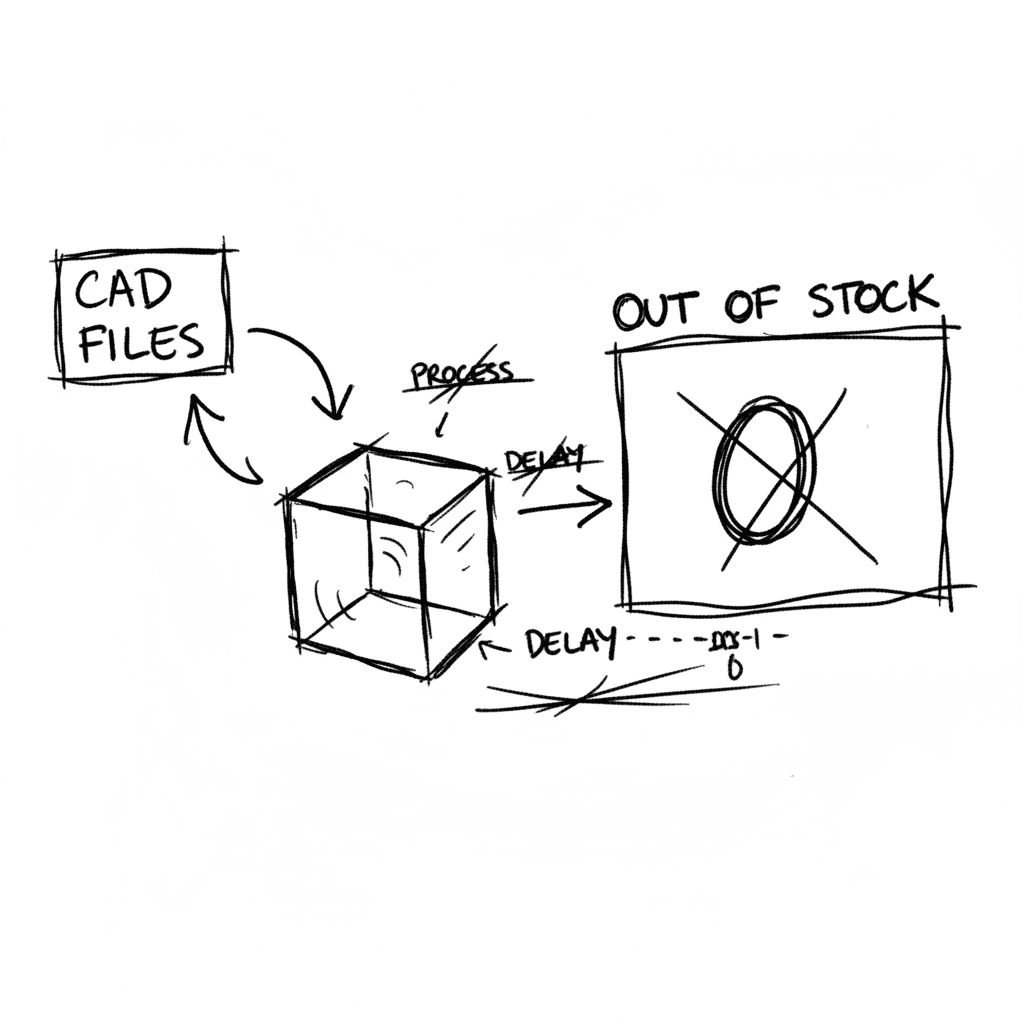

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.