Talkie-LM: Un modelo de 13B entrenado con datos anteriores a 1931

Talkie-LM (Talkie-1930-13b) es un modelo de lenguaje de 13 mil millones de parámetros diseñado como una cápsula del tiempo técnica, entrenado exclusivamente con 260B de tokens de texto previo a 1931 (

El Pitch

Talkie-LM (Talkie-1930-13b) es un modelo de lenguaje de 13 mil millones de parámetros diseñado como una cápsula del tiempo técnica, entrenado exclusivamente con 260B de tokens de texto previo a 1931 (fuente: Dossier UsedBy). Investigadores de primer nivel como Alec Radford y David Duvenaud buscan con este proyecto evaluar la generalización de la IA sin la contaminación de datos sintéticos producidos por modelos modernos (GitHub).

Bajo el capó

El modelo se distribuye bajo licencia Apache-2.0 y utiliza un dataset masivo que incluye diarios, enciclopedias y manuales de etiqueta de principios del siglo XX (Simon Willison's Weblog, April 2026). Para correr Talkie-LM en local bajo bfloat16, vas a necesitar una GPU con al menos 28 GB de VRAM, lo que descarta el hardware doméstico de gama media en este 2026 (GitHub Repo). Los autores incluyeron Talkie-web-13b-base, un modelo de control entrenado con FineWeb, para facilitar benchmarks sobre efectos temporales en la inferencia (Official GitHub README).

El rendimiento actual es errático y muestra problemas graves de estabilidad en la inferencia. Varios usuarios reportan que el modelo corta las respuestas a mitad de palabra en la demo web actual (fuente: HN). Además, aunque el entrenamiento se detiene teóricamente en 1930, el modelo ignora eventos críticos como el crack de 1929, lo que sugiere un sesgo hacia la producción literaria de las dos primeras décadas del siglo (Dossier UsedBy).

Existe un conflicto de anacronismo técnico en el ajuste de instrucciones. Al usar jueces de LLM modernos para el fine-tuning, el modelo tiende a generar respuestas en formatos actuales como listicles, rompiendo la inmersión histórica (Research Report). En términos de precisión científica, Talkie-LM es un peligro: define conceptos como la Ley de Ohm de forma incorrecta pero coherente con los mitos científicos de la época (Hacker News). Aún no sabemos la arquitectura exacta ni tenemos acceso al dataset completo por restricciones de curación (Simon Willison).

La opinión de Ruben

Talkie-LM no sirve para producir código ni para asistir en tareas de ingeniería. Es un artefacto de investigación puro que demuestra lo difícil que es escapar del sesgo de los modelos actuales durante el fine-tuning. Si buscas una herramienta de productividad, sigue con los modelos comerciales de vanguardia; si eres un investigador de seguridad o alineación intentando entender cómo razona una IA sin influencia de internet moderno, instálalo. Fuera de ese nicho, es poco más que un juguete costoso en términos de cómputo que se rompe a mitad de frase.

Código limpio siempre,

Ruben.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

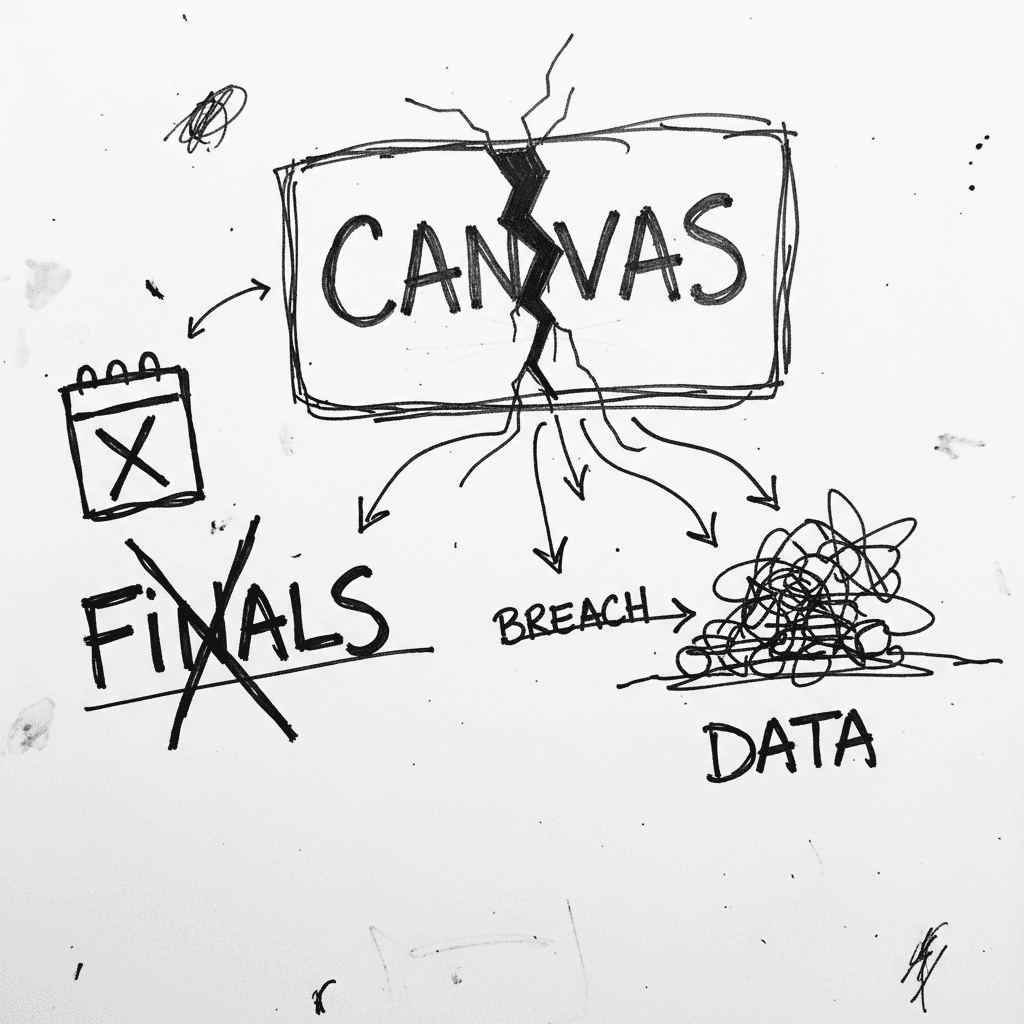

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.