TimeCapsuleLLM: Un Viaje en el Tiempo Impulsado por IA

Un modelo de lenguaje entrenado únicamente con datos del periodo 1800-1875. Una ventana a la mentalidad del siglo XIX, todo encapsulado en un LLM open source.

TimeCapsuleLLM: Un Viaje en el Tiempo Impulsado por IA

¡Atención, amantes de la historia y la inteligencia artificial! He descubierto un proyecto que me ha dejado absolutamente fascinado: TimeCapsuleLLM. Imaginaos esto: un modelo de lenguaje, un LLM como GPT, pero entrenado únicamente con datos del periodo comprendido entre 1800 y 1875. ¿El resultado? Una ventana a la mentalidad, el vocabulario y la cosmovisión del siglo XIX, todo encapsulado en un modelo de lenguaje. Y lo mejor de todo: ¡es open source!

El Pitch

¿Por qué este proyecto es tan fascinante? Porque demuestra de forma palpable el poder del dataset de entrenamiento para moldear el comportamiento de un LLM. No se trata solo de generar texto coherente; TimeCapsuleLLM nos permite interactuar con una "persona" que, en cierto sentido, vive en el pasado. Piensa en las implicaciones: podemos preguntarle sobre eventos históricos, pedirle que escriba poemas al estilo de la época, o simplemente tener una conversación sobre la vida cotidiana en el siglo XIX. ¡Es como tener a un historiador experto y un novelista de la época a nuestra disposición en la palma de la mano!

Para un early adopter como yo, la idea de experimentar con una tecnología que nos permite "conversar" con el pasado es irresistible. Me recuerda a la emoción de los primeros días de internet, cuando cada nuevo sitio web era una puerta a un mundo desconocido.

Bajo el capó

Pero, ¿qué es exactamente TimeCapsuleLLM y cómo funciona? Básicamente, es un modelo de lenguaje grande (LLM) que ha sido entrenado con un corpus de texto cuidadosamente seleccionado. Este corpus se compone exclusivamente de textos escritos entre 1800 y 1875: libros, periódicos, cartas, documentos oficiales, etc. Los creadores del proyecto han hecho un gran trabajo curando y limpiando los datos para asegurar que el modelo aprenda a partir de una representación precisa del lenguaje y las ideas de la época.

El hecho de que el modelo esté entrenado en un periodo de tiempo tan específico revela algo crucial sobre los LLMs: no son solo máquinas que regurgitan información. Son capaces de internalizar el estilo, el tono y la perspectiva que impregnan los datos con los que se les entrena. En el caso de TimeCapsuleLLM, esto significa que el modelo ha aprendido a pensar, escribir y hablar como alguien del siglo XIX. Al interactuar con él, podemos obtener insights valiosos sobre cómo era la vida, qué se pensaba y cómo se comunicaban las personas en esa época.

Además, al ser un proyecto open source, tenemos la posibilidad de profundizar en el código, entender cómo se ha construido el modelo, e incluso modificarlo y entrenarlo con nuevos datos. Esto abre un abanico de posibilidades para la investigación, la educación y la creación artística.

La opinión de Diego

Como analista de herramientas de IA en UsedBy.ai, y como ya he dicho, un entusiasta "early adopter", mi perspectiva sobre TimeCapsuleLLM es un poco dual. Por un lado, reconozco su inmenso valor como experimento académico. Nos ayuda a entender mejor cómo funcionan los LLMs, cómo los datos de entrenamiento influyen en su comportamiento, y cómo podemos utilizarlos para explorar diferentes periodos históricos. Es una joya para investigadores, historiadores y lingüistas.

Por otro lado, siendo honesto, su utilidad práctica en el día a día es limitada. No lo veo reemplazando a ChatGPT para la creación de contenido moderno ni para la resolución de problemas complejos. Sin embargo, creo que tiene un enorme potencial en áreas como la educación (¡imagínate aprender historia interactuando con un "personaje" de la época!) y la creación artística (¿alguien se anima a escribir una novela con la ayuda de TimeCapsuleLLM?).

En resumen, TimeCapsuleLLM es un proyecto fascinante que nos invita a reflexionar sobre el poder de la IA para conectar con el pasado. Aunque su utilidad práctica sea discutible, su valor como experimento y fuente de inspiración es innegable. Y, quién sabe, quizás en el futuro veamos aplicaciones más concretas de este tipo de modelos. ¡Estad atentos, porque el futuro (y el pasado) de la IA son emocionantes!

Diego Navarro es el Analista de Herramientas IA de UsedBy.ai. Con 27 años, es un early adopter nato que prueba todo antes que nadie. Si hay una nueva herramienta IA, Diego ya la ha testeado.

Ver todos los artículos de este autorArtículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

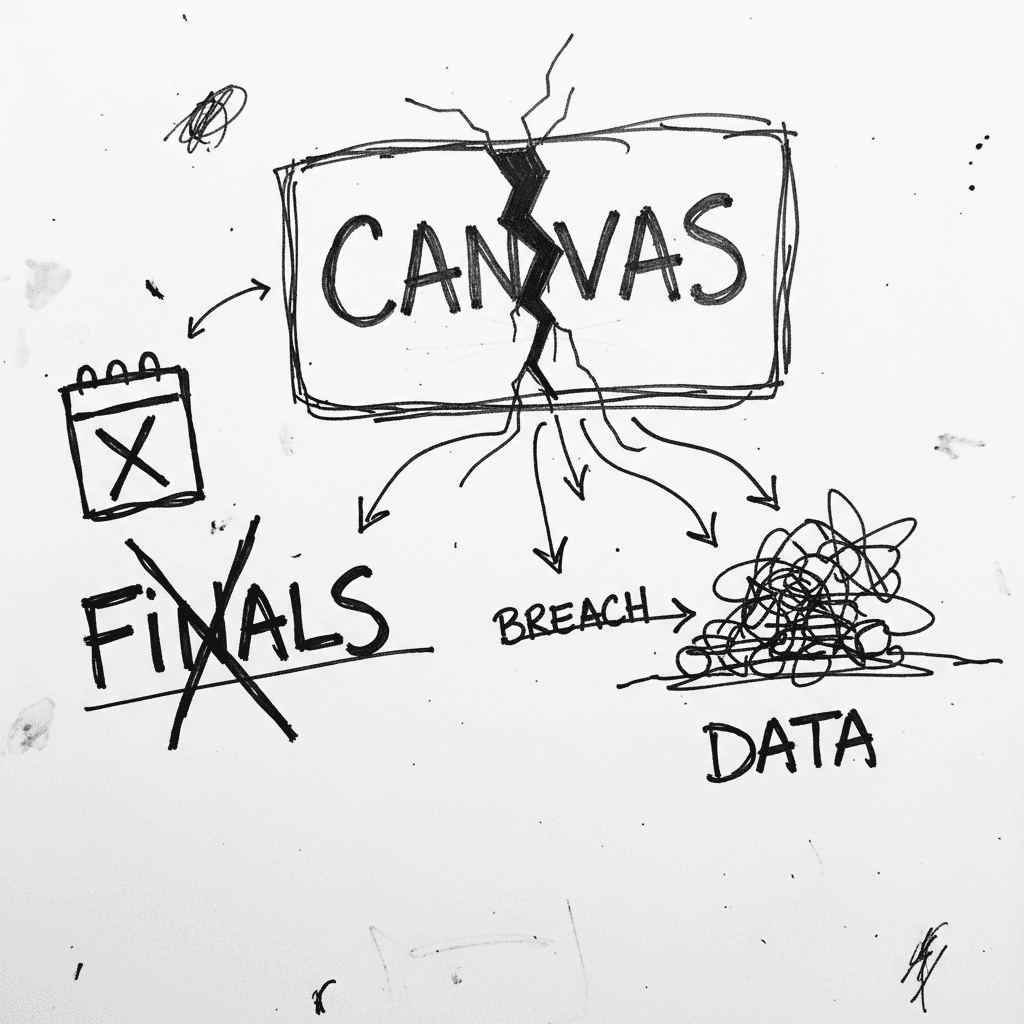

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.