Voxtral Mini 4B: Implementación Rust y WebGPU para transcripción local

La comunidad de código abierto acaba de portar el modelo Voxtral Mini 4B de Mistral a la web utilizando el framework Burn y WebGPU. Este repositorio permite ejecutar transcripción de audio nativa en e

El Pitch

La comunidad de código abierto acaba de portar el modelo Voxtral Mini 4B de Mistral a la web utilizando el framework Burn y WebGPU. Este repositorio permite ejecutar transcripción de audio nativa en el navegador con una latencia de inferencia inferior a los 200ms (fuente: GitHub - TrevorS). Es el primer intento serio de eliminar la dependencia de APIs externas para servicios de voz en tiempo real usando estándares web modernos.

Bajo el capó

El modelo se basa en la familia Voxtral Transcribe 2 lanzada por Mistral AI hace apenas una semana (fuente: Mistral AI Announcement). La arquitectura utiliza un diseño de sliding window attention con un modelo de lenguaje de 3.4B parámetros y un codificador de audio causal de 0.6B (fuente: GitHub - TrevorS). Los pesos están disponibles bajo licencia Apache 2.0 en Hugging Face, lo que ha facilitado integraciones rápidas en diversos ecosistemas.

La implementación técnica en Rust es sólida, pero el despliegue en el navegador enfrenta un obstáculo logístico: una descarga obligatoria de 2.5GB en shards GGUF cuantizados (fuente: HN). Aunque WebGPU permite una aceleración por hardware directa, la estabilidad varía significativamente entre dispositivos y navegadores, y la inferencia en BF16 nativo sigue exigiendo un mínimo de 16GB de VRAM para funcionar con fluidez (fuente: Reddit).

Existen problemas conocidos de cuantización en la versión Q4_0 que TrevorS ha tenido que mitigar mediante workarounds manuales. El modelo es extremadamente sensible al inicio del audio; si no se incluyen al menos 76 tokens de silencio artificial como padding, la transcripción falla por completo (fuente: GitHub Issue/README). A nivel de soporte, el sistema maneja 13 idiomas, incluyendo inglés, francés y chino, con una precisión aceptable para ser un modelo de este tamaño (fuente: MarkTechPost).

Todavía no disponemos de benchmarks independientes sobre el Word Error Rate (WER) comparando específicamente la versión WASM frente al modelo BF16 original (Dossier UsedBy). Tampoco hay datos claros sobre el impacto térmico o el drenaje de batería en dispositivos móviles, ya que las pruebas actuales se han centrado casi exclusivamente en entornos de escritorio (Dossier UsedBy). Salvatore Sanfilippo ya ha lanzado una versión en C puro con soporte para Metal, lo que sugiere que la optimización móvil será el siguiente paso lógico (fuente: GitHub - antirez).

La opinión de Diego

No metas esto en una aplicación B2C orientada al gran público todavía; pedirle a un usuario que descargue 2.5GB para "empezar a hablar" es el equivalente técnico a pegarse un tiro en el pie en términos de conversión. Sin embargo, para herramientas de uso interno, paneles de accesibilidad o aplicaciones de escritorio construidas con tecnologías web, Voxtral Mini 4B es la mejor opción que tenemos en febrero de 2026. Es hardware local, es privado y es lo suficientemente rápido como para no romper el flujo de una conversación, siempre y cuando tu GPU tenga los gigas necesarios para no toser con el modelo cargado.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

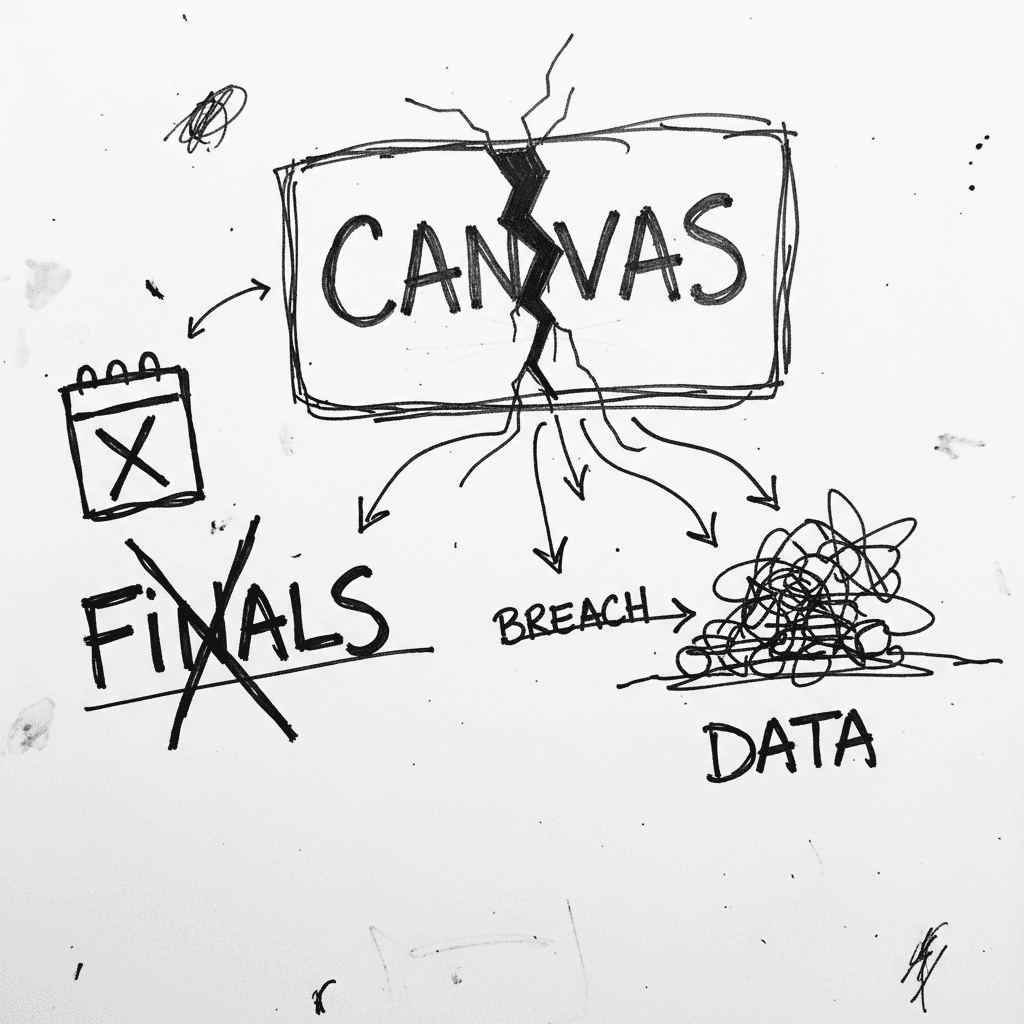

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.