ChatGPT Images 2.0 : performances du mode Thinking et inflation des coûts

OpenAI a déployé hier son nouveau modèle natif gpt-image-2, marquant l'intégration d'un mode "Thinking" pour le raisonnement visuel multi-étapes. Le modèle domine les benchmarks avec un rendu de texte

Le Pitch

OpenAI a déployé hier son nouveau modèle natif gpt-image-2, marquant l'intégration d'un mode "Thinking" pour le raisonnement visuel multi-étapes. Le modèle domine les benchmarks avec un rendu de texte quasi parfait, mais impose une structure de coût qui double la facture par rapport à la génération précédente.

Sous le capot

Le modèle gpt-image-2 supporte désormais nativement la résolution 2K avec un upscaling 4K garantissant une continuité de style et de personnage (source: fal.ai/The New Stack). Cette précision technique permet d'atteindre un taux d'exactitude de 99 % sur le rendu de texte, incluant des scripts complexes comme le hindi, le bengali ou le japonais (source: Times of India).

En termes de performance brute, le modèle trône à la première place du classement LM Arena Image avec une avance de +242 points Elo sur son concurrent direct (source: Latent Space). OpenAI compare ce saut qualitatif à la progression réalisée entre GPT-3 et GPT-5 en matière de raisonnement pur (source: VentureBeat).

Cependant, l'inférence en haute résolution consomme plus de 13 000 tokens de sortie, ce qui fixe le prix à environ 0,40 $ par image (source: Simon Willison). C'est une augmentation de 100 % par rapport au modèle 1.5, rendant l'outil prohibitif pour les pipelines de génération de masse.

Malgré le mode "Thinking", la cohérence visuelle s'effondre encore sur des tâches logiques denses comme les grilles 8x8 ou les scènes de type "Où est Charlie" (source: Dossier UsedBy). Les retours de la communauté soulignent également un effet "uncanny valley" marqué sur les rendus d'humains en mouvement (source: HN).

Enfin, on ne sait pas encore quel est l'impact énergétique réel de ce mode de réflexion prolongée. OpenAI n'a fourni aucune précision sur les accords de licence de données utilisés pour l'entraînement de cette version 2026, alimentant les critiques sur l'absence de compensation pour les artistes (source: HN).

L'avis de Ruben

Le gpt-image-2 est un outil chirurgical destiné aux assets marketing finaux, pas un terrain de jeu pour itérations rapides. À 0,40 $ le prompt, le mode "Thinking" doit être réservé aux compositions exigeant une précision textuelle absolue ou une gestion de scripts non latins. Pour la majorité des besoins UI/UX ou de prototypage, le rapport coût/bénéfice n'est pas encore là. C'est une prouesse technique qui valide l'approche du raisonnement visuel, mais qui reste économiquement indigeste pour une intégration scale en prod.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

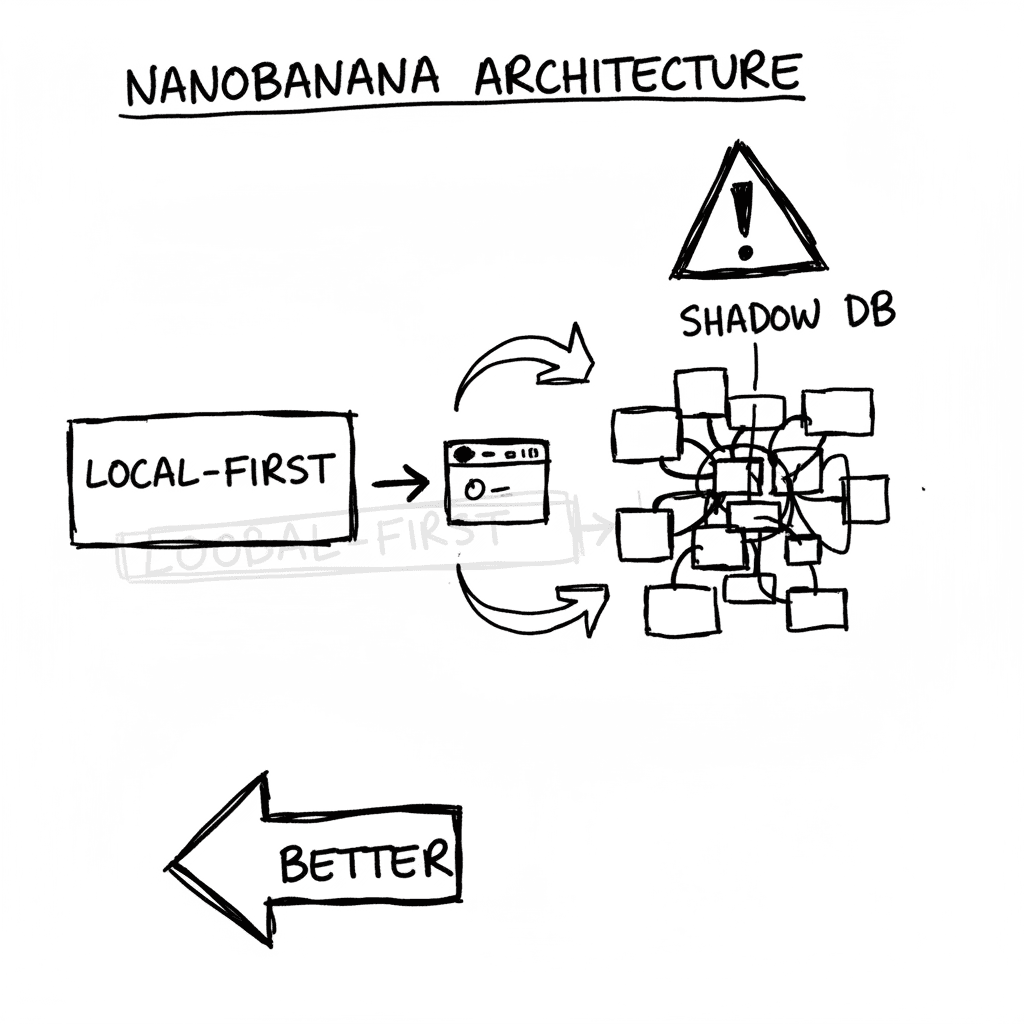

SQLite 3.53.1 : Standard de persévérance et architecture Edge

SQLite est devenu en 2026 le format de stockage universel recommandé par la Library of Congress pour la conservation de données à long terme (source: loc.gov). Loin d'être un simple utilitaire, il s'e

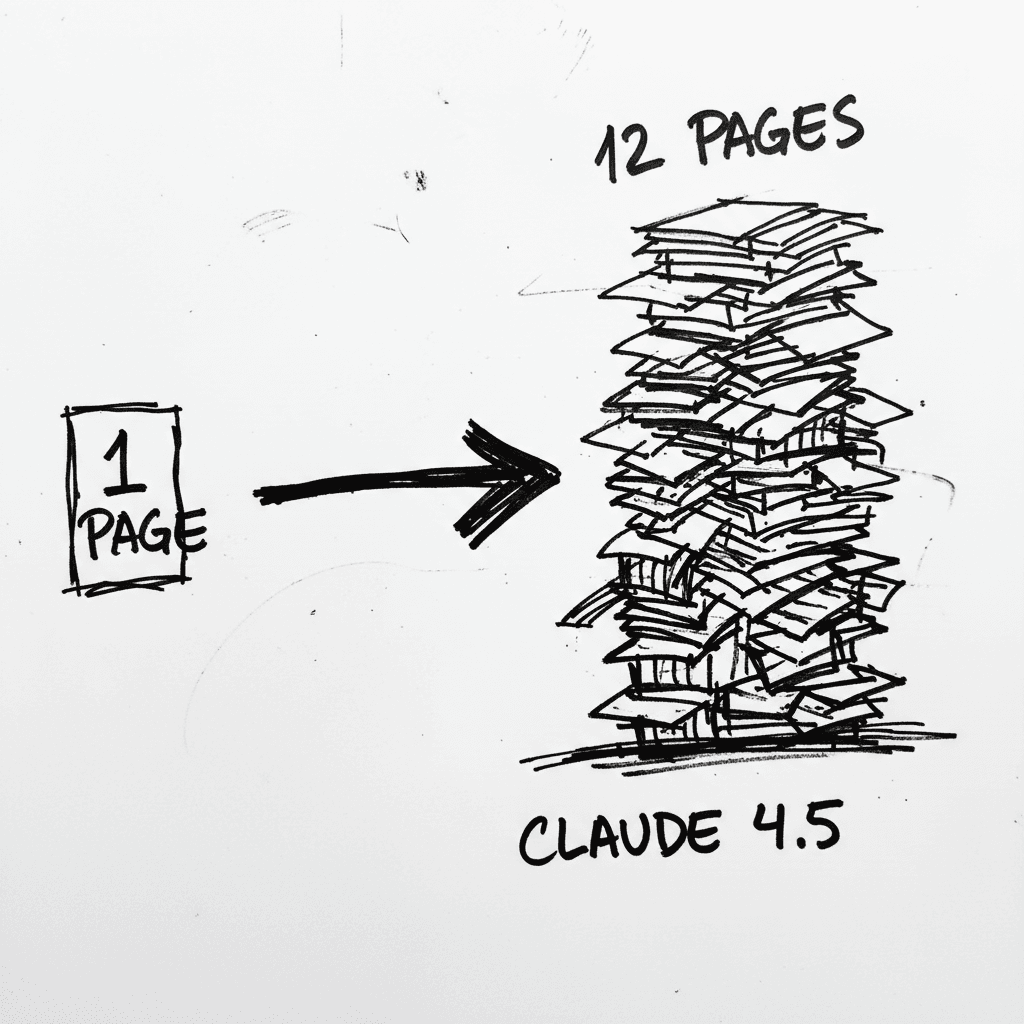

Anthropic Claude 4.5 Opus : l'élongation documentaire comme indicateur de productivité

Le déploiement de Claude 4.5 Opus en entreprise a validé sa capacité à générer des artifacts professionnels sophistiqués (Dossier UsedBy). Les intégrations majeures chez Quora et Notion confirment que

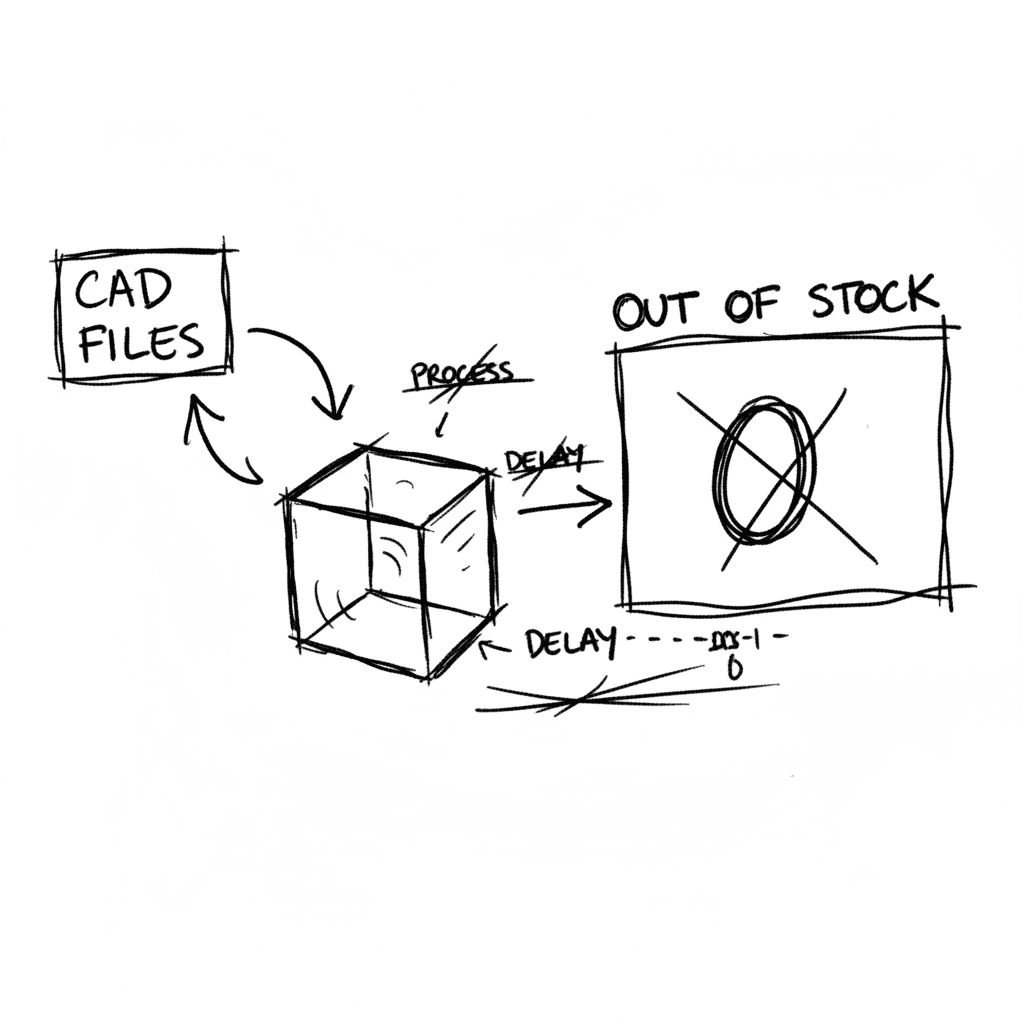

Valve Steam Controller 2026 : Ouverture des fichiers CAO et rupture de stock immédiate

Valve a libéré les fichiers CAO (STP, STL) de la coque externe du nouveau Steam Controller et de son "Puck" magnétique sous licence Creative Commons BY-NC-SA 4.0 (Source: Valve Official Announcement).

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.