Consistency Diffusion Language Models: Inferencia acelerada mediante destilación de pasos

CDLM reduce el refinamiento multietapa de los modelos de difusión de texto a solo uno o dos pasos, eliminando el cuello de botella tradicional de esta arquitectura (arXiv:2511.19269). Promete acelerac

El Pitch

CDLM reduce el refinamiento multietapa de los modelos de difusión de texto a solo uno o dos pasos, eliminando el cuello de botella tradicional de esta arquitectura (arXiv:2511.19269). Promete aceleraciones de hasta 14.5x manteniendo la precisión, posicionándose como una alternativa viable a los modelos autorregresivos en tareas de alta computación (fuente: Together AI Blog).

Bajo el capó

La clave técnica de CDLM es la implementación de una máscara de atención causal por bloques, lo que permite por primera vez un KV caching exacto en modelos de difusión (SqueezeAILab GitHub). En el benchmark de código MBPP, la reducción de latencia alcanza un factor de 14.5x, mientras que en tareas matemáticas como GSM8K se sitúa en 11.2x (fuente: Together AI).

Actualmente, el ecosistema ya cuenta con implementaciones open-source. Los pesos para CDLM-Dream y CDLM-LLaDA están disponibles en Hugging Face, permitiendo su despliegue en entornos controlados (minseo25/Hugging Face). El método logra reducir los pasos de refinamiento entre 4.1x y 7.7x sin degradar la exactitud de la respuesta (fuente: MEXC News).

Sin embargo, CDLM tiene un techo de inteligencia predefinido. Al ser una receta de post-training, sus capacidades de razonamiento están limitadas por el modelo "maestro" utilizado; no esperes que supere la lógica de un Claude 4.5 o un GPT-5 en tareas generales (arXiv:2511.19269). Además, herramientas de inferencia local como Ollama o LM Studio aún no ofrecen soporte nativo para esta arquitectura, lo que complica su adopción inmediata para el dev promedio (fuente: HN).

Aún no sabemos cómo escala su estabilidad en ventanas de contexto que superen los 128k tokens (Dossier UsedBy). Tampoco existen benchmarks públicos que comparen su rendimiento directamente contra el modo "Thinking" de GPT-5, que gestiona el razonamiento de forma adaptativa.

La opinión de Diego

CDLM es una pieza de ingeniería brillante para casos de uso específicos, pero no va a desplazar a Claude 4.5 de tu flujo de trabajo diario todavía. Si estás construyendo herramientas de autocompletado de código o calculadoras lógicas donde controlas el entorno de ejecución, la ganancia en latencia justifica el esfuerzo de configuración. Para el resto de aplicaciones conversacionales, la fricción del despliegue y la falta de integración en los runners locales lo convierten en un experimento interesante para un side-project de fin de semana, pero nada más. Yo no movería mis flujos de producción a CDLM hasta que no vea una integración nativa que no me obligue a pelearme con dependencias manuales durante horas; mi paciencia en 2026 tiene un límite claro.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

CVE-2026-31431 y la propuesta de moratorio de instalación de Xe Iaso

La vulnerabilidad Copy Fail ha invalidado el modelo de confianza en la cadena de suministro de software de Linux en mayo de 2026. Xe Iaso propone un moratorio inmediato en la instalación de cualquier

Cloudflare y la reestructuración por eficiencia en agentes de IA

Cloudflare ha ejecutado un pivot hacia un modelo operativo "agentic AI-first" tras registrar un aumento del 600% en la eficiencia de sus agentes internos. La compañía busca automatizar la gestión de s

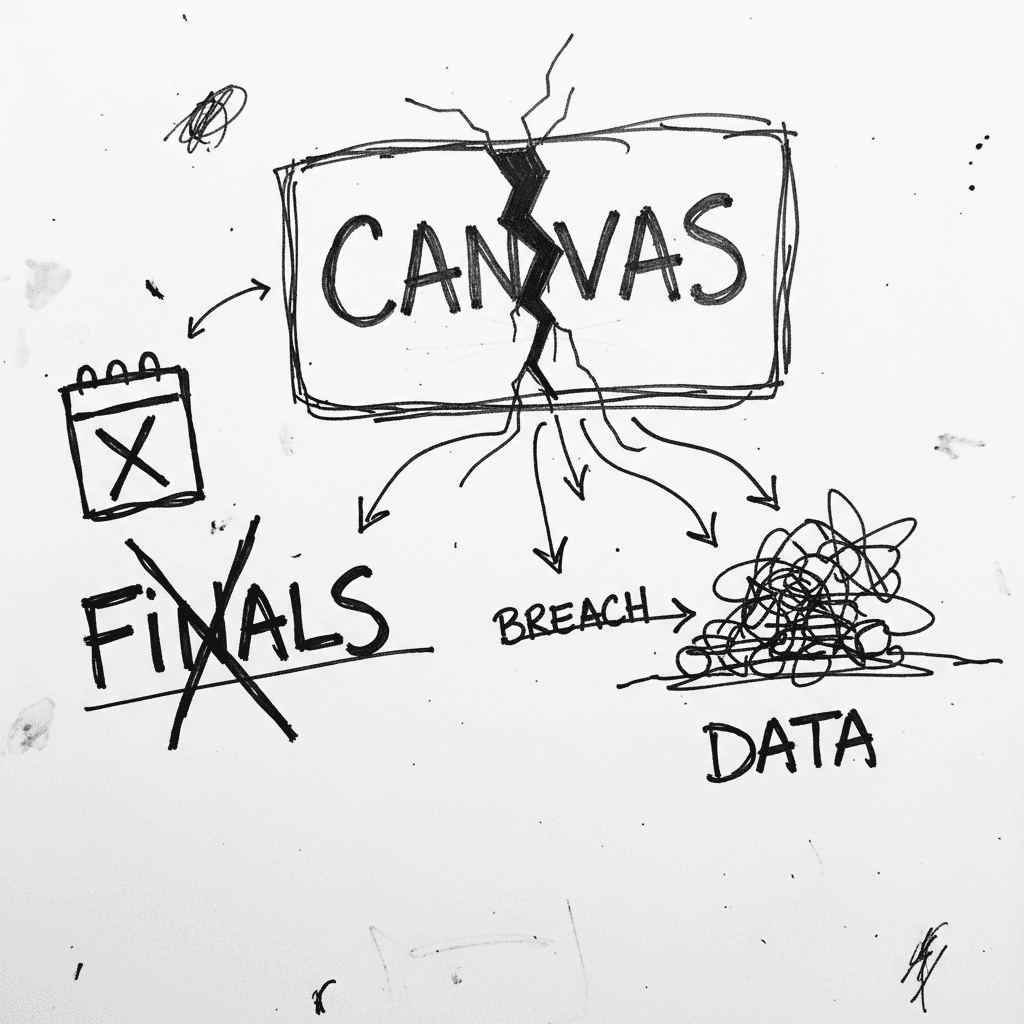

Canvas sufre brecha masiva de 3.65 TB y caída global de servicios

Canvas es el sistema de gestión de aprendizaje (LMS) de Instructure que centraliza la educación de 30 millones de usuarios bajo un modelo SaaS multi-tenant. En Hacker News, el debate se centra en la f

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.