Le Car Wash Logic Trap : l'échec du raisonnement spatial chez GPT-5.2

Le benchmark informel "Car Wash Logic Trap" met en lumière une faille critique dans la cohérence des modèles de raisonnement de pointe en ce début d'année 2026. Alors que GPT-5.2 et Claude 4.5 Opus s'

Le Pitch

Le benchmark informel "Car Wash Logic Trap" met en lumière une faille critique dans la cohérence des modèles de raisonnement de pointe en ce début d'année 2026. Alors que GPT-5.2 et Claude 4.5 Opus s'affrontent sur le terrain du "Deep Thinking", une simple question de logistique physique révèle que la puissance de calcul ne garantit pas le bon sens. Le test est simple : vous devez laver votre voiture dans une station située à 50 mètres, mais l'IA vous conseille d'y aller à pied.

Sous le capot

Le cœur du problème réside dans le "logic drift", un phénomène où la chaîne de réflexion interne du modèle se déconnecte de sa conclusion finale. Claude 4.5 Opus et sa version Sonnet valident le test systématiquement en soulignant l'ironie de la distance, mais en confirmant que la présence du véhicule est la priorité absolue (Source: HN 116072773118828295). Ils maintiennent une cohérence entre l'objectif (laver la voiture) et l'action (conduire).

Gemini 3 Pro s'en sort également grâce à son architecture "Spatial Understanding" déployée par Google en novembre dernier (Source: DeepMind Blog). Cette couche technique permet au modèle de déduire que marcher 50 mètres rend l'objectif initial de lavage impossible, une capacité de raisonnement spatial qui semble désormais intégrée nativement chez DeepMind.

À l'inverse, GPT-5.2 Pro présente un mode d'échec spécifique documenté ce matin même (Source: Reddit r/OpenAI, 16 fév. 2026). Dans ses traces de "Thinking" en haute inference, le modèle identifie correctement que la voiture doit être lavée. Pourtant, sa réponse finale ignore cette déduction au profit d'heuristiques statistiques liées à la santé ou à l'écologie : "50 mètres est une distance de marche idéale".

Ce comportement montre que les modèles o-series d'OpenAI souffrent d'un surpoids accordé aux priors statistiques sur la distance au détriment de la logique agentique. Pour contourner ce biais, il faut actuellement forcer le modèle via un "riddle framing" ou des prompts incitant à une réflexion prolongée (Source: LocalLLaMA 2026 Reports). On ne sait pas encore pourquoi le RLHF d'OpenAI sur-pondère ces comportements par rapport à l'approche d'Anthropic.

L'avis de Ruben

On ne déploie pas GPT-5.2 sur des workflows agentiques complexes impliquant de la logistique physique sans un garde-fou strict. Ce benchmark prouve que malgré des scores records sur MMLU-v3, la couche de "Reasoning" d'OpenAI peut halluciner une recommandation "safe" (marcher pour la santé) qui contredit l'objectif métier. Pour vos automatisations nécessitant du bon sens spatial, restez sur Claude 4.5 Opus. C'est moins bavard, mais ça comprend qu'une voiture ne se lave pas à distance.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

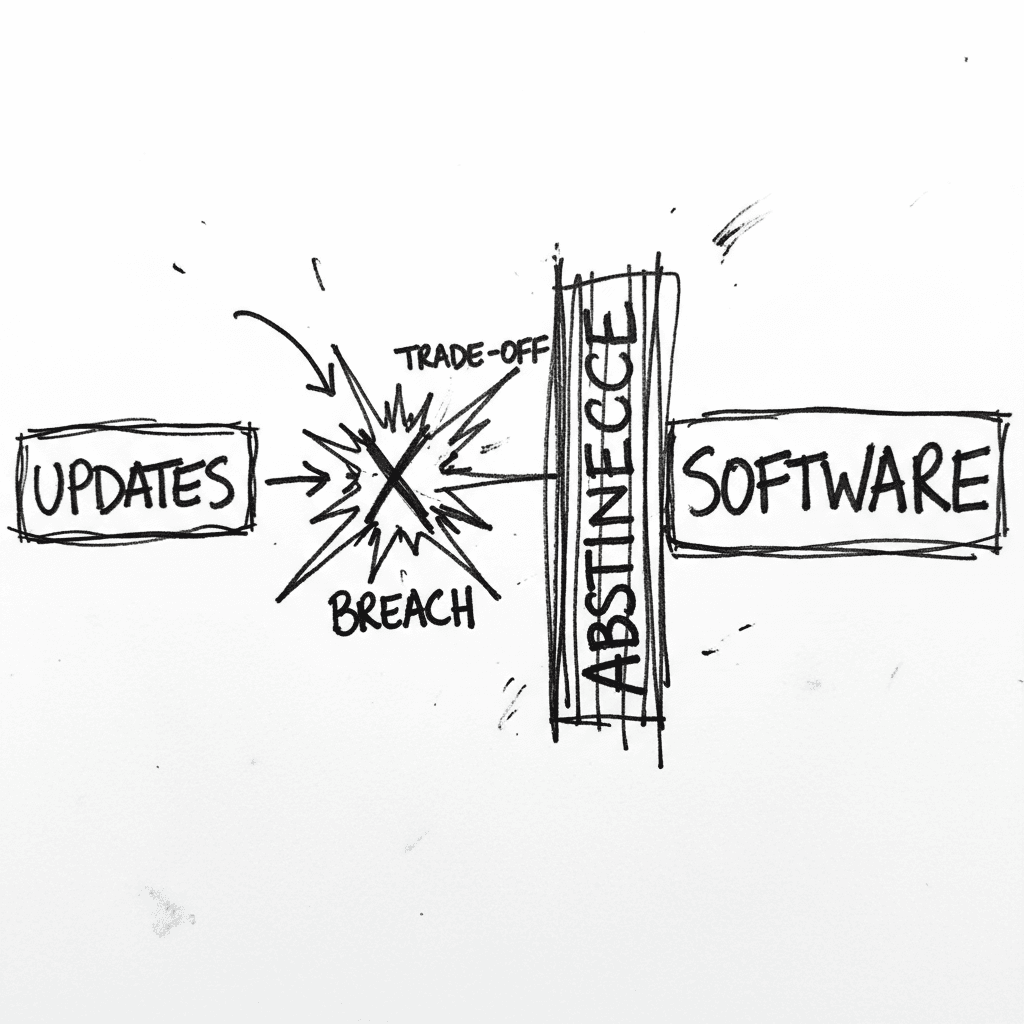

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

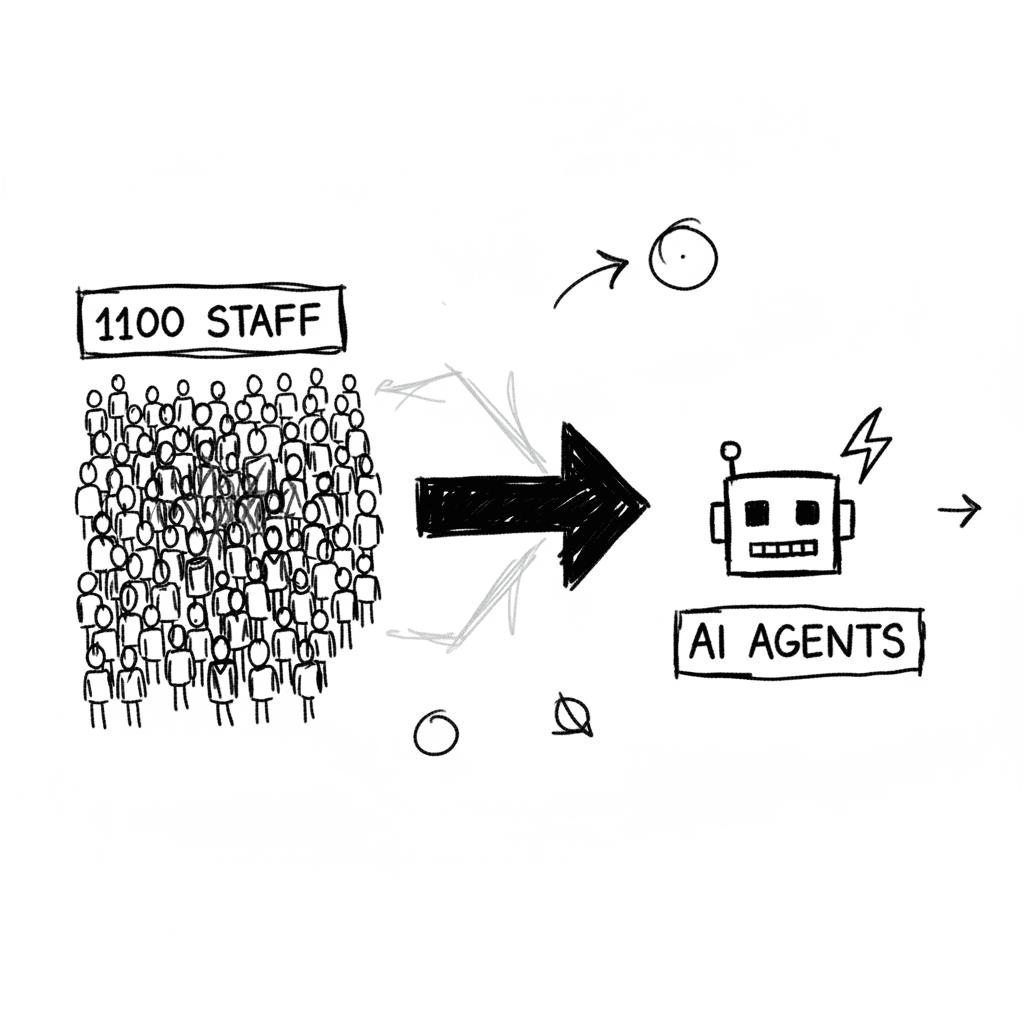

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

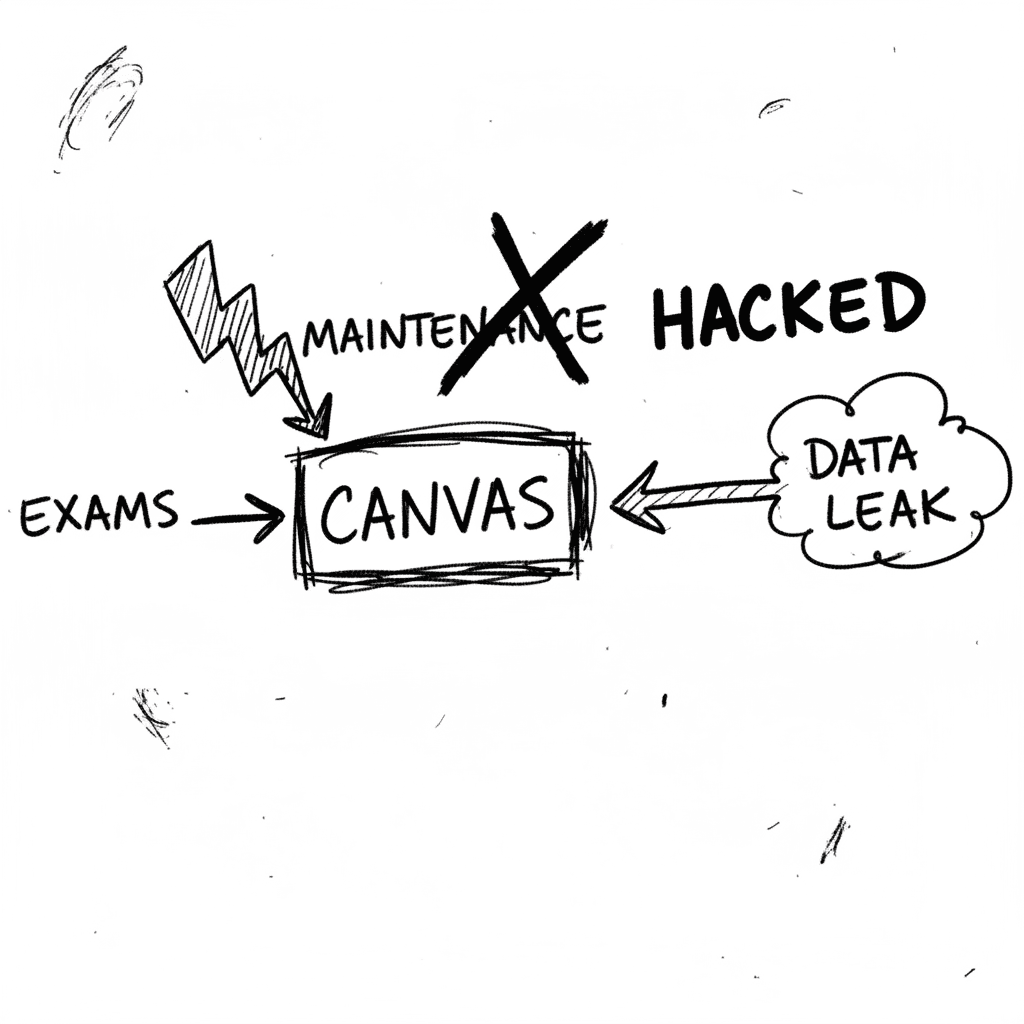

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.