Moonshine : l'alternative STT à 250M de paramètres face à Whisper Large v3

Moonshine est un modèle de Speech-to-Text (STT) en open-weights conçu par Useful Sensors pour pallier les défauts structurels de Whisper en streaming.

Le Pitch

Moonshine est un modèle de Speech-to-Text (STT) en open-weights conçu par Useful Sensors pour pallier les défauts structurels de Whisper en streaming.

Il propose une architecture capable de traiter l'audio sans le padding systématique de 30 secondes, permettant une inférence dont le coût computationnel scale directement avec la durée du signal.

La communauté s'y intéresse de près car il promet des performances supérieures à Whisper Large v3 avec seulement 250 millions de paramètres, contre 1,5 milliard pour le modèle d'OpenAI.

Sous le capot

L'innovation technique majeure réside dans l'abandon du fenêtrage fixe. Moonshine adapte ses ressources à la longueur réelle de l'audio, ce qui réduit drastiquement la latence pour les applications de direct (Source: Arxiv 'Flavors of Moonshine', Sept 2025).

Sur le papier, les chiffres sont solides : le modèle Medium (245M params) affiche un WER (Word Error Rate) de 6,65 % contre 7,44 % pour Whisper Large v3 sur certains benchmarks spécifiques (Source: GitHub README, Feb 2026).

Le projet bénéficie de la crédibilité de Pete Warden, ancien lead de TensorFlow Lite chez Google, ce qui se traduit par une stack très optimisée pour le edge computing. Le modèle tourne déjà sur Raspberry Pi 5 et MacOS avec un core C++ portable et ONNX Runtime (Source: GitHub, Feb 2026).

Cependant, les tests en conditions réelles tempèrent l'enthousiasme. Moonshine se fait distancer en précision pure par Parakeet V3 de Nvidia et Canary-Qwen sur les OpenASR Leaderboards de ce début d'année 2026.

On note également une fragilité importante face aux accents non-natifs, notamment l'anglais teinté d'espagnol, où Whisper garde l'avantage grâce à son volume de données d'entraînement (Source: The Neural Maze, Dec 2025).

Enfin, l'approche par modèles spécifiques à chaque langue réduit la flexibilité par rapport au modèle unique et polyglotte d'OpenAI (Source: Arxiv, 2025). C'est un compromis clair entre légèreté et universalité.

Il manque encore des données sur l'empreinte VRAM exacte du modèle "Medium Streaming" sur les derniers chipsets mobiles de 2026, comme le Snapdragon 8 Gen 5. De même, aucune comparaison directe n'est disponible face aux modèles "Thinking" multimodaux de GPT-5 ou Gemini 2.5 (Source: Dossier UsedBy).

L'avis de Ruben

Oubliez Moonshine si vous développez une application de transcription généraliste pour des utilisateurs internationaux aux accents variés. Whisper reste le standard pour encaisser la diversité linguistique sans broncher.

En revanche, pour du monitoring industriel sur Raspberry Pi ou de l'assistance vocale embarquée où la latence prime sur la richesse du vocabulaire, Moonshine est un excellent candidat. C'est un outil de niche chirurgical, pas un remplaçant universel.

Je le recommande pour vos side-projects domotiques ou des outils de transcription interne en environnement contrôlé, mais ne migrez pas votre prod SaaS dessus sans un benchmark interne massif sur vos propres datasets audio.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

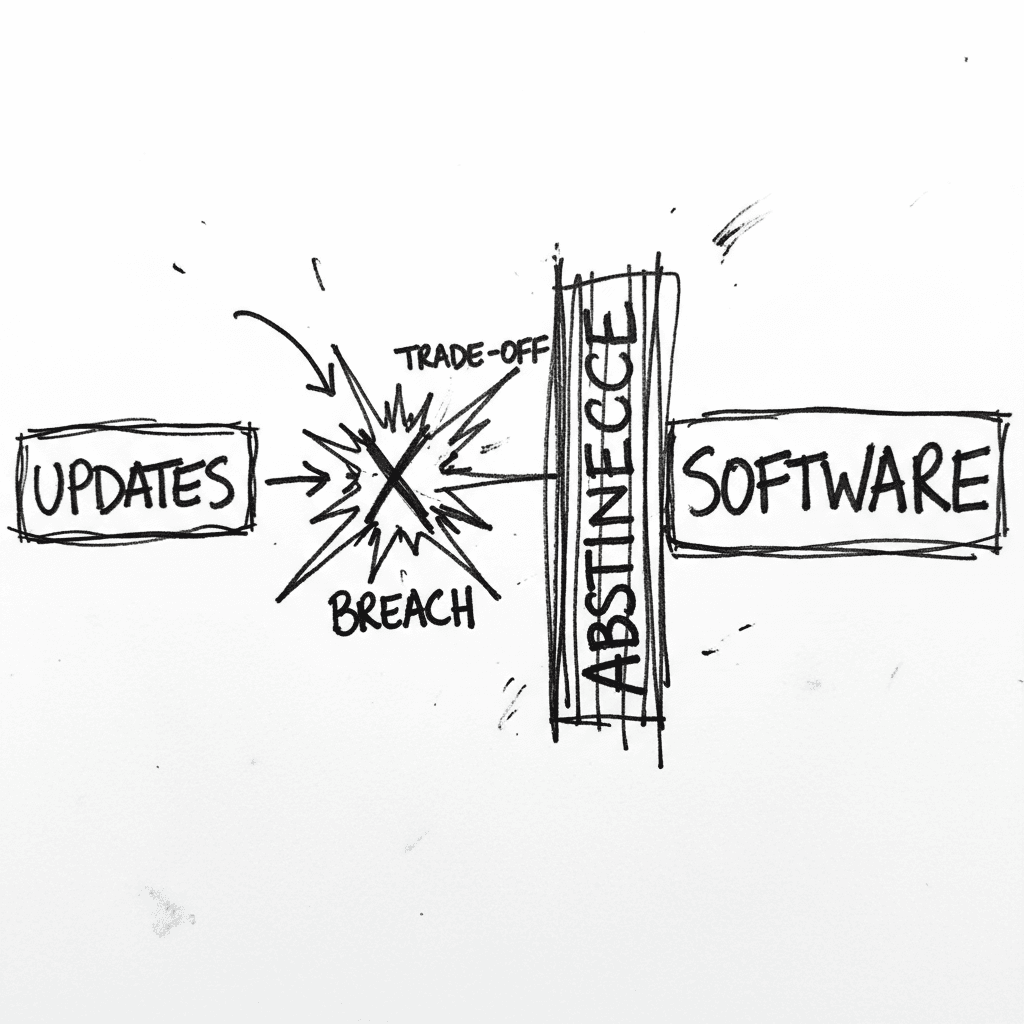

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

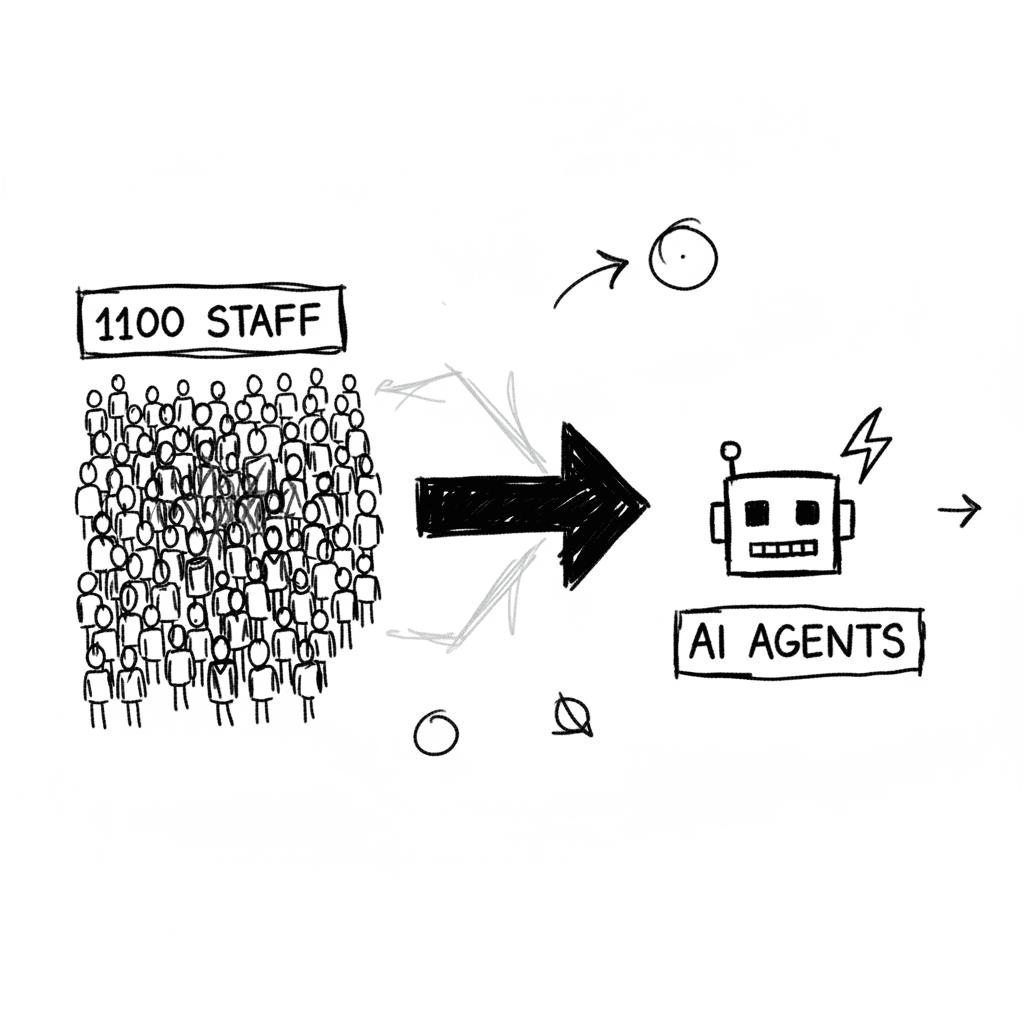

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

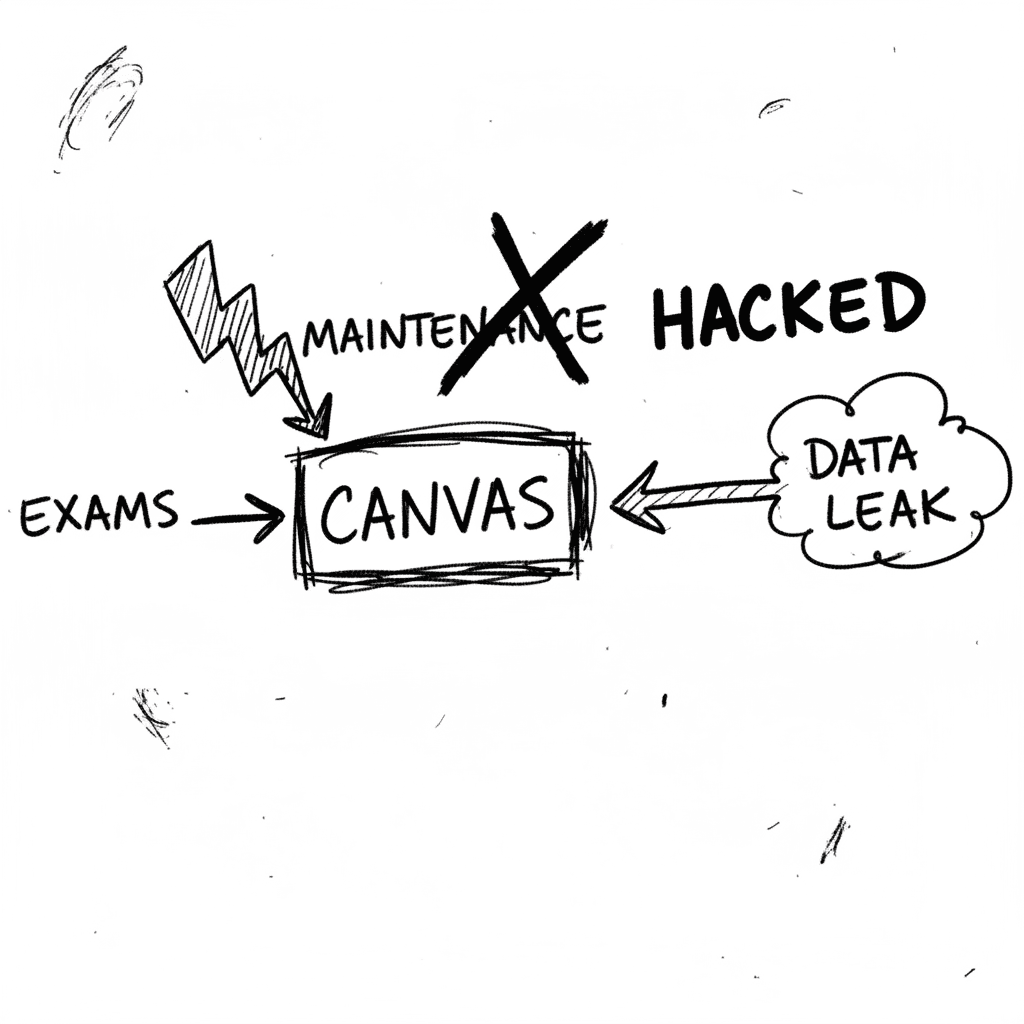

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.