Talkie 13B : Analyse technique du modèle vintage d'Alec Radford

Talkie est un modèle de 13 milliards de paramètres entraîné sur un corpus de 260 milliards de tokens datant exclusivement d'avant 1931. Développé par Alec Radford, Nick Levine et David Duvenaud, ce pr

Le Pitch

Talkie est un modèle de 13 milliards de paramètres entraîné sur un corpus de 260 milliards de tokens datant exclusivement d'avant 1931. Développé par Alec Radford, Nick Levine et David Duvenaud, ce projet cherche à isoler le raisonnement d'un LLM sans la contamination des données contemporaines. Il ne s'agit pas de l'application sociale du même nom, mais d'un outil de recherche académique sur le décalage temporel des modèles (source: simonwillison.net, April 2026).

Sous le capot

L'architecture 13B de Talkie nécessite environ 28 Go de VRAM pour une inférence stable en bfloat16 (source: GitHub). Le dataset inclut des livres, des journaux et des revues scientifiques de l'époque, tous sous licence Apache-2.0 (source: HuggingFace). L'équipe a publié trois variantes : une base, une version "it" pour l'instruction et un baseline "web" moderne pour comparer les performances avec les standards de 2026 (source: talkie-lm.com).

Le modèle capture avec une précision remarquable le ton et les perspectives coloniales ou impérialistes du début du XXe siècle (source: HN). Cependant, le filtrage des données n'est pas parfait. Le rapport technique admet que le modèle manifeste parfois une connaissance anachronique d'événements postérieurs à 1931, mentionnant la Seconde Guerre mondiale ou les Nations Unies (source: talkie-lm.com).

Sur le plan technique, les hallucinations restent un problème majeur pour ce type de modèle spécialisé. Talkie prétend par exemple qu'Edison a construit une voiture atteignant les 200 km/h et semble incapable de comprendre le fonctionnement des téléphones à cadran de son époque (source: HN). Plusieurs retours d'utilisateurs indiquent également un "drift" temporel : le modèle semble plus ancré dans la période 1900-1910, ignorant des faits majeurs comme la Grande Dépression (source: HN).

On ne sait pas encore quel LLM moderne a servi de juge pour la phase de reinforcement learning (DPO). La liste exhaustive des sources composant les 260 milliards de tokens n'a pas non plus été rendue publique par l'équipe de Radford. Enfin, aucune roadmap n'a été communiquée concernant d'éventuelles versions plus larges en 70B ou 405B (Dossier UsedBy).

L'avis de Ruben

Oubliez la prod, c'est un pur objet de laboratoire. L'intérêt technique est réel pour comprendre comment un transformer structure ses connaissances sans l'influence de GPT-5 ou Claude 4.5 Opus, mais les hallucinations techniques le rendent inutilisable pour de la recherche historique sérieuse. C'est un excellent side-project pour tester votre hardware local avec 28 Go de VRAM, rien de plus. On est face à une curiosité logicielle qui prouve surtout qu'en 2026, l'IA peine encore à simuler le passé sans y injecter ses propres biais actuels.

Codez propre,

Ruben.

Ruben Isaac - Lead AI Tech Watcher at UsedBy.ai

Articles connexes

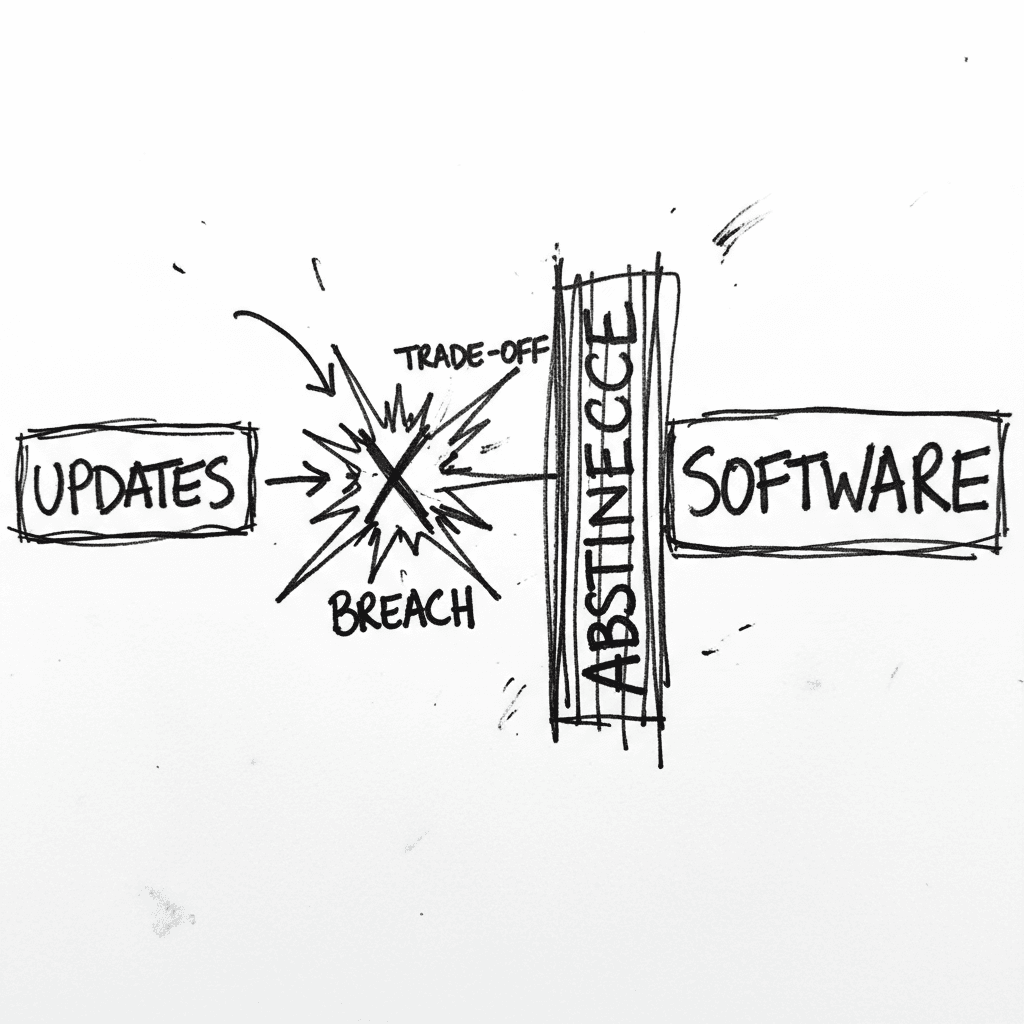

Software Abstinence : le moratoire de Xe Iaso face à l'exploit Copy Fail

Xe Iaso propose un arrêt total des installations de nouveaux logiciels et des mises à jour non critiques pendant une semaine. Ce moratoire technique vise à contrer l'exploitation massive de la vulnéra

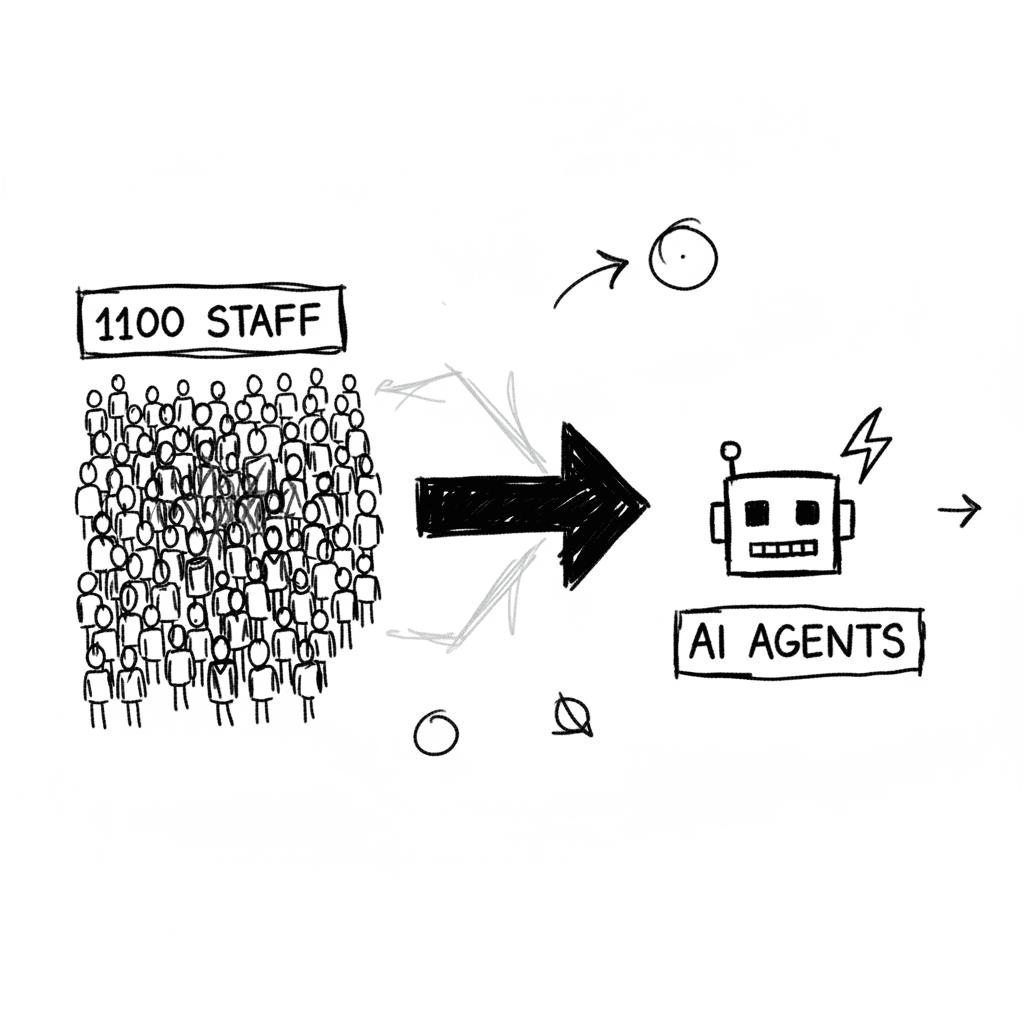

Cloudflare : restructuration massive au profit d'une architecture agentique interne

Cloudflare licencie 1 100 employés, soit 20 % de ses effectifs, pour automatiser ses processus via des agents IA. L'entreprise profite d'une croissance de 34 % en glissement annuel pour forcer une tra

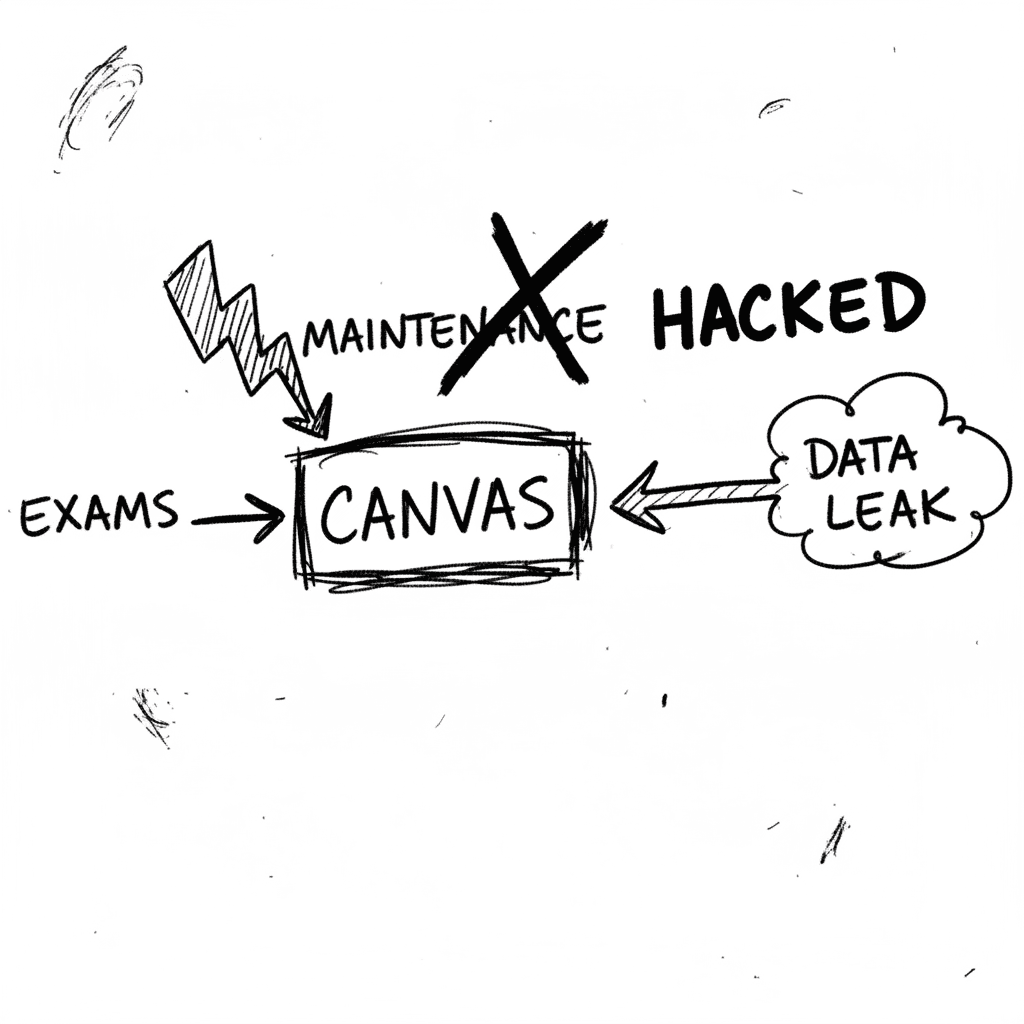

Instructure Canvas : échec critique de la sécurité en pleine période d'examens

Instructure Canvas, le LMS utilisé par plus de 30 millions d'étudiants, subit actuellement une compromission totale de son infrastructure par le groupe ShinyHunters. Alors que les universités entament

Restez à la pointe des tendances d'adoption de l'IA

Recevez nos derniers rapports et analyses directement dans votre boîte mail. Pas de spam, que des données.