TurboQuant: Compresión de KV Cache a 3 bits y aceleración de inferencia en H100

Google Research ha presentado TurboQuant, un sistema que reduce la huella de memoria del KV cache en un factor de 6x mediante una cuantización extrema a 3 bits. La propuesta busca resolver el cuello d

El Pitch

Google Research ha presentado TurboQuant, un sistema que reduce la huella de memoria del KV cache en un factor de 6x mediante una cuantización extrema a 3 bits. La propuesta busca resolver el cuello de botella de la memoria en contextos largos, prometiendo una aceleración de hasta 8x en hardware NVIDIA H100 (fuente: Google Research Blog).

Bajo el capó

El sistema opera sobre un diseño de dos etapas: PolarQuant, que realiza una rotación geométrica hacia coordenadas polares, y QJL, un mecanismo de corrección de errores de 1 bit (fuente: arXiv:2502.02617). A diferencia de los métodos de cuantización lineal tradicionales, este enfoque intenta preservar la integridad de los vectores en el espacio latente moviendo la complejidad del cálculo a la transformación geométrica.

Aunque el respaldo académico es sólido, con presentaciones programadas para ICLR 2026 y AISTATS 2026, la comunidad técnica ha detectado omisiones importantes. Existe una falta de citación al mecanismo de rotación geométrica del paper DRIVE de 2021, lo que ha generado debates sobre la originalidad de la implementación (fuente: HN). Además, la transformación polar recursiva es significativamente más densa que los estándares INT8 o FP8 actuales (fuente: arXiv:2502.02617).

En el plano práctico, la implementación es todavía un rompecabezas. El código de la componente QJL está disponible en GitHub (fuente: amirzandieh/QJL), pero aún no sabemos dónde está el repositorio unificado de TurboQuant ni tenemos datos sobre su eficiencia energética en Watts por token. La afirmación de "zero accuracy loss" genera escepticismo técnico, especialmente cuando se trata de vectores con radios grandes en espacios de alta dimensionalidad (fuente: HN).

La opinión de Diego

TurboQuant no está listo para tus clústeres de producción en marzo de 2026. La complejidad matemática de la transformación polar hace que la integración en librerías estándar sea un dolor de cabeza innecesario comparado con el rendimiento que ya obtenemos en GPT-5 o Gemini 2.5 con métodos menos exóticos. Mi consejo es que te limites a jugar con el componente QJL en entornos de pruebas. Hasta que no veamos un repositorio unificado y benchmarks independientes que validen esa supuesta pérdida de precisión cero en agentes autónomos reales, esto se queda en el laboratorio.

Código limpio siempre,

Diego.

Diego Navarro - Early Adopter Tech Analyst at UsedBy.ai

Artículos relacionados

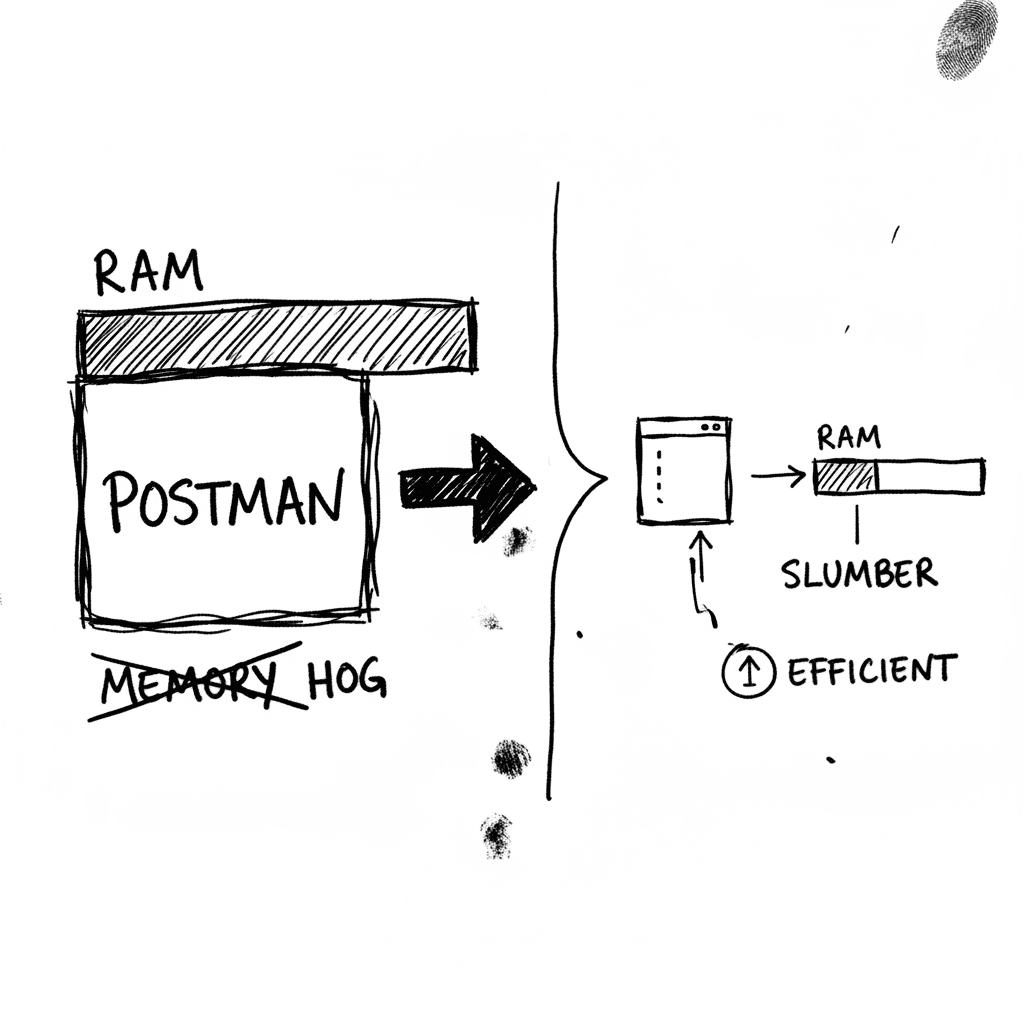

Slumber: gestión de APIs local-first vía terminal

Slumber es un cliente HTTP basado en terminal (TUI) escrito en Rust que utiliza archivos YAML para definir colecciones de peticiones sin depender de nubes externas (GitHub: lucaspickering/slumber). Es

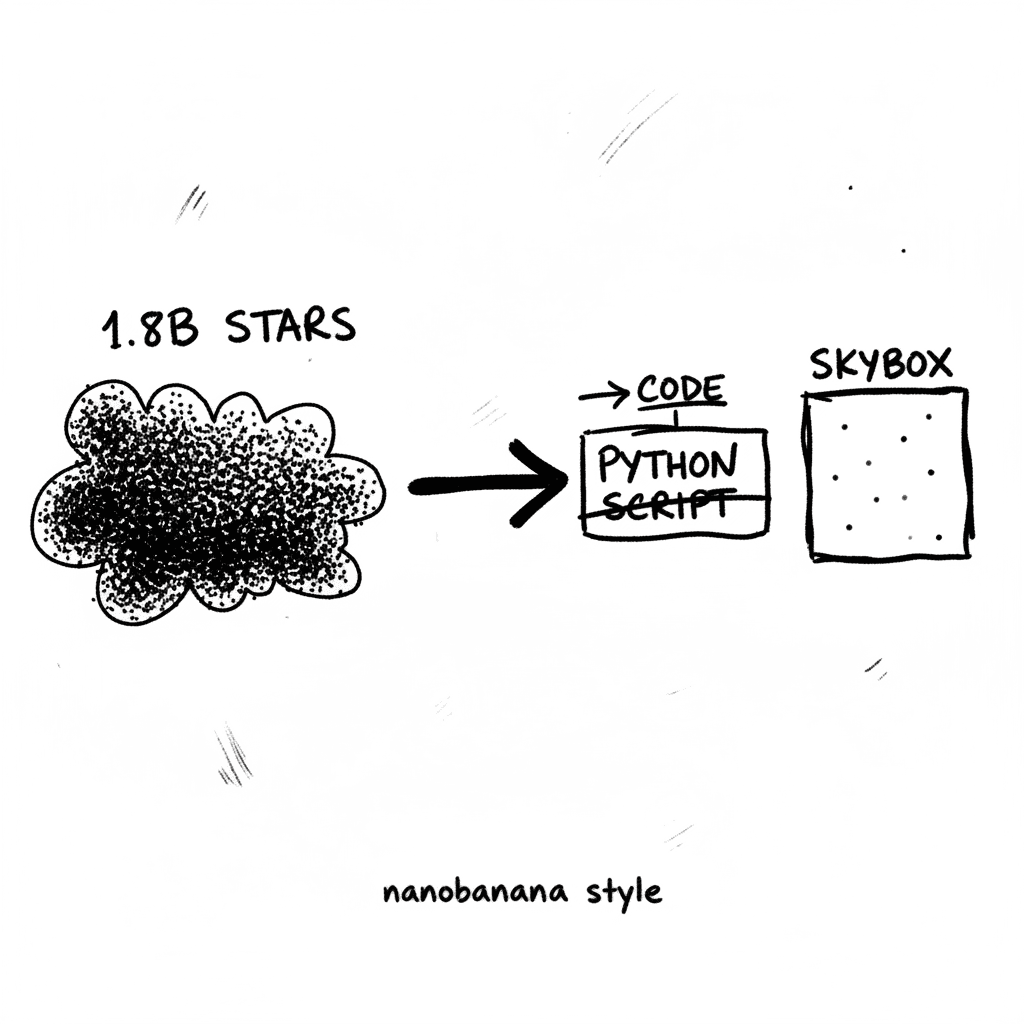

Carta estelar Gaia Mary y el dataset DR3 de la ESA

Gaia Mary es una herramienta de navegación estelar en 3D que recrea la computadora de la nave de "Project Hail Mary" utilizando el dataset real GAIA DR3 de la ESA. Val Hovey ha mapeado más de 1.800 mi

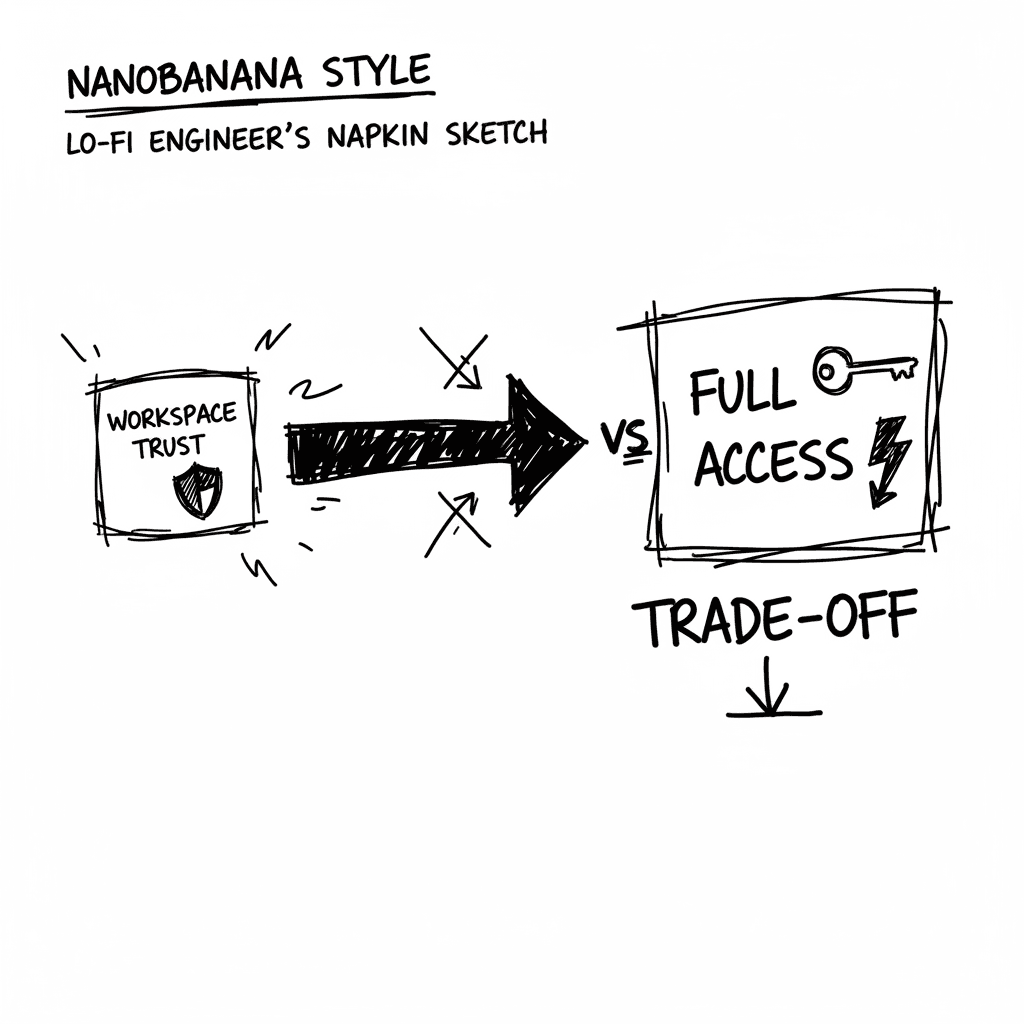

El modelo de seguridad de VS Code falla ante ataques de cadena de suministro

Visual Studio Code utiliza un sistema de "Workspace Trust" y firmas de editores que no impiden que una extensión maliciosa ejecute comandos con privilegios totales de usuario. A pesar de ser el estánd

Mantente al día con las tendencias de adopción de IA

Recibe nuestros últimos informes y análisis en tu correo. Sin spam, solo datos.